아틀라시안 감원 AI 전환: 1,600명 해고, CTO 2명 체제로 전격 개편한 이유

3월 25, 2026

OpenAI Codex Subagents GA: 멀티 에이전트 병렬 코딩 작동 원리, 실제 결과, Claude Code 비교

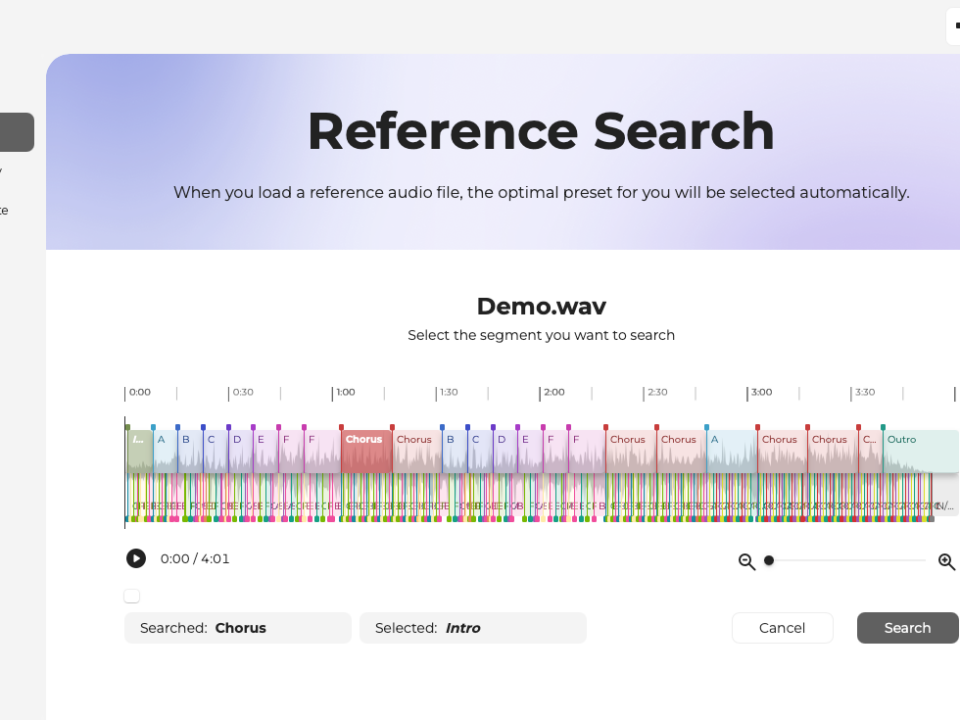

3월 26, 2026드디어, 가상 보컬의 합창이 ‘진짜’처럼 들리는 시대가 왔습니다. Synthesizer V AI의 합창 기능을 처음 들었을 때, 28년간 스튜디오에서 실제 합창단과 작업해온 저도 소름이 돋았습니다. 단순한 피치 시프트나 더블링이 아닌, AI가 각 보이스의 미세한 타이밍과 음색 변화까지 재현하는 수준에 도달한 것입니다.

Synthesizer V AI 합창이란? Dreamtonics의 혁신적 접근

Dreamtonics의 Synthesizer V는 AI 기반 보컬 합성 소프트웨어로, 단일 보이스 뱅크에서 놀라운 수준의 합창 사운드를 생성할 수 있습니다. 기존의 보컬 합성기들이 단순히 피치와 타이밍을 조정하는 수준에 머물렀다면, Synthesizer V AI는 딥러닝 모델을 통해 각 보이스의 포먼트, 비브라토 패턴, 브레스 노이즈까지 독립적으로 변조합니다.

핵심은 ‘AI Retake’ 기능과 ‘Voice Color’ 파라미터의 조합입니다. AI Retake는 같은 멜로디라도 매번 미세하게 다른 표현을 생성하여 자연스러운 합창 효과의 기반을 만들어줍니다. 여기에 Voice Color를 조절하면 하나의 보이스 뱅크에서 마치 다른 가수가 부르는 것 같은 음색 변화를 만들 수 있습니다. 이 두 기능의 시너지가 Synthesizer V AI 합창의 핵심 원리입니다.

Synthesizer V AI 합창 레이어링: 실전 워크플로우 5단계

실제 프로덕션에서 설득력 있는 AI 합창을 만들기 위해서는 체계적인 레이어링 워크플로우가 필요합니다. 28년간 실제 합창단과 가상 악기를 병행해온 경험을 바탕으로, 가장 효과적인 5단계 프로세스를 정리했습니다.

1단계: 리드 보컬 트랙 완성 — 모든 합창의 기초는 탄탄한 리드 보컬입니다. Synthesizer V에서 메인 멜로디를 먼저 완벽하게 조정합니다. 피치 커브, 다이나믹스, 브레스 포인트를 꼼꼼하게 세팅하는 것이 이후 레이어링의 품질을 좌우합니다.

2단계: AI Retake로 변형 생성 — 리드 트랙을 복제한 뒤, AI Retake 기능을 활용하여 3~6개의 변형 테이크를 생성합니다. 각 테이크마다 Expressiveness 파라미터를 5~15% 범위 내에서 다르게 설정하면, 실제 합창단원들의 미세한 개성 차이를 재현할 수 있습니다.

3단계: Voice Color 분산 — 생성된 각 트랙의 Voice Color를 조금씩 다르게 설정합니다. 기본값 0에서 -0.3에서 +0.3 범위 내에서 분산시키면 음색의 다양성이 확보됩니다. 너무 극단적인 값은 부자연스러운 결과를 초래할 수 있으니 주의가 필요합니다.

4단계: 타이밍 미세 조정 — 진짜 합창에서 모든 사람이 정확히 같은 타이밍에 노래하지 않습니다. 각 트랙의 노트 온셋을 5~20ms 범위에서 랜덤하게 오프셋합니다. 이 미세한 타이밍 차이가 합창의 ‘두께’와 ‘공간감’을 만들어냅니다.

5단계: 스테레오 배치와 리버브 — DAW에서 각 보이스 트랙을 스테레오 필드에 분산 배치합니다. 소프라노는 좌측, 알토는 우측, 테너는 센터 좌측, 베이스는 센터 우측처럼 실제 합창단의 배치를 모방합니다. 컨볼루션 리버브로 같은 공간에 있는 느낌을 더하면 완성입니다.

보이스 뱅크 선택: 합창에 최적화된 AI 보컬은?

Synthesizer V의 보이스 뱅크 라인업에서 합창용으로 특히 뛰어난 성능을 보이는 보이스들이 있습니다. Dreamtonics 공식 보이스 데이터베이스에서 확인할 수 있는 AI 보이스 중, Solaria는 영어 합창에서 가장 자연스러운 결과를 보여줍니다. 깨끗한 톤과 넓은 다이나믹 레인지 덕분에 합창 레이어링 시 각 트랙이 서로 부딪히지 않고 자연스럽게 블렌딩됩니다.

일본어 합창의 경우 Mai와 Saki가 우수한 성능을 보이며, 클래식 합창 스타일에는 Anri의 풍부한 비브라토가 적합합니다. 중요한 것은 하나의 프로젝트에서 반드시 같은 보이스 뱅크만 사용할 필요가 없다는 점입니다. 소프라노 파트에 Solaria, 알토에 Eleanor, 테너에 Kevin을 조합하면 실제 혼성 합창단에 가까운 결과물을 얻을 수 있습니다.

프로듀서 관점: 실제 합창 vs AI 합창, 어디까지 대체 가능한가

28년간 실제 합창단과 작업하면서, 그리고 최근 3년간 AI 보컬 합성을 병행하면서 느끼는 점은 명확합니다. AI 합창은 ‘대체’가 아니라 ‘확장’입니다. 16인 이하의 소규모 앙상블 사운드에서는 Synthesizer V AI의 결과물이 상당히 설득력 있습니다. 특히 팝, 일렉트로닉, 게임 OST, 광고 음악처럼 ‘완벽한 톤’이 요구되는 장르에서 빛을 발합니다.

반면, 100인 이상의 대규모 합창이나 라이브 퍼포먼스의 에너지, 성가대 특유의 ‘숨소리가 섞인 공기감’은 아직 AI가 완벽히 재현하기 어려운 영역입니다. 하지만 이것은 ‘한계’가 아니라 ‘현재의 위치’입니다. 2년 전만 해도 불가능했던 자연스러운 비브라토 전환이 지금은 AI Retake 한 번으로 해결됩니다. 발전 속도를 고려하면, 이 격차는 계속 좁혀질 것입니다.

실전에서 저는 ‘하이브리드 워크플로우’를 추천합니다. 메인 합창은 Synthesizer V로 빠르게 프로토타이핑하고, 클라이언트 피드백 후 핵심 파트만 실제 보컬리스트로 교체하는 방식입니다. 이렇게 하면 프리프로덕션 시간을 70% 이상 단축하면서도 최종 결과물의 품질을 담보할 수 있습니다.

DAW 통합과 VST 플러그인 활용 팁

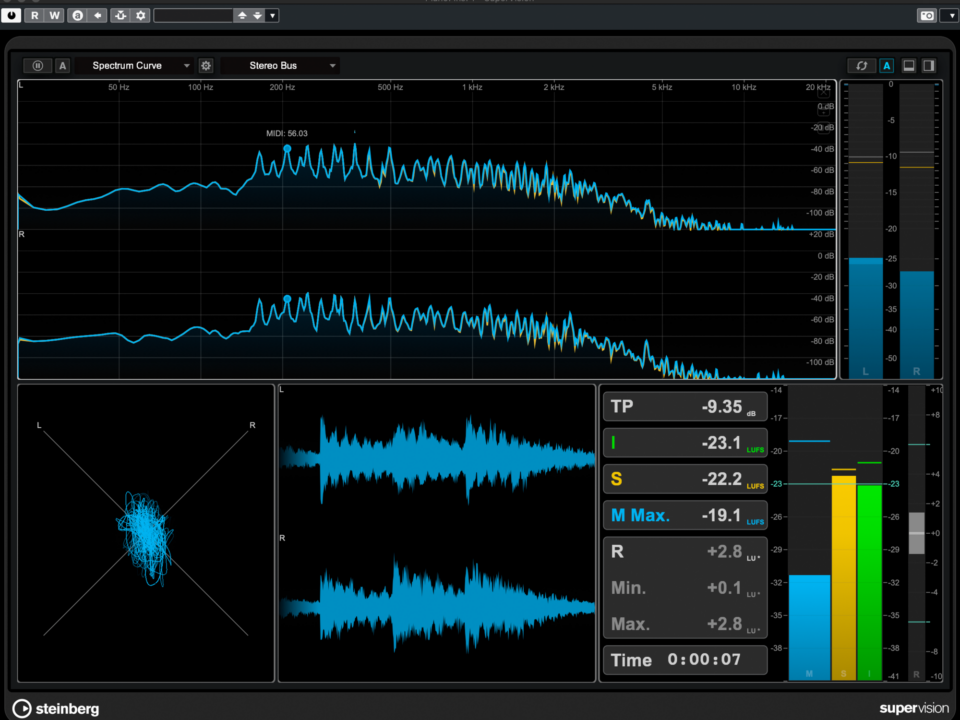

Synthesizer V는 스탠드얼론과 VST3/AU 플러그인 양쪽 모두 지원합니다. 합창 프로덕션에서는 VST 플러그인 모드를 강력히 추천합니다. DAW 내에서 직접 각 보이스 트랙을 독립 채널로 관리할 수 있어, 개별 EQ, 컴프레션, 리버브 세팅이 훨씬 편리합니다.

Logic Pro나 Cubase 사용자라면, 각 합창 파트를 별도의 인스트루먼트 트랙에 로드하고 버스로 묶는 것이 가장 효율적입니다. Pro Tools 사용자는 오디오 렌더링 후 별도 오디오 트랙에서 후처리하는 워크플로우가 CPU 부하 관리에 유리합니다. Synthesizer V의 렌더링 엔진은 리얼타임 재생보다 오프라인 바운스에서 더 높은 품질을 제공하므로, 최종 믹스 전에 반드시 고품질 오프라인 렌더링을 거치는 것을 권장합니다.

또한 Synthesizer V의 MIDI 학습 기능을 활용하면, 외부 MIDI 컨트롤러로 실시간 표현력을 조정할 수 있습니다. 합창의 다이나믹스를 라이브로 오토메이션하면, 훨씬 더 유기적이고 살아있는 합창 사운드를 만들 수 있습니다.

결론: AI 합창의 현재와 미래

Synthesizer V AI의 합창 기능은 단순한 ‘기술 데모’를 넘어, 실제 프로덕션 현장에서 충분히 활용 가능한 수준에 도달했습니다. Dreamtonics의 지속적인 AI 엔진 업데이트와 보이스 뱅크 확장을 고려하면, 2026년은 AI 합창이 메인스트림 프로덕션 도구로 자리잡는 원년이 될 것입니다. 중요한 것은 도구 자체가 아니라, 그 도구를 어떻게 활용하느냐입니다. 위에서 소개한 5단계 워크플로우와 하이브리드 접근법을 적용한다면, 혼자서도 설득력 있는 합창 프로덕션을 완성할 수 있습니다.

보컬 프로덕션의 가능성은 AI 합성 기술과 함께 계속 확장되고 있습니다. 직접 프로젝트에 적용해보면서, 자신만의 최적 세팅을 찾아가는 과정 자체가 가장 큰 학습이 될 것입니다.

AI 보컬 합성이나 합창 프로덕션 워크플로우 구축에 대해 더 알고 싶으시다면, Sean Kim이 직접 컨설팅해드립니다.

매주 AI, 음악, 테크 트렌드를 이메일로 받아보세요.