2025년 10월 프리홀리데이 테크 딜: 블랙프라이데이 기다릴 필요 없는 7가지 초특가

10월 27, 2025

무료 Max for Live 디바이스 베스트 15: Ableton 필수 다운로드 가이드 (2025)

10월 28, 2025콜드 스타트 67초. 프로덕션에서 torch.compile을 도입하려던 팀이라면 이 숫자가 얼마나 고통스러운지 아실 겁니다. PyTorch 2.5가 이 문제를 9.6초로 끌어내렸습니다—무려 7배 단축입니다. 여기에 FlexAttention이라는 완전히 새로운 어텐션 API, H100에서 75% 빨라진 SDPA 백엔드, 그리고 4천만 대의 인텔 GPU 노트북을 딥러닝 장치로 편입시키는 업데이트까지. 504명의 컨트리뷰터가 만든 4,095개의 커밋이 담긴 이번 릴리스를 하나하나 뜯어보겠습니다.

PyTorch 2.5 리저널 컴파일레이션: 콜드 스타트의 근본적 해결

torch.compile의 가장 큰 진입 장벽은 콜드 스타트 시간이었습니다. 모델 전체를 한 번에 컴파일하면 H100 GPU에서도 67.4초가 걸렸습니다. 이는 서빙 환경에서 사실상 사용 불가능한 수준이었습니다. PyTorch 2.5의 리저널 컴파일레이션(Regional Compilation)은 이 문제를 근본적으로 해결합니다.

핵심 아이디어는 단순하면서도 강력합니다. 트랜스포머 모델은 동일한 레이어가 반복되는 구조입니다. 모델 전체를 컴파일하는 대신, 반복되는 nn.Module 하나만 컴파일하면 됩니다. 나머지 레이어는 동일한 컴파일 결과를 재사용합니다.

# 기존 방식: 모델 전체 컴파일 (67.4초)

model = torch.compile(model)

# PyTorch 2.5: 리저널 컴파일 (9.6초)

for layer in model.transformer_layers:

layer = torch.compile(layer)결과는 극적입니다. 콜드 스타트가 67.4초에서 9.6초로 단축되었고, 웜 캐시 상태에서는 2.4초까지 줄어듭니다. PyTorch 2.5에서는 inline_inbuilt_nn_modules 플래그가 기본 활성화되어, 별도 설정 없이도 이 최적화의 혜택을 받을 수 있습니다. 프로덕션 환경에서 torch.compile 도입을 망설였던 팀이라면, 이번 업데이트가 결정적인 전환점이 될 것입니다.

FlexAttention API: 어텐션 메커니즘의 자유도를 극대화하다

어텐션 메커니즘 연구자들에게 PyTorch 2.5의 FlexAttention API는 게임 체인저입니다. 기존에는 새로운 어텐션 변형을 실험하려면 커스텀 CUDA 커널을 직접 작성하거나, 제한된 옵션 중에서 선택해야 했습니다. FlexAttention은 몇 줄의 Python 코드로 어텐션 스코어 수정 함수를 정의하면, PyTorch가 자동으로 최적화된 FlashAttention 커널로 컴파일해줍니다.

Causal attention, sliding window, document masking 같은 일반적인 패턴은 물론, 연구자가 자유롭게 정의한 커스텀 어텐션 패턴까지 하드웨어 수준에서 최적화된 성능으로 실행됩니다. 특히 H100 GPU에서 Fused Flash Attention을 통해 FlashAttentionV2 대비 최대 75%의 속도 향상을 달성합니다. 이는 단순한 편의성 개선이 아니라, 어텐션 연구의 실험-배포 사이클 자체를 가속화하는 변화입니다.

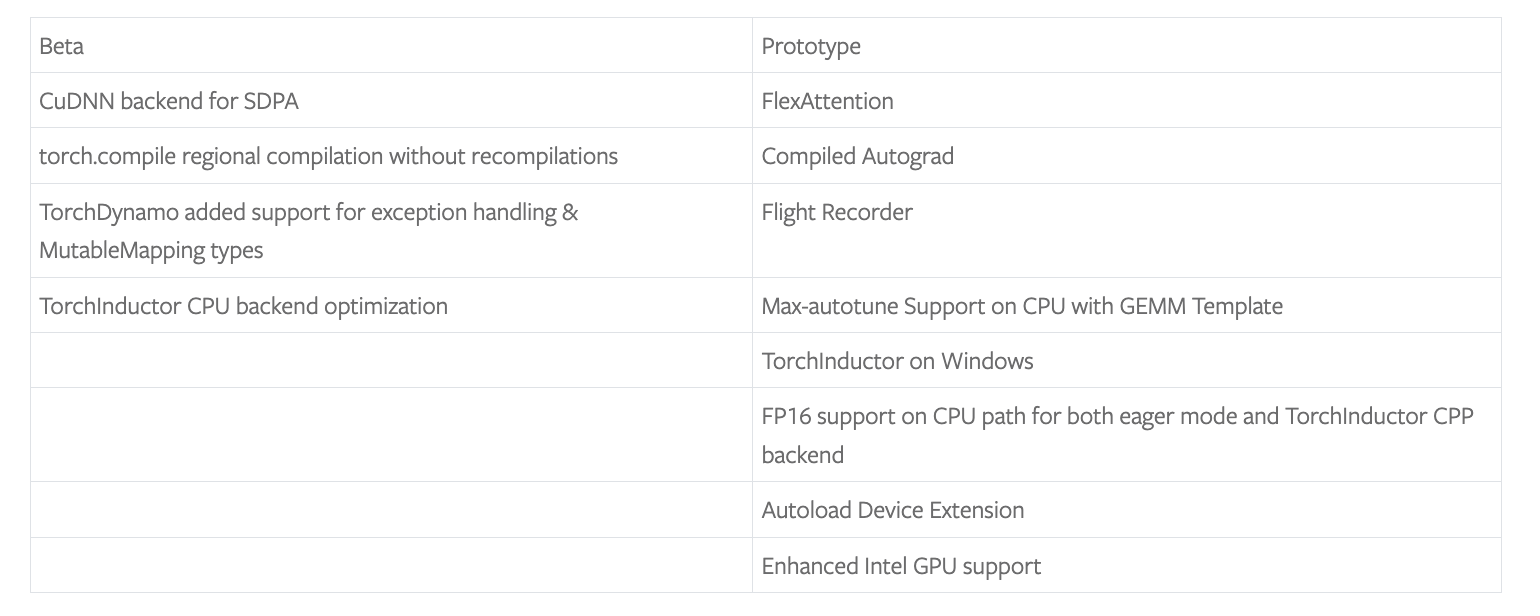

cuDNN SDPA 백엔드와 TorchInductor CPU 최적화

PyTorch 2.5는 H100 이상의 NVIDIA GPU에서 cuDNN 기반의 새로운 SDPA(Scaled Dot-Product Attention) 백엔드를 도입했습니다. 이 백엔드는 기존 Flash Attention 구현 대비 눈에 띄는 성능 향상을 보여주며, 특히 대규모 언어 모델의 추론과 학습 모두에서 효과적입니다.

CPU 측면에서도 의미 있는 진전이 있었습니다. TorchInductor의 CPU max-autotune 모드는 GEMM(행렬 곱셈) 연산에 대해 다양한 커널 구현을 자동으로 프로파일링하고 최적의 조합을 선택합니다. 벤치마크에서 geomean 기준 7%의 속도 향상을 보였고, LLM 추론 작업에서는 최대 20%까지 성능이 개선되었습니다. GPU가 없는 개발 환경이나 CPU 기반 서빙 파이프라인에서도 PyTorch의 성능이 크게 향상된 셈입니다.

인텔 GPU 지원: 4천만 대의 새로운 딥러닝 장치

PyTorch 2.5에서 가장 광범위한 영향을 미칠 수 있는 변화는 인텔 GPU 지원의 확대입니다. InfoQ의 분석에 따르면, 이번 업데이트로 약 4천만 대의 인텔 GPU 탑재 노트북과 데스크톱에서 PyTorch를 네이티브로 실행할 수 있게 됩니다. 인텔 Arc와 통합 그래픽 칩셋 모두를 포함하며, eager 모드와 torch.compile 모드 양쪽을 지원합니다.

이는 딥러닝 학습의 진입 장벽을 크게 낮추는 변화입니다. 학생이나 취미 개발자가 별도의 NVIDIA GPU 없이도 자신의 노트북에서 모델을 학습하고 추론할 수 있습니다. 또한 Windows 환경에서의 Inductor CPU 백엔드 지원도 추가되어, 운영체제에 관계없이 PyTorch의 컴파일 최적화를 활용할 수 있게 되었습니다.

Flight Recorder와 분산 학습 디버깅의 진화

대규모 분산 학습에서 가장 골치 아픈 문제 중 하나는 “멈춘 작업(stuck job)”의 원인을 찾는 것입니다. 수백 개의 GPU가 연결된 환경에서 어떤 노드의 어떤 통신이 문제인지 파악하는 것은 악몽에 가깝습니다. PyTorch 2.5의 Flight Recorder는 이 문제를 정면으로 해결합니다.

Flight Recorder는 각 노드의 집합 통신(collective communication) 이벤트를 링 버퍼에 기록합니다. 작업이 멈추면 기록된 데이터를 분석하여 어떤 랭크(rank)에서 어떤 연산이 불일치했는지를 정확히 짚어줍니다. 이는 분산 학습 디버깅 시간을 수시간에서 수분으로 단축시킬 수 있는 도구입니다. 특히 FSDP(Fully Sharded Data Parallel)나 파이프라인 병렬화를 사용하는 대규모 학습 환경에서 그 가치가 극대화됩니다.

PyTorch 2.5가 의미하는 것: 컴파일 시대의 본격 개막

PyTorch 2.5의 업데이트를 종합하면, PyTorch가 “eager 모드의 편의성”에서 “컴파일 모드의 성능”으로 완전히 무게 중심을 옮기고 있음이 명확합니다. 리저널 컴파일레이션으로 도입 장벽을 낮추고, FlexAttention으로 연구자의 자유도를 보장하며, 인텔 GPU와 Windows 지원으로 생태계를 확장하는 전략입니다. 504명의 컨트리뷰터가 참여한 4,095개의 커밋은 PyTorch 커뮤니티의 건강함을 보여주며, 이 프레임워크가 앞으로도 딥러닝 생태계의 중심에 있을 것임을 시사합니다.

특히 프로덕션 환경에서 PyTorch를 운용하는 엔지니어라면, torch.compile의 리저널 컴파일레이션만으로도 업그레이드할 충분한 이유가 됩니다. 콜드 스타트 67초와 9.6초의 차이는 단순한 벤치마크 숫자가 아니라, 배포 파이프라인의 설계 자체를 바꾸는 변화이기 때문입니다. 이런 규모의 기술적 도전과 인프라 최적화에 관심이 있다면, 전문적인 지원이 큰 차이를 만들 수 있습니다.

기술 컨설팅이나 자동화 시스템 구축이 필요하시다면, 실무 경험 기반의 전문 상담을 제공합니다.

매주 AI, 음악, 테크 트렌드를 이메일로 받아보세요.