Garmin Venu 4 출시: AMOLED 디스플레이, ECG, 플래시라이트, 12일 배터리 — $549의 가치는?

9월 25, 2025

킥과 베이스 EQ 완전정복: 로우엔드를 확실하게 정리하는 7가지 주파수 카빙 테크닉

9월 26, 2025한 달 만에 주요 오픈소스 모델이 세 개나 쏟아졌습니다. 알리바바가 Qwen3-Max, Qwen3-Next, Qwen3-Omni를 연달아 공개했고, DeepSeek은 추론 비용을 절반으로 줄이는 희소 어텐션 메커니즘을 탑재한 V3.2-Exp를 조용히 발표했습니다. 그리고 2025년 7월 기준, 중국은 전 세계 약 3,755개 공개 LLM 중 1,509개를 차지하며 40%를 넘었습니다. 오픈소스 AI가 서방 주도라는 인식은 2025년 9월을 기점으로 공식적으로 깨졌습니다.

Qwen3 9월 공세: 22일 만에 세 모델 발표

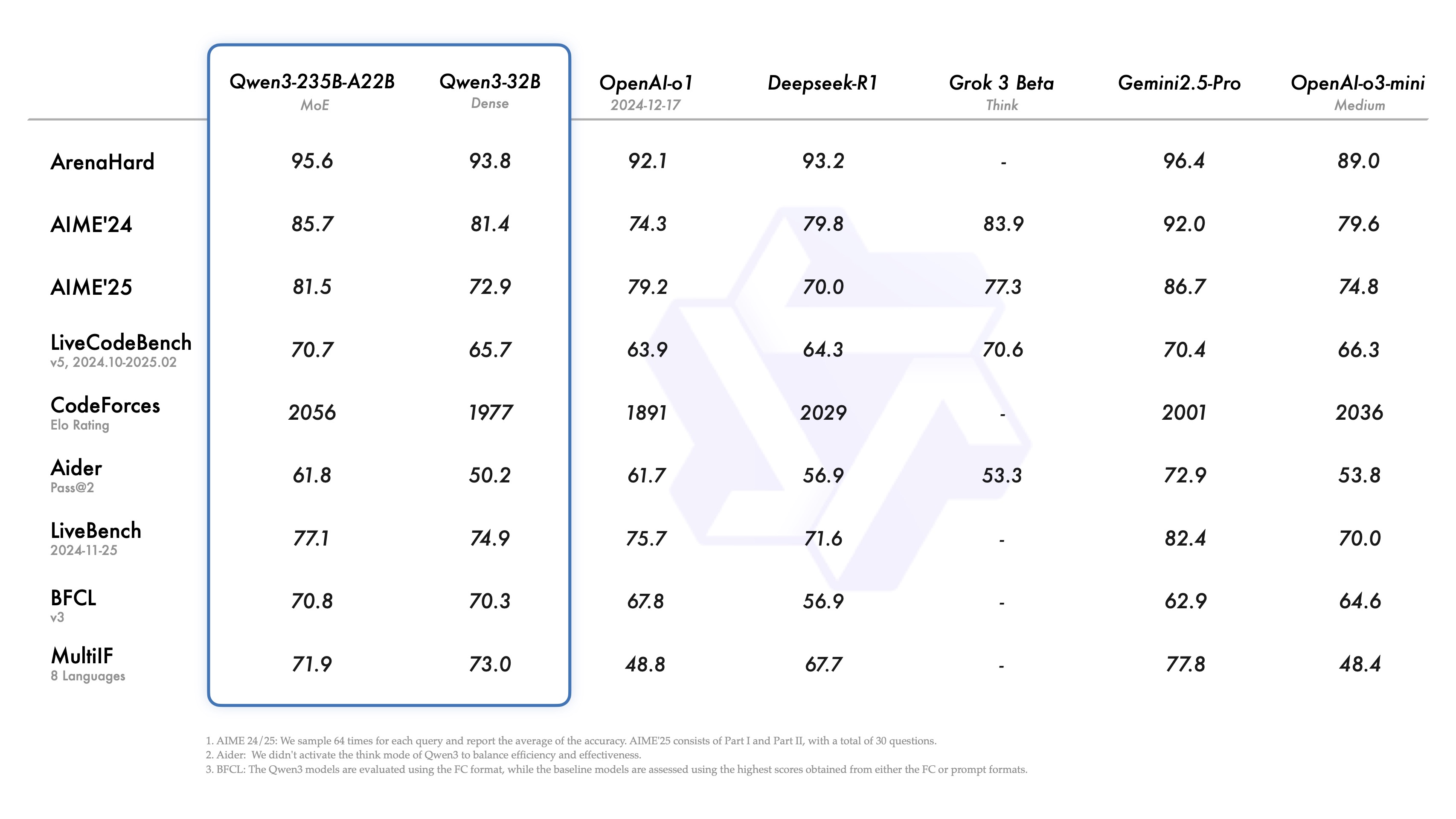

알리바바의 Qwen 팀은 9월에 모델 하나를 낸 것이 아니라, 하나의 생태계를 구축했습니다. 9월 5일, Qwen3-Max가 1조 개 파라미터의 비공개 가중치 모델로 출시되었습니다. 이전 235B Qwen 대비 4배 이상 커진 역대 최대 규모이며, API 가격은 GPT-4를 크게 밑돌았습니다.

5일 뒤인 9월 10일, Qwen3-Next-80B-A3B가 Apache 2.0 라이선스로 공개되었습니다. 여기서부터가 개발자에게 진짜 흥미로운 부분입니다. 이 모델은 총 800억 개 파라미터를 갖고 있지만 추론 시에는 30억 개만 활성화되는 Mixture-of-Experts(MoE) 아키텍처를 사용합니다. GPT-4급 추론 능력을 연산 비용의 일부만으로 실현하는 것이며, 단일 A100 GPU에서 구동이 가능합니다.

그리고 9월 22일, Qwen3-Omni가 등장했습니다. 이것은 게임 체인저입니다. 텍스트, 이미지, 오디오, 비디오를 입력으로 받고, 텍스트와 실시간 음성을 출력하는 네이티브 엔드투엔드 옴니모달 모델입니다. Apache 2.0 라이선스로 상용 배포에 어떤 제한도 없습니다. 내일 당장 프로덕션에 투입할 수 있습니다.

DeepSeek V3.2-Exp: 진짜 작동하는 희소 어텐션

알리바바가 헤드라인을 장악하는 동안, DeepSeek은 9월 29일 V3.2-Exp를 조용히 공개했습니다. 기술적 혁신 면에서 이 모델은 받고 있는 것보다 훨씬 더 큰 주목을 받을 자격이 있습니다. V3.1-Terminus를 기반으로 구축된 이 6,710억 파라미터 모델은 DeepSeek Sparse Attention(DSA)을 도입했습니다. 이는 장문맥 학습과 추론 효율성을 극적으로 개선하는 세밀한 희소 어텐션 메커니즘입니다.

숫자가 이야기합니다. MMLU-Pro에서 V3.2-Exp는 전작과 동일한 85.0점을 유지했습니다. AIME 2025 Pass@1은 89.3으로 소폭 향상되었고, Codeforces 레이팅은 2046에서 2121로 올랐습니다. 즉, DeepSeek은 품질을 전혀 희생하지 않으면서 대규모 효율성 개선을 달성한 것입니다. 모델 최적화의 성배라 할 수 있습니다.

128K 토큰 컨텍스트 윈도우는 책 분량의 문서와 다중 세션 대화를 처리합니다. 그리고 결정적으로, DeepSeek은 동시에 API 가격을 50% 이상 인하했습니다. 모델이 동시에 더 좋아지고 더 저렴해질 때, 그것은 점진적 업데이트가 아닙니다. 추론 경제학의 패러다임 전환입니다.

중국 오픈소스 LLM의 압도적 우위: 숫자로 보는 현실

큰 그림을 봐야 합니다. IntuitionLabs의 2025년 9월 분석에 따르면, 중국은 현재 전 세계 공개 LLM의 약 40%를 차지하고 있습니다. 이것은 양의 문제만이 아닙니다. 질과 전략적 포지셔닝의 문제입니다.

주요 모델 라인업이 이를 증명합니다. 알리바바의 Qwen 시리즈(0.5B~1T 파라미터), DeepSeek의 V3/R1 패밀리, 지푸 AI의 GLM-4.5(355B), 바이트댄스의 Kimi K2, 문샷의 K1.5, 바이두의 새로 오픈소스화된 Ernie. 이 모든 모델이 MoE 아키텍처를 사용합니다. 모두 128K 이상의 토큰 컨텍스트 윈도우를 지원합니다. 대부분 Apache 2.0 또는 유사하게 허용적인 라이선스로 배포됩니다.

전략적 함의는 중대합니다. 미국의 OpenAI와 Anthropic이 프론티어 모델을 비공개로 유지하는 동안, 중국 연구소들은 경쟁력 있는 대안으로 오픈소스 생태계를 장악하고 있습니다. AI 애플리케이션을 구축하는 개발자에게 이는 더 많은 선택지, 더 낮은 비용, 더 적은 벤더 종속을 의미합니다.

01.AI의 전략적 선회: Yi 팀, 사전훈련 중단 선언

모든 중국 AI 연구소가 ‘더 큰 모델’ 전략을 따르는 것은 아닙니다. AI 선구자 리카이푸가 이끄는 01.AI는 올해 새로운 파운데이션 모델의 사전훈련을 중단하고 기존 모델의 상용화에 집중하겠다고 발표해 업계의 이목을 끌었습니다. 최신 모델인 Yi-Lightning은 벤치마크 점수보다 추론 지연시간을 우선시하는 속도 최적화 MoE 변형입니다.

Yi-Lightning은 현재 LMSYS Chatbot Arena에서 약 6위를 기록하고 있습니다. 1조 개 파라미터가 없어도 경쟁력 있는 모델을 구축할 수 있음을 보여주는 좋은 성적입니다. 파라미터 군비 경쟁을 멈추고 배포, 엔터프라이즈 통합, 실제 애플리케이션에 집중하는 이 결정은 시장이 벤치마크 자랑보다 안정성과 비용 효율성을 더 가치 있게 본다는 판단에 기반합니다.

이 전환은 주목할 가치가 있습니다. 파운데이션 모델이 범용화됨에 따라, 가치는 가장 큰 모델을 훈련하는 것에서 기존 모델 위에 최고의 제품을 구축하는 것으로 이동하고 있기 때문입니다.

2025년 9월, 개발자에게 주는 실전 시사점

지금 AI 기반 애플리케이션을 구축하고 있다면, 2025년 9월은 풍요의 시대를 열어주었습니다. 실전적 결론을 정리합니다.

- 멀티모달 애플리케이션: Apache 2.0 하의 Qwen3-Omni가 확실한 승자입니다. 텍스트, 이미지, 오디오, 비디오 입력 — 텍스트와 음성 출력. API 의존 없이 사용 가능합니다.

- 비용 민감 배포: Qwen3-Next-80B-A3B는 3B 활성 파라미터만으로 프론티어급 추론을 제공합니다. 이미 보유한 하드웨어에서 구동 가능합니다.

- 장문맥 워크로드: DeepSeek V3.2-Exp의 희소 어텐션 메커니즘은 128K 컨텍스트 윈도우를 대규모에서도 경제적으로 만들어줍니다.

- 엔터프라이즈 프로덕션: Yi-Lightning은 경쟁력 있는 품질과 함께 가장 빠른 추론 시간을 제공하며, 실시간 애플리케이션에 이상적입니다.

- 연구 및 실험: Qwen3-Next와 Qwen3-Omni의 Apache 2.0 라이선스는 파인튜닝, 증류, 상용 배포에 어떤 제한도 없습니다.

MoE 아키텍처 합의: 밀집 모델 시대의 종말

무시할 수 없는 하나의 트렌드가 있습니다. 2025년에 출시된 모든 주요 오픈소스 LLM이 Mixture-of-Experts를 사용합니다. Qwen3-Next(80B 총, 3B 활성), DeepSeek V3.2(671B 총, ~37B 활성), GLM-4.5(355B), Yi-Lightning — 전부 MoE입니다. 프론티어급 오픈소스 AI에서 밀집 모델 시대는 사실상 끝났습니다.

이 합의가 중요한 이유는 MoE가 AI 배포의 경제학을 근본적으로 바꾸기 때문입니다. 1조 파라미터급 지식이 인코딩된 모델을 한 자릿수 십억 활성 파라미터로 실행할 수 있습니다. 훈련 비용은 더 높지만, 프로덕션에서 실제로 중요한 추론 비용은 극적으로 낮아집니다. 대규모로 AI를 운영하는 누구에게든, 이것은 트랜스포머 이후 가장 중요한 아키텍처 전환입니다.

2025년 9월은 오픈소스 AI가 더 이상 타협이 아니게 된 달로 기억될 것입니다. Qwen3-Omni, DeepSeek V3.2, 그리고 수십 개의 중국 주도 모델과 함께, 오픈소스 생태계는 이제 실리콘밸리의 최고 비공개 모델과 대등하거나 일부 영역에서는 능가합니다. 질문은 더 이상 ‘오픈소스 AI가 경쟁할 수 있는가’가 아닙니다. ‘비공개 AI가 그 프리미엄을 정당화할 수 있는가’입니다.

오픈소스 모델로 AI 파이프라인을 구축하거나, 프로덕션 스택에 맞는 LLM을 평가하는 데 도움이 필요하시다면 아키텍처 상담을 받아보세요.

매주 AI, 음악, 테크 트렌드를 이메일로 받아보세요.