DJI 미니 5 프로 리뷰: 249.9g에 1인치 센서와 4K120fps를 담은 드론의 모든 것

11월 27, 2025

2025 홀리데이 선물 가이드: 프로듀서가 진짜 좋아할 $100 이하 음악 프로덕션 선물 10선

11월 28, 2025오픈소스 AI 2025년 11월, 모델 5개가 동시에 쏟아졌습니다 — 그중 3개는 10배 비싼 상용 모델을 성능으로 이기고 있습니다. 이 한 달이 AI 업계의 힘의 균형을 오픈소스 쪽으로 영구히 기울였을 수도 있습니다.

모든 출력을 학습 데이터까지 추적할 수 있는 32B 추론 모델부터, 46억 원의 학습 비용으로 300번의 도구 호출을 연쇄적으로 수행하는 에이전틱 AI까지. 오픈소스 AI 2025년 11월은 단순히 바쁜 달이 아니었습니다. 전환점이었습니다.

1. OLMo 3 — 역대 가장 투명한 오픈소스 AI 모델

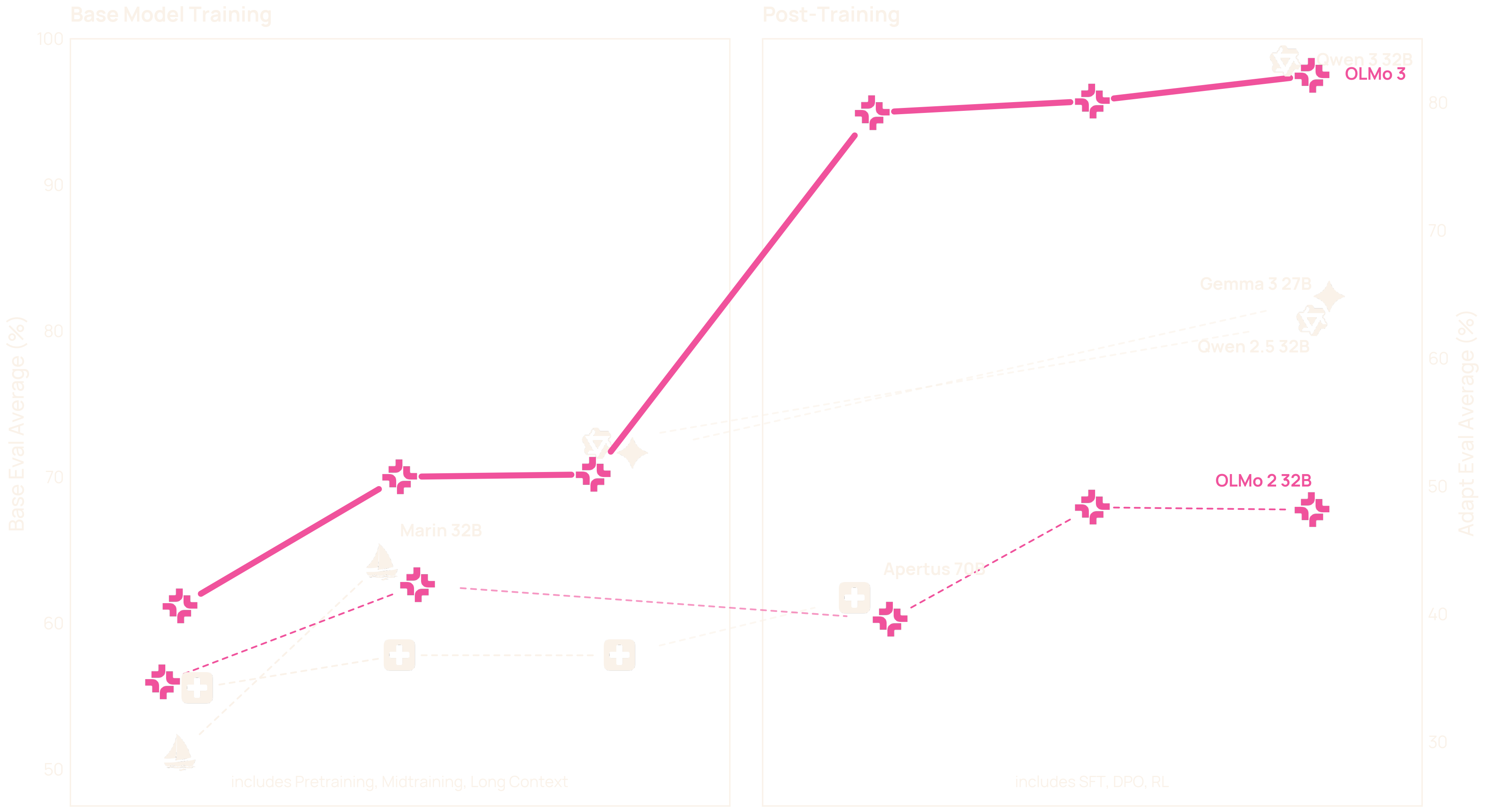

11월 20일, Allen Institute for AI(Ai2)가 OLMo 3을 공개하며 ‘오픈소스’의 정의 자체를 재설정했습니다. 대부분의 회사가 가중치만 공개하고 오픈소스라고 부르는 것과 달리, Ai2는 가중치, 학습 데이터, 학습 파이프라인, 평가 코드, 모든 체크포인트를 전부 공개했습니다.

OLMo 3은 7B와 32B 파라미터 변형으로 제공되며, 모두 65,536 토큰 컨텍스트 윈도우를 지원합니다. Dolma 3이라는 9.3조 토큰 규모의 코퍼스로 사전학습되었으며, 웹 페이지, olmOCR로 처리한 과학 PDF, 코드베이스, 수학 문제, 백과사전 텍스트가 포함됩니다. 결과적으로 GPU 시간 기준 Meta의 Llama 3.1보다 2.5배 효율적인 학습이 가능합니다.

진정한 게임체인저는 OlmoTrace입니다 — 출력이 어떤 학습 데이터에서 비롯되었는지 직접 추적할 수 있는 해석 가능성 도구입니다. 편향, 실패 모드, 데이터 오염을 조사하는 연구자에게 이는 전례 없는 수준의 투명성입니다. Think 변형은 수학, 코드, 일반 문제 해결을 위한 명시적 추론 체인을 추가하여, 32B 규모에서 Qwen 3 및 Gemma 3과 동등한 성능을 보여줍니다.

왜 중요한가: OLMo 3은 완전한 투명성이 성능 희생을 의미하지 않음을 증명합니다. 감사 가능성이 중요한 헬스케어, 법률, 금융 분야에서 AI를 구축한다면, 여기서 시작하십시오.

2. Kimi K2 Thinking — 60억 원으로 만든 에이전틱 AI의 다크호스

Moonshot AI가 11월 6일 Kimi K2 Thinking을 발표했습니다. 수치가 놀랍습니다. 1조 파라미터 규모의 MoE(Mixture-of-Experts) 모델이 불과 460만 달러(약 60억 원)의 학습 비용으로 만들어졌고, 인간 개입 없이 200~300회의 연속 도구 호출을 자율적으로 수행합니다.

K2 Thinking은 단순한 추론 모델이 아닙니다. “모델을 에이전트로” 철학에서 설계된 최초의 오픈소스 ‘생각하는 에이전트’입니다. 수백 단계에 걸쳐 일관된 추론을 수행하고, 사용 가능한 도구를 자동 선택하며, 상세한 추론 체인을 생성한 후 솔루션을 제공합니다.

벤치마크 결과도 과대광고가 아님을 증명합니다: HLE(도구 사용) 44.9%, BrowseComp 60.2%, SWE-Bench Verified 71.3%. SWE-Bench 점수는 실제 소프트웨어 엔지니어링 작업에서 최상위 상용 모델과 직접 경쟁하는 수준입니다. 자율 AI 워크플로우를 구축하는 개발자에게 K2 Thinking은 기다려왔던 오픈소스 솔루션입니다.

3. DeepSeek Math V2 — 3.8억 원으로 수학 올림피아드 금메달

DeepSeek가 또다시 체급을 뛰어넘었습니다. 11월 25일 공개된 DeepSeek Math V2는 IMO 2025에서 42점 만점에 35점으로 금메달을 획득했고, Putnam 2024 시험에서 120점 만점에 118점을 기록했습니다. 학습 비용은 고작 29만 4천 달러(약 3.8억 원)입니다.

이 모델은 하이브리드 사고/비사고 모드를 도입하여 사용자가 계산 노력을 직접 제어할 수 있습니다. 본질적으로 정확도와 추론 비용 간의 균형을 맞추는 ‘사고 예산’ 시스템입니다. 일부 쿼리에는 올림피아드 수준의 수학 추론이 필요하지만, 다른 쿼리에는 빠르고 저렴한 응답이 필요한 프로덕션 환경에서 혁신적인 접근법입니다.

MIT 라이선스로 Hugging Face에 전체 가중치가 공개된 DeepSeek Math V2는, 오픈소스 AI가 상용 모델과 경쟁하는 것이 아니라 금메달을 따고 있다는 사실을 다시 한번 확인시켜 줍니다. 말 그대로 금메달입니다.

4. IBM Granite 4.0 Nano — 브라우저에서 돌아가는 엔터프라이즈 AI

IBM은 Granite 4.0 Nano로 완전히 다른 방향을 택했습니다. 엣지와 온디바이스 AI에 초점을 맞춘 Nano 제품군은 3억 5천만~15억 파라미터 규모로, Apache 2.0 라이선스로 공개되었습니다. 상업적 사용, 수정, 재배포가 완전히 자유롭습니다.

Granite 4.0 Nano의 특별한 점은 Mamba-2 기반의 하이브리드 SSM(상태 공간 모델) + 트랜스포머 아키텍처입니다. 350M 변형은 웹 브라우저에서 편안하게 실행됩니다. 1.5B 모델은 6-8GB VRAM이면 충분합니다. 두 모델 모두 15조+ 토큰으로 학습된 전체 Granite 4.0의 학습 레시피를 상속받았습니다.

엔터프라이즈 사용자를 위해 IBM은 암호화 서명, ISO 42001 인증, 완전한 출처 추적 기능을 추가했습니다. 연구용 장난감이 아니라, 클라우드 서버를 전혀 거치지 않고 스마트폰과 노트북에서 실행되는 프로덕션 레디, 프라이버시 우선 AI입니다. 블랙 프라이데이 시즌에 엣지 AI 도입 논의가 활발한 시점에서, 완벽한 타이밍입니다.

5. Qwen 2.5 — 조용하지만 강력한 다국어 최강자

Alibaba의 Qwen 2.5 제품군은 극적인 단일 출시 이벤트 없이 11월 내내 꾸준한 업데이트를 이어갔고, 그 결과 Hugging Face에서 가장 많이 다운로드된 오픈소스 모델 패밀리가 되었습니다. 72B Instruct 변형이 다국어 벤치마크를 선도하며, 월간 다운로드가 25-35%씩 증가하고 있습니다.

Qwen 2.5의 강점은 폭넓은 커버리지입니다. Dense 및 MoE 아키텍처, 비전 및 옴니 모델, 코딩 전문가, 임베딩/리랭커 모델까지 포괄합니다. 다국어 애플리케이션 — 특히 CJK(중일한) 언어 — 에서 Qwen 2.5는 사실상의 기본 선택이 되었습니다. 내부 테스트에서 체인-오브-소트를 비활성화했을 때도 예상보다 더 많은 워드 문제를 깔끔하게 풀었고, 단위 환각도 경쟁 모델보다 적었습니다.

GitHub 스타 성장률이 늦여름 이후 최고치를 기록하고 있으며, 엔터프라이즈 도입도 가속화되고 있습니다. 다국어 지원이 필요한 오픈소스 기반을 구축한다면, Qwen 2.5 72B가 이길 벤치마크입니다.

큰 그림: 2025년 11월이 바꾼 오픈소스 AI의 판도

이 다섯 가지 릴리스를 함께 살펴보면, 명확한 패턴이 드러납니다. 오픈소스 AI 2025년 11월은 단순히 상용 모델을 따라잡는 수준이 아닙니다 — 상용 모델이 따라할 수 없는 방식으로 차별화되고 있습니다:

- 완전한 투명성 (OLMo 3) — 가중치뿐 아니라 전체 파이프라인 공개

- 에이전틱 역량 (Kimi K2 Thinking) — 300회 도구 호출, 자율 워크플로우

- 비용 효율성 (DeepSeek Math V2) — 3.8억 원으로 금메달 성능

- 엣지 배포 (Granite 4.0 Nano) — 브라우저에서 엔터프라이즈 AI

- 다국어 지배력 (Qwen 2.5) — 가장 넓은 모델 패밀리

블랙 프라이데이 시즌에 AI 스택을 평가하는 개발자와 조직에게 메시지는 분명합니다: 최고의 오픈소스 AI 모델은 단순한 무료 대안이 아닙니다. 종종 더 나은 기술적 선택입니다. 오픈소스 AI를 채택할 것인지가 아니라, 이 모델들 중 어떤 것이 사용 사례에 가장 적합한지가 질문입니다.

오픈소스 AI 모델을 프로덕션 파이프라인에 통합하고 싶으신가요? 모델 선택부터 배포 아키텍처까지, 최적의 스택 구축을 도와드립니다.

매주 AI, 음악, 테크 트렌드를 이메일로 받아보세요.