Google Nest Cam Outdoor 2025 유출: 2K HDR, 6배 줌, Gemini AI가 홈 보안을 바꾼다

8월 27, 2025

초보자를 위한 최고의 MIDI 키보드: 2025년 $150 이하 Top 5 추천

8월 28, 202514B 파라미터 모델이 70B 모델을 이겼습니다. 오픈소스 AI 모델 2025년 8월, 작지만 강력한 모델들이 대형 모델의 아성을 무너뜨리고 있습니다. Mistral은 “Medium이 새로운 Large”라고 선언했고, Microsoft의 Phi-4는 자신보다 5배 큰 모델을 추론 벤치마크에서 압도했으며, Falcon H1은 하이브리드 아키텍처로 256K 컨텍스트 윈도우를 열었습니다. 이번 달 오픈소스 AI 생태계에서 무슨 일이 벌어졌는지, 핵심만 정리해 드립니다.

Mistral Medium 3.1: “Medium이 새로운 Large”의 증명

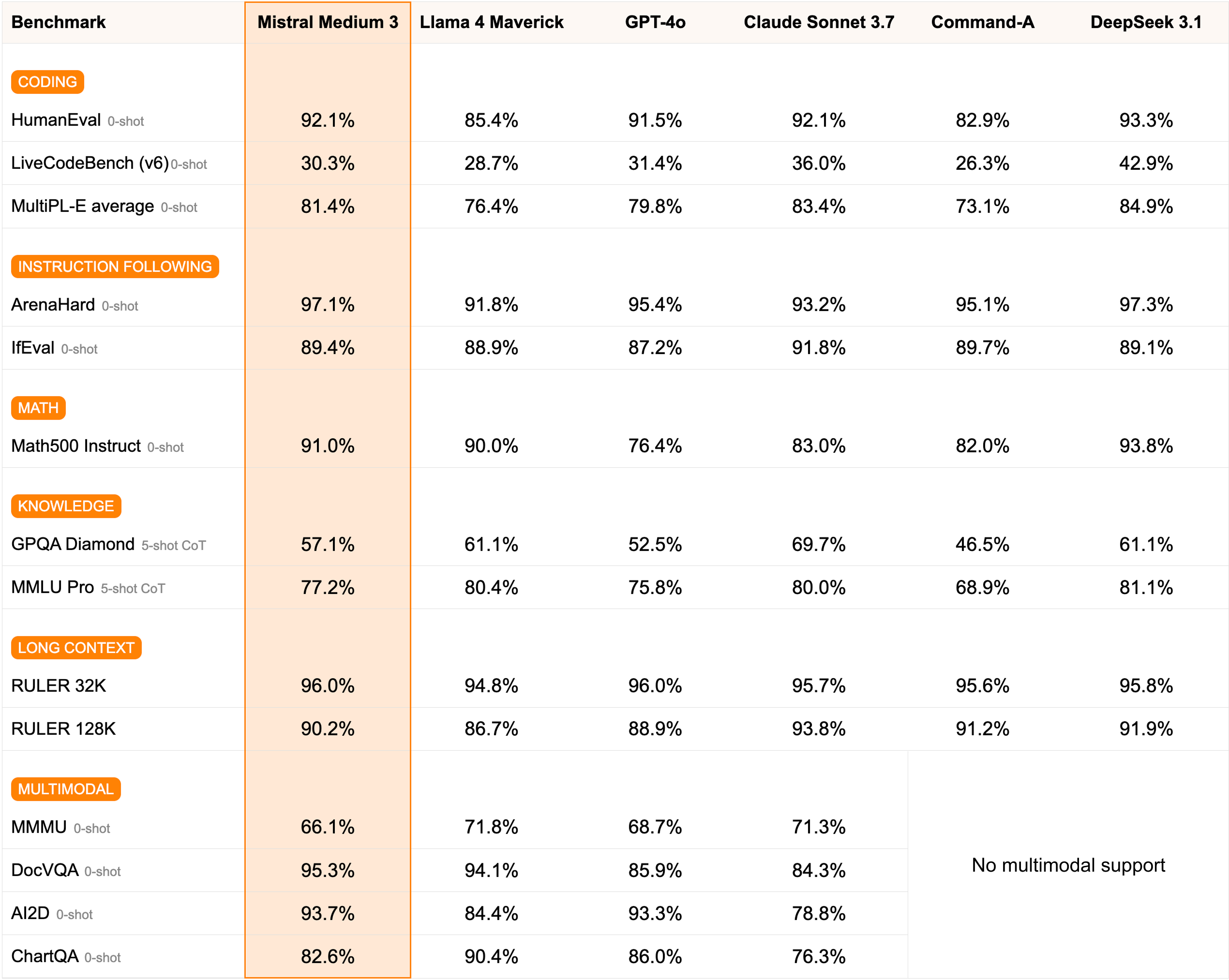

2025년 8월 12일, Mistral AI가 Medium 3.1을 공개했습니다. 이 모델은 프론티어급 멀티모달 모델로, 128K 토큰 컨텍스트 윈도우와 얼리 퓨전(early-fusion) 멀티모달 아키텍처를 탑재했습니다. Artificial Analysis Intelligence Index에서 21점을 기록하며 비추론(non-reasoning) 모델 중 평균 이상의 성능을 보여주었습니다.

가장 주목할 점은 가격 대비 성능입니다. 입력 토큰 100만 개당 $0.40, 출력 토큰 100만 개당 $2.00으로, Claude Sonnet 3.7 성능의 약 90%를 훨씬 낮은 비용으로 달성합니다. Mistral AI 공식 발표에 따르면, 경쟁 모델 대비 8배 낮은 비용으로 엔터프라이즈 배포를 단순화할 수 있다고 합니다.

특히 자체 호스팅이 가능하다는 점이 기업 고객에게 매력적입니다. GPU 4개 이상이면 어떤 클라우드 환경에서든 배포할 수 있어, 데이터 주권이 중요한 규제 산업에서 채택이 빠르게 늘고 있습니다. 5월에 출시된 Medium 3의 성능을 개선한 3.1 버전은 응답 톤과 전반적인 퍼포먼스가 한 단계 향상되었습니다.

Microsoft Phi-4: 14B가 70B를 이기는 시대

Microsoft의 Phi-4 추론 모델은 오픈소스 AI 모델 2025년 8월의 가장 인상적인 사례 중 하나입니다. MIT 라이선스로 공개된 이 14B 파라미터 모델은 DeepSeek-R1 distilled 70B 모델보다 뛰어난 추론 성능을 보여주었습니다. 모델 크기가 5분의 1에 불과한데도 말입니다.

Phi-4 패밀리는 세 가지 변형으로 나뉩니다. 기본 Phi-4-reasoning, 추론 시 1.5배 더 많은 토큰을 사용해 정확도를 높인 Phi-4-reasoning-plus, 그리고 경량화된 Phi-4-mini-reasoning입니다. 2025년 5월 15일부터는 Snapdragon Copilot+ PC용 ONNX 최적화 버전도 제공되어, 로컬 디바이스에서 직접 추론 모델을 돌릴 수 있게 되었습니다.

7월에는 Phi-4-mini-Flash-Reasoning이 추가 공개되어 효율적인 장문 컨텍스트 추론이 가능해졌습니다. 컴팩트한 아키텍처로 추론 효율성을 극대화한 이 모델은 엣지 디바이스와 리소스 제한 환경에서의 AI 활용 가능성을 크게 넓혔습니다. Microsoft는 여름 내내 Phi-4 패밀리를 꾸준히 확장하며 “작지만 강한 모델” 전략을 밀어붙이고 있습니다.

Falcon H1: 하이브리드 아키텍처의 새 지평

UAE의 Technology Innovation Institute(TII)가 공개한 Falcon H1은 하이브리드 Transformer-Mamba 아키텍처를 채택한 혁신적인 모델입니다. Transformer의 어텐션 메커니즘과 State Space Model(SSM)의 효율성을 결합하여, 256K 컨텍스트 윈도우를 지원하면서도 뛰어난 추론 속도를 달성했습니다.

0.5B부터 34B까지 6개 크기의 모델이 제공되며, 각각 기본(base)과 지시 조정(instruction-tuned) 변형이 있습니다. 다국어 지원이 강점으로, 고자원 언어뿐 아니라 저자원 언어까지 커버합니다. Falcon 시리즈 전체 다운로드 수는 5,500만 건을 돌파했습니다.

특히 주목할 점은 NVIDIA NIM 마이크로서비스와의 통합입니다. 이를 통해 규제가 엄격하고 레이턴시에 민감한 환경에서도 즉시 배포가 가능합니다. 소버린 AI(Sovereign AI) 배포를 위한 포지셔닝은 데이터 주권이 중요한 정부기관과 금융기관에서 큰 관심을 끌고 있습니다.

Hot Chips 2025: AI 칩 전쟁의 최전선

8월 24일부터 26일까지 스탠포드 대학에서 열린 Hot Chips 2025는 AI 하드웨어의 미래를 보여주는 무대였습니다. NVIDIA는 Blackwell 아키텍처, NVLink, Spectrum-X 추론 가속을 선보였고, AMD는 CDNA 4/MI350을, Google은 Ironwood TPU를 발표했습니다.

Noam Shazeer의 키노트는 AI의 다음 단계에 대한 예측으로 업계의 이목을 집중시켰습니다. Qualcomm의 Snapdragon X AI PC용 Oryon CPU 코어 발표는 앞서 언급한 Phi-4의 온디바이스 추론과 맞물려, 클라우드에 의존하지 않는 로컬 AI의 가능성을 보여주었습니다. 컨퍼런스의 핵심 주제는 단연 “AI 팩토리를 위한 조 단위 데이터센터 컴퓨팅 시장”이었습니다.

오픈소스 AI 생태계의 거시적 변화

2025년 여름을 관통하는 가장 큰 트렌드는 중국 오픈소스 모델의 부상입니다. 한 업계 분석에 따르면, Hugging Face의 총 모델 다운로드 비중이 미국 중심에서 중국 중심으로 전환되었습니다. Qwen이 Llama를 제치고 가장 많이 다운로드되고 파인튜닝되는 베이스 모델이 되었으며, Hugging Face에는 매일 1,000~2,000개의 새 모델이 업로드되고 있습니다.

Red Hat Developer의 분석에서도 2025년은 오픈소스 AI의 전환점으로 평가됩니다. DeepSeek과 Qwen이 업계에서 주요 이름으로 자리잡았고, 더 작고 효율적인 모델이 2025년 전체를 관통하는 메가 트렌드가 되었습니다. 온프레미스 LLM 솔루션이 시장의 절반 이상을 차지하면서, 클라우드 API 의존도를 낮추려는 기업들의 수요가 뚜렷하게 드러나고 있습니다.

실무자 관점: 어떤 모델을 선택할 것인가

이번 달 업데이트를 종합하면, 용도별로 명확한 선택지가 보입니다. 비용 효율적인 멀티모달 작업에는 Mistral Medium 3.1이 강력한 후보입니다. Claude Sonnet 3.7의 90% 성능을 훨씬 저렴하게 쓸 수 있으니까요. 추론 중심 작업에는 Phi-4 패밀리가 크기 대비 놀라운 성능을 보여줍니다. 특히 로컬 디바이스에서 돌려야 한다면 Phi-4-mini-reasoning이 현실적인 선택입니다.

장문 컨텍스트 처리와 다국어 지원이 중요하다면 Falcon H1을 눈여겨볼 만합니다. 256K 컨텍스트 윈도우와 하이브리드 아키텍처는 긴 문서 분석이나 다국어 서비스에서 차별화된 강점을 제공합니다. NVIDIA NIM 통합으로 엔터프라이즈 배포도 수월합니다.

2025년 8월의 오픈소스 AI 생태계는 “크기보다 효율”이라는 방향으로 확실히 움직이고 있습니다. 14B 모델이 70B를 이기고, Medium이 Large를 대체하며, 하이브리드 아키텍처가 순수 Transformer의 한계를 돌파하고 있습니다. 이 흐름은 가속화될 것이며, 기업이든 개인 개발자든 오픈소스 모델을 무시할 수 없는 시대가 되었습니다.

오픈소스 AI 모델 도입이나 자동화 파이프라인 구축에 대해 더 알고 싶으시다면, Sean Kim이 도와드리겠습니다.

매주 AI, 음악, 테크 트렌드를 이메일로 받아보세요.