2025년 10월 최고의 게이밍 노트북 7선: 홀리데이 시즌 구매 가이드

10월 10, 2025

신스웨이브 프로덕션 테크닉: 현대 도구로 완성하는 80년대 레트로 사운드 가이드

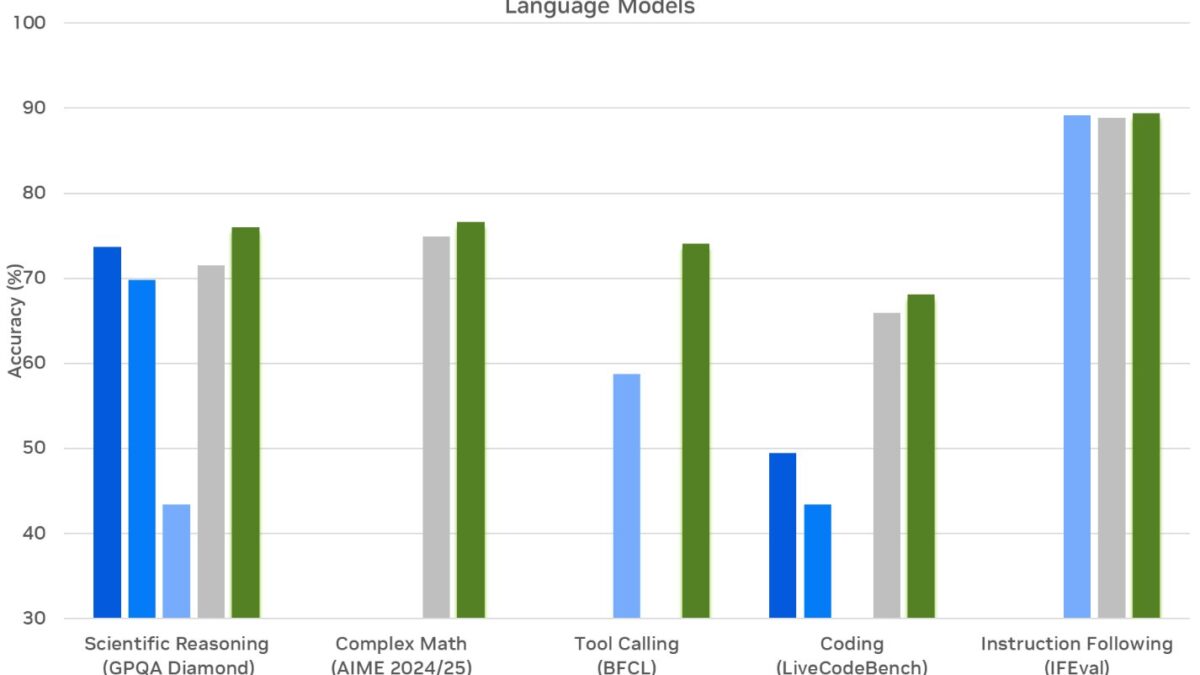

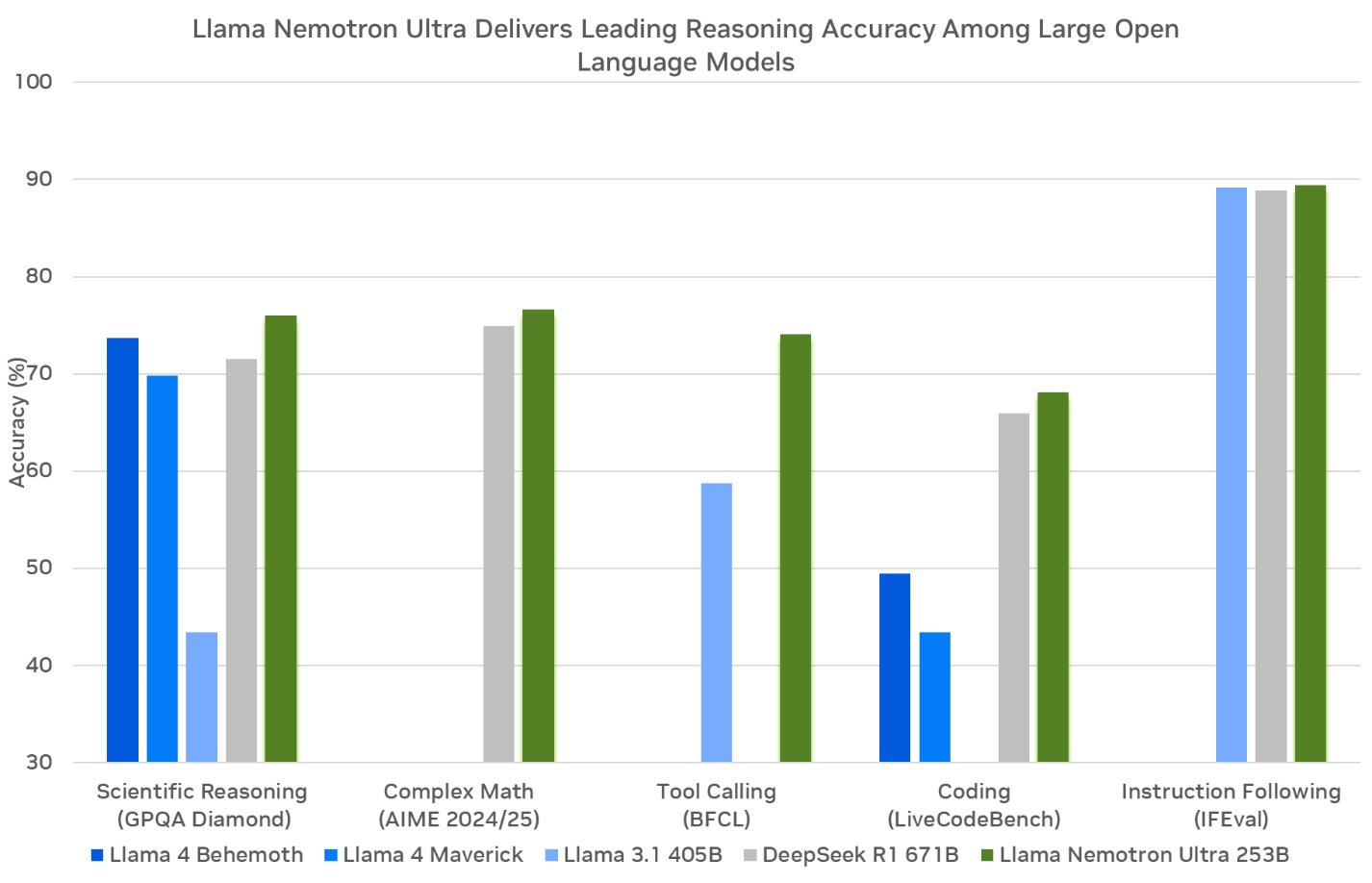

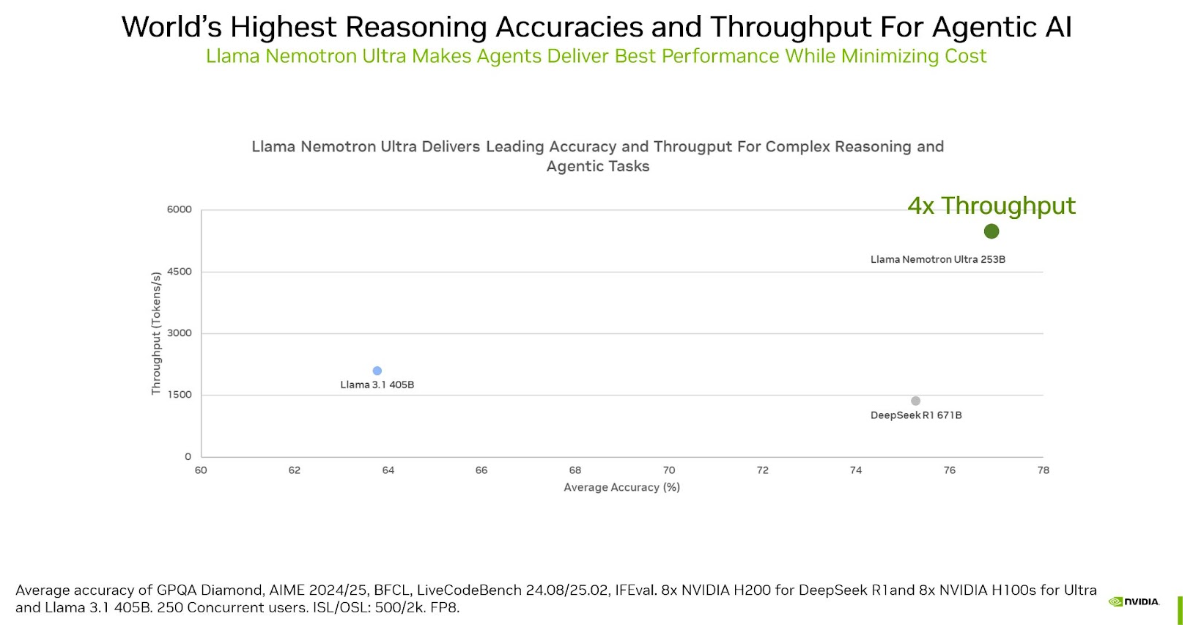

10월 13, 2025추론 능력을 스위치처럼 켜고 끌 수 있는 오픈소스 AI 모델이 나왔습니다. NVIDIA Llama Nemotron 시리즈가 MATH500 벤치마크에서 36.6%를 95.4%로 끌어올리고, DeepSeek R1 대비 최대 5배 처리량을 기록하면서 AI 에이전트 시장의 판도를 바꾸고 있습니다.

” alt=”NVIDIA Llama Nemotron 벤치마크 성능 비교”/>

NVIDIA Llama Nemotron 3형제: Ultra, Super, Nano

NVIDIA가 이번에 공개한 Llama Nemotron 패밀리는 세 가지 모델로 구성됩니다. 가장 강력한 Ultra(253B)는 Llama 3.1 405B에서 증류된 모델로, 단일 8xH100 노드에서 FP8으로 배포할 수 있습니다. Super(49B)는 Llama 3.1 70B 기반으로 증류되었으며, Nano(8B)는 Llama 3.1 8B를 기반으로 합니다. 각 모델은 엔터프라이즈 배포 규모에 맞춰 설계되었습니다.

특히 주목할 점은 학습 방식입니다. 600억 토큰의 합성 데이터로 SFT(Supervised Fine-Tuning)를 진행한 뒤, REINFORCE 강화학습과 HelpSteer2 데이터셋을 활용해 정교하게 다듬었습니다. 단순히 모델 크기만 키운 것이 아니라, 학습 파이프라인 자체를 혁신한 결과물입니다.

동적 추론 토글: 오픈소스 최초의 ON/OFF 스위치

Llama Nemotron 시리즈의 가장 혁신적인 기능은 동적 추론 토글(Dynamic Reasoning Toggle)입니다. 시스템 프롬프트 하나로 추론 모드를 켜고 끌 수 있는 오픈소스 최초의 모델입니다. 이것이 왜 중요할까요?

모든 작업에 깊은 추론이 필요하지는 않습니다. 간단한 분류나 요약 작업에는 추론을 끄고 빠르게 처리하고, 복잡한 수학 문제나 코드 생성에는 추론을 켜서 정확도를 극대화할 수 있습니다. 이 유연성 덕분에 하나의 모델로 다양한 워크로드를 효율적으로 처리할 수 있게 됩니다.

벤치마크 수치가 이를 증명합니다. Nano(8B)는 MATH500에서 추론 OFF 상태의 36.6%에서 추론 ON으로 95.4%까지 치솟았습니다. Super(49B) 역시 74.0%에서 96.6%로 도약했으며, MT-Bench에서 9.17점을 기록했습니다. Ultra(253B)는 Arena Hard에서 92.7점을 달성하며, 기존 베이스 모델 대비 20% 이상의 정확도 향상을 보여주었습니다.

DeepSeek R1을 압도하는 처리량과 성능

NVIDIA가 DeepSeek R1과의 직접 비교를 내세운 것은 자신감의 표현입니다. Ultra(253B)는 DeepSeek R1 671B 대비 4배의 처리량을 기록했습니다. 파라미터 수는 절반도 안 되지만 속도는 4배 빠른 셈입니다. Super(49B)는 DeepSeek R1 Llama 70B 대비 5배의 처리량을 보여주었습니다.

엔터프라이즈 환경에서 이 차이는 결정적입니다. 동일한 하드웨어에서 4~5배 더 많은 요청을 처리할 수 있다는 것은 인프라 비용을 극적으로 줄일 수 있다는 뜻이기 때문입니다. 특히 AI 에이전트처럼 반복적인 추론 호출이 필요한 워크로드에서는 처리량이 곧 경쟁력입니다.

” alt=”NVIDIA Llama Nemotron AI 에이전트 워크플로우”/>

Nemotron-CORTEXA: o3를 넘어선 코딩 에이전트

Llama Nemotron 패밀리에서 가장 주목해야 할 부분은 에이전틱 AI 성능입니다. NVIDIA의 Nemotron-CORTEXA는 SWE-bench Verified에서 68.2%를 달성하며 OpenAI의 o3(66%)를 넘어섰습니다. SWE-bench Verified는 실제 GitHub 이슈를 자동으로 해결하는 능력을 측정하는 벤치마크로, 현실 세계의 소프트웨어 엔지니어링 역량을 가장 잘 반영하는 지표 중 하나입니다.

이 결과는 오픈소스 모델이 폐쇄형 모델의 코딩 능력을 처음으로 넘어선 사례로 기록될 수 있습니다. AI 에이전트가 단순히 코드를 생성하는 것을 넘어, 버그를 진단하고 수정하며 풀 리퀘스트를 제출하는 수준에 도달했다는 뜻입니다.

확장되는 Nemotron 생태계

NVIDIA는 Llama Nemotron 외에도 생태계를 빠르게 확장하고 있습니다. Mistral-Nemotron은 Mistral 아키텍처 기반의 변형 모델이고, AceReasoning 14B는 중간 규모에서 강력한 추론 성능을 목표로 합니다. Nemotron-H는 하이브리드 아키텍처를 실험하는 모델이며, Safety Guard V2는 81.6% 정확도로 AI 안전성을 담보합니다.

배포 측면에서도 진입 장벽을 낮추었습니다. Hugging Face에서 오픈 웨이트를 직접 다운로드할 수 있고, NVIDIA의 NIM 마이크로서비스를 통해 API 형태로 즉시 사용할 수 있으며, build.nvidia.com에서 무료로 체험해 볼 수도 있습니다. 엔터프라이즈 파트너들과의 통합도 진행 중입니다.

AI 에이전트 시대, 오픈소스가 기준을 세우다

Llama Nemotron 시리즈의 출시는 단순한 모델 공개를 넘어서는 의미가 있습니다. 동적 추론 토글이라는 새로운 패러다임을 제시했고, DeepSeek R1 대비 4~5배의 처리량으로 비용 효율성을 입증했으며, SWE-bench에서 o3를 넘기며 오픈소스 모델의 실전 능력을 증명했습니다. 8B부터 253B까지 다양한 스케일의 모델을 제공함으로써 엣지 디바이스부터 데이터센터까지 모든 규모의 배포를 지원합니다.

AI 에이전트를 구축하거나 기존 시스템에 추론 능력을 추가하려는 팀이라면, NVIDIA Llama Nemotron은 현시점에서 가장 실용적인 선택지입니다. 오픈소스의 투명성과 NVIDIA 인프라의 안정성을 동시에 누릴 수 있다는 점에서, 엔터프라이즈 AI의 새로운 기준이 될 가능성이 높습니다.

AI 에이전트 시스템 구축이나 LLM 기반 자동화 파이프라인에 관심이 있으시다면, 기술 컨설팅을 통해 최적의 아키텍처를 설계해 드립니다.

매주 AI, 음악, 테크 트렌드를 이메일로 받아보세요.