Meta Llama 4 Scout: 17B 파라미터 모델이 10개월 만에 엔터프라이즈 AI 비용을 80% 절감한 비결

2월 9, 2026

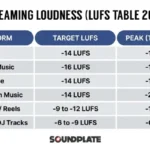

라우드니스 마스터링 스트리밍 플랫폼별 2026 LUFS 표준 완벽 가이드

2월 10, 2026H100 하나 구하려고 6개월 대기열에 섰던 게 엊그제 같은데, NVIDIA가 또 한 번 판을 뒤집었습니다. 2026년 1월 첫 출하를 시작한 NVIDIA Blackwell B300이 이제 본격 양산 체제에 돌입하면서, AI 인프라 시장의 게임 규칙이 완전히 달라지고 있습니다. GPU당 288GB HBM3e, Dense FP4 15 PFLOPS, 그리고 2026년 연간 60,000 랙 출하 전망. 이 숫자들이 의미하는 바를 하나씩 풀어보겠습니다.

NVIDIA Blackwell B300 핵심 스펙: 288GB HBM3e의 위력

NVIDIA Blackwell B300(공식 명칭 ‘Blackwell Ultra’)의 가장 큰 변화는 메모리입니다. GPU당 288GB HBM3e를 탑재하여 전작 B200의 180GB 대비 55.6% 증가했습니다. 12-hi 스택 구성으로 메모리 대역폭도 8TB/s에 달하며, B200의 7.7TB/s를 넘어섰습니다. 이는 단순한 스펙 업그레이드가 아닙니다. 1조 파라미터 규모의 프론티어 모델을 단일 노드에서 파인튜닝하고 추론할 수 있는 길이 열린 것입니다.

연산 성능 역시 세대 간 격차를 확실히 보여줍니다. Dense FP4 기준 15 PFLOPS를 달성하며, B200 대비 1.5배 빠릅니다. FP8 기준으로는 7,000 TFLOPS, FP16에서는 3,500 TFLOPS를 제공합니다. H200 대비 FP8 처리량은 약 3.5배 향상되었습니다. 실제 LLM 추론 벤치마크에서 H100 대비 11~15배의 처리량 향상이 확인되었으며, Llama 70B 모델 기준 FP8에서 약 100,000 tok/s, FP4에서는 150,000+ tok/s를 달성한 것으로 보고되고 있습니다.

트레이닝 워크로드에서도 개선이 두드러집니다. NVIDIA 내부 MLPerf 스타일 벤치마크에서 GPT-4급 모델의 학습 처리량이 B200 대비 35% 향상되었고, LLM 서빙 시 토큰 처리 속도는 45~50% 개선되었습니다. TDP는 GPU당 1,400W로 상당히 높지만, 와트당 성능(performance-per-watt)으로 환산하면 전 세대 대비 효율이 개선되었습니다.

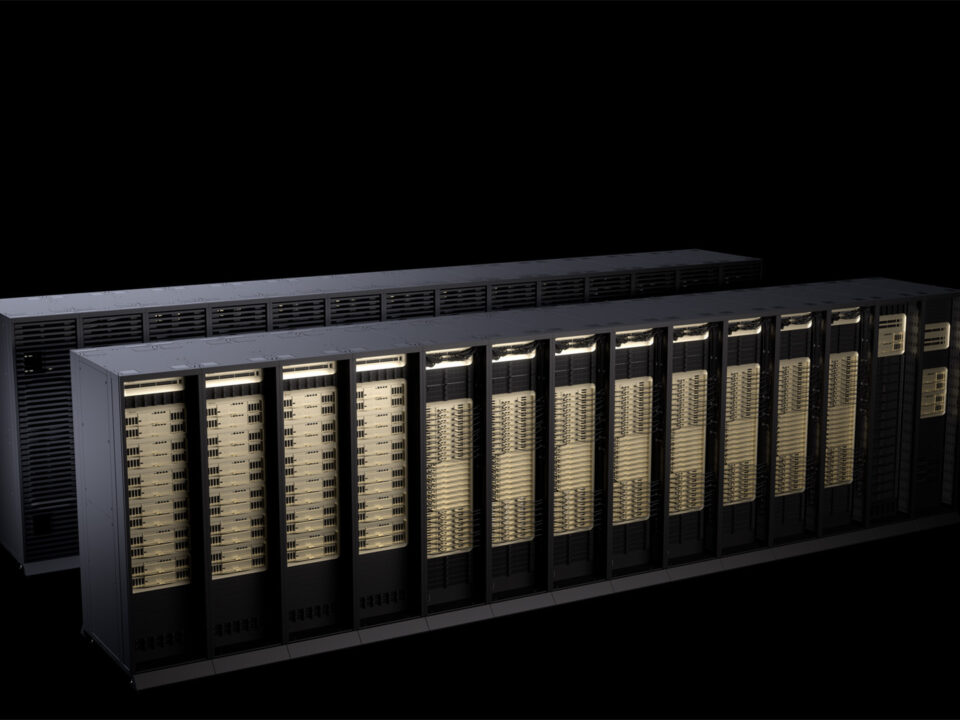

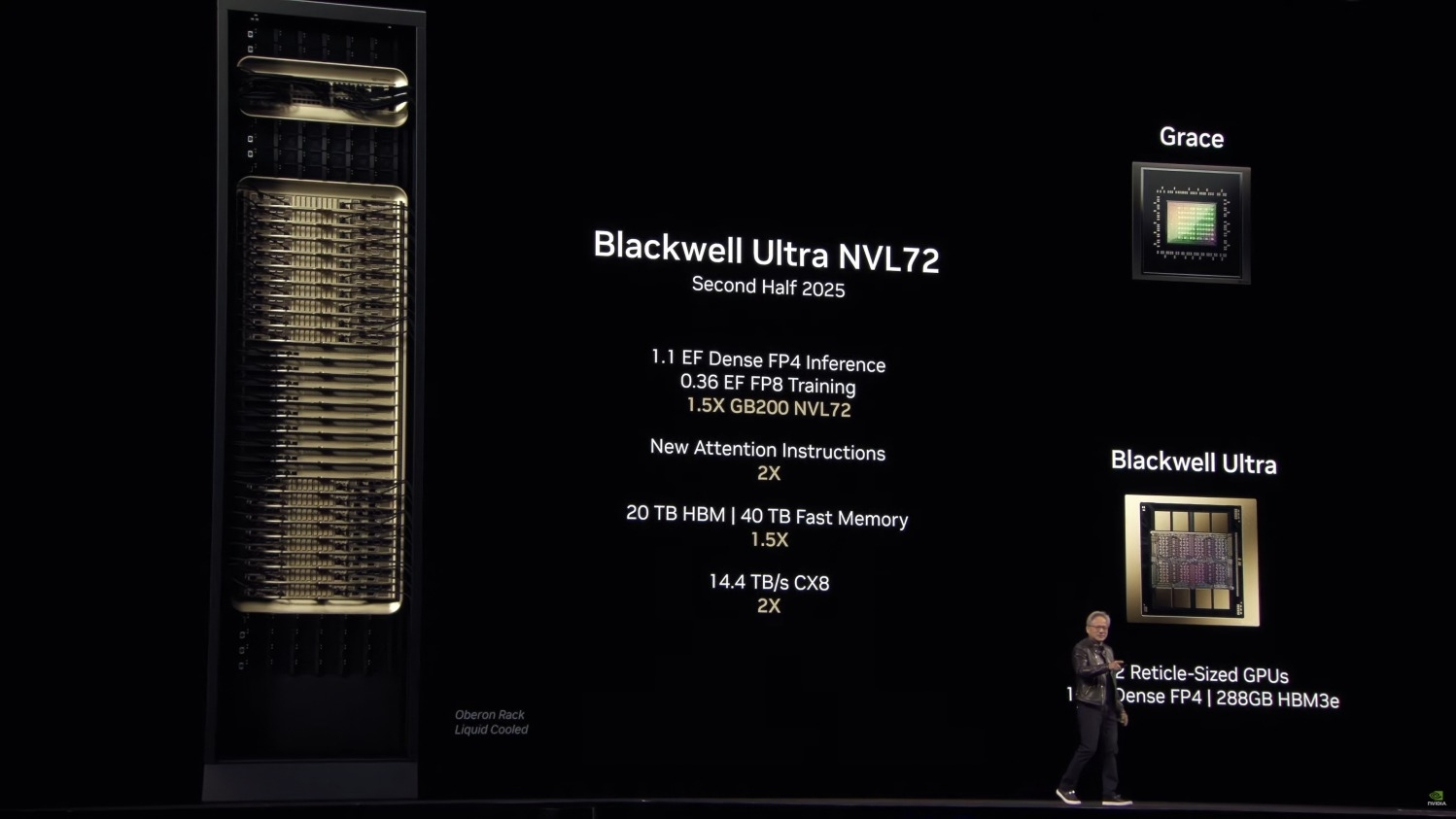

GB300 NVL72: 한 랙에 1.1 엑사플롭스를 담다

개별 GPU 성능도 중요하지만, 진짜 혁신은 시스템 레벨에서 나타납니다. GB300 NVL72는 72개의 Blackwell Ultra GPU와 36개의 Arm 기반 Grace CPU를 하나의 완전 액체 냉각 랙에 통합한 시스템입니다. 이 단일 랙의 FP4 성능이 무려 1.1 엑사플롭스에 달합니다. 불과 몇 년 전까지 국가 연구기관급 슈퍼컴퓨터에서나 가능했던 연산 능력이 이제 서버 랙 하나에 담긴 것입니다.

NVLink 5를 통해 GPU 간 1.8TB/s 대역폭을 확보했고, ConnectX-8 네트워킹은 이전 세대 대비 2배인 1.6T를 지원합니다. DGX B300 시스템(8-GPU 구성)은 Intel Xeon 6776P 프로세서와 결합하여 총 2.1TB의 GPU 메모리를 제공합니다. 공랭은 이 전력 밀도에서는 물리적으로 불가능하며, 모든 B300 시스템은 DLC(Direct Liquid Cooling) 설계가 필수입니다.

양산 현황과 공급망: 2026년 60,000 랙 출하 전망

숫자로 보면 상황이 더 명확해집니다. 모건 스탠리의 전망에 따르면, NVIDIA AI 서버 캐비닛 수요는 2025년 약 28,000대에서 2026년 최소 60,000대로 2배 이상 증가할 것으로 예상됩니다. GB300 출하량은 전년 대비 129% 증가가 예측됩니다. NVIDIA가 이전 세대 Bianca 보드 구성으로 회귀하면서 양산 수율이 개선되었고, 이는 Cordelia 설계 대비 제조 복잡성을 줄이는 전략적 판단이었습니다.

공급망도 빠르게 가동 중입니다. 폭스콘(Hon Hai)이 GB200과 GB300 풀 캐비닛 양산 및 납품을 최초로 완료했으며, Quanta, Wistron, Wiwynn 등 ODM 제조사들도 NVIDIA Certified Systems 인증을 받고 양산에 합류했습니다. TSMC는 애리조나 Fab 21에서 4NP 공정 실리콘을 대량 생산하며 북미 공급망 리스크를 크게 줄이고 있습니다. 이는 미중 갈등 속에서 반도체 공급 안정성이라는 지정학적 의미도 지닙니다.

HBM 공급 전쟁: 2026년 전량 매진의 의미

B300 양산의 실질적 병목은 GPU 다이 자체가 아니라 HBM3e 메모리입니다. SK하이닉스 CFO 김재준은 “2026년 HBM 전체 물량이 이미 매진되었다”고 명시했습니다. 삼성과 마이크론 역시 2025~2026년 HBM 생산분이 전량 계약 완료된 상태입니다. B300 한 개에 12-hi HBM3e 스택이 필요한데, 이 고밀도 패키징 기술의 양산 수율이 아직 완벽하지 않아 공급 병목이 더 심화되고 있습니다.

TSMC의 CoWoS(Chip-on-Wafer-on-Substrate) 패키징 역량도 월 95,000 웨이퍼 수준으로 확대되고 있지만, 수요를 따라잡기엔 여전히 빠듯합니다. 이런 공급 부족은 역설적으로 NVIDIA의 시장 지배력을 강화합니다. B300을 확보한 클라우드 제공업체는 프리미엄 가격을 책정할 수 있으며, 초기 클라우드 가격은 GPU당 시간당 $2.90~$18.00 수준에서 형성되고 있습니다. DGX B300 시스템(8-GPU)은 약 $300,000, 하이퍼스케일러 볼륨 가격은 $250,000 선입니다. 참고로 현재 H200 인스턴스는 $2.50~$3.80/hr, H100은 $1.49~$2.99/hr 수준입니다.

크리에이터와 개발자에게 의미하는 것

B300 양산이 본격화되면서 AI 인프라 접근성이 한 단계 올라갑니다. 288GB의 거대한 메모리 풀은 이전에는 불가능했던 규모의 모델 파인튜닝과 추론을 가능하게 합니다. Llama 70B 같은 대형 모델을 실시간으로 서빙하면서도 높은 배치 처리량을 유지할 수 있으며, 11~15배 향상된 추론 처리량은 AI 기반 음악 생성, 영상 처리, 텍스트 생성 서비스의 품질과 응답 속도를 직접적으로 끌어올립니다.

Microsoft, Amazon, Meta 등 하이퍼스케일러들이 대량 도입을 추진하면서, 클라우드 기반 AI 서비스의 가격 대비 성능도 점진적으로 개선될 전망입니다. 물론 이 성능을 직접 활용하려면 액체 냉각 인프라와 막대한 전력 공급이 필요하므로, 개인 스튜디오나 소규모 팀에게는 여전히 클라우드가 현실적인 선택입니다.

GPU 클라우드 시장의 경쟁이 격화되면서, B300 기반 인스턴스의 가격은 올해 하반기부터 하락 추세에 접어들 것으로 보입니다. 다음 세대인 Vera Rubin 아키텍처가 2026년 하반기에 예고되어 있어, B300의 가격 경쟁력은 더욱 높아질 수 있습니다. AI 기반 음악 제작, 영상 생성, 대규모 언어 모델 활용을 계획하고 있다면, 2026년 하반기가 비용 효율적으로 차세대 AI 컴퓨팅에 접근하는 최적의 타이밍이 될 수 있습니다.

매주 AI, 음악, 테크 트렌드를 이메일로 받아보세요.