DJI Air 4 리뷰 프리뷰: 유출된 스펙, 트리플 카메라, AI 추적 — 지금까지 알려진 모든 것

7월 28, 2025

Logic Pro iPad 2.2 업데이트 심층 리뷰: Dancefloor Rush부터 Flashback Capture까지, 비트메이커를 위한 5가지 핵심 변화

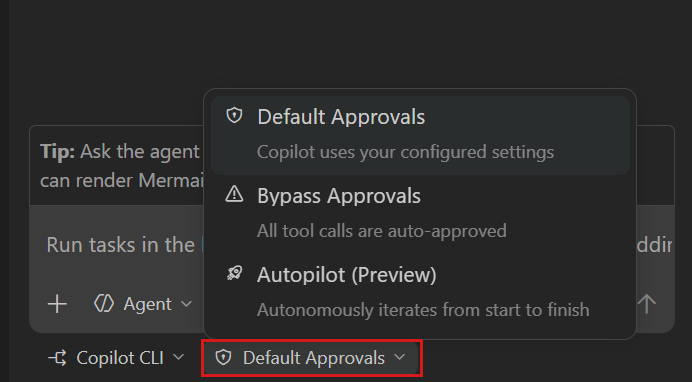

7월 29, 2025숫자 하나만 보겠습니다. 추론 요청 100건, 각 2초, 총 비용 $0.06. 같은 작업을 AWS에서 돌리면? $1.10입니다. GPU가 일하든 놀든 시간 단위로 과금되니까요. Modal Labs GPU 클라우드는 하나의 급진적인 아이디어 위에 세워졌습니다 — 유휴 GPU에 비용을 지불할 이유는 없다는 것.

Modal Labs GPU 클라우드가 다른 점

Modal은 임대한 NVIDIA 하드웨어에 대시보드를 씌운 또 다른 GPU 클라우드가 아닙니다. AI 워크로드 — 추론, 학습, 파인튜닝, 배치 처리 — 를 위해 처음부터 설계된 서버리스 컴퓨팅 플랫폼입니다. Python 네이티브 SDK로 전통적 ML 배포의 고질병인 YAML-Dockerfile 서커스를 완전히 제거했습니다.

핵심 제안은 놀라울 정도로 단순합니다. Python 함수를 작성하고, 필요한 GPU를 지정하는 @modal.gpu 데코레이터를 추가하고, 배포하면 됩니다. Modal이 컨테이너 오케스트레이션, GPU 프로비저닝, 오토스케일링, 해제를 모두 처리합니다. Kubernetes 매니페스트도, Terraform 설정도, 모델 하나 서빙하려고 47단계 CI/CD 파이프라인을 만들 필요도 없습니다.

Modal을 경쟁사와 구분하는 것은 1초 미만의 콜드 스타트입니다. GPU 컨테이너가 1초 이내에 가동됩니다 — 오토스케일러가 사전 워밍 없이 트래픽 스파이크를 처리해야 할 때 이 수치는 결정적입니다. 대부분의 서버리스 GPU 플랫폼이 10~30초의 콜드 스타트를 제시하는 반면, Oracle Cloud Infrastructure 베어메탈 인스턴스 위에 구축된 Modal의 아키텍처는 이를 10분의 1로 줄였습니다.

Modal Labs GPU 클라우드 가격: 초당 과금의 위력

Modal의 가격 모델이 진짜 이야기입니다. 보급형 T4부터 플래그십 B200까지 모든 GPU가 초당 과금됩니다. 현재 가격표입니다:

- NVIDIA T4: $0.000164/초 (~$0.59/시간)

- NVIDIA L4: $0.000222/초 (~$0.80/시간)

- NVIDIA A10G: $0.000306/초 (~$1.10/시간)

- NVIDIA L40S: $0.000542/초 (~$1.95/시간)

- NVIDIA A100 40GB: $0.000583/초 (~$2.10/시간)

- NVIDIA A100 80GB: $0.000694/초 (~$2.50/시간)

- NVIDIA H100: $0.001097/초 (~$3.95/시간)

- NVIDIA H200: $0.001261/초 (~$4.54/시간)

- NVIDIA B200: $0.001736/초 (~$6.25/시간)

Starter 플랜은 무료이며 월 $30 크레딧이 제공됩니다 — T4 추론 약 27시간, H100 컴퓨팅 약 7.5시간을 무료로 사용할 수 있는 금액입니다. Team 플랜은 월 $250이며 $100 크레딧과 1,000개 동시 컨테이너, 50개 GPU 동시 실행 슬롯을 제공합니다.

실제 비용 비교: Modal Labs GPU 클라우드 vs AWS vs Azure vs Lambda

동일한 NVIDIA A10G 워크로드의 제공자별 비용을 비교해 보겠습니다:

- Modal: $1.10/시간 (초당 과금 — 사용한 만큼만 지불)

- AWS G5.xlarge 온디맨드: $1.10/시간 (시간 단위 최소 과금)

- AWS G5.xlarge 스팟: ~$0.43/시간 (중단될 수 있음)

- AWS 1년 예약: ~$0.70/시간 (선결제 약정)

- Lambda Labs: $0.75/시간 (온디맨드, 서버리스 없음)

- Azure NVads A10 v5 스팟: ~$0.60/시간 (중단될 수 있음)

- Azure 온디맨드: $3.20/시간

시간당 요금만 보면 Modal과 AWS 온디맨드가 동일합니다. 하지만 초당 과금은 추론 워크로드의 비용 계산을 완전히 바꿉니다. 모델이 버스트 패턴으로 요청을 처리한다면 — 200ms 여기, 3초 저기 — 그 정확한 초만 지불하면 됩니다. Modal의 자체 비용 분석에 따르면, 100건 요청 × 2초 워크로드가 Modal에서 $0.06, AWS에서 $1.10입니다. 버스트 추론 패턴에서 94.5% 비용 절감입니다.

추론 도중 회수될 수 있는 AWS 스팟 인스턴스와 비교해도 Modal의 서버리스 모델은 예약 인스턴스의 비용 부담 없이 안정성을 보장합니다. Modal의 분석이 지적하듯: “GPU가 3년간 지속적으로 돌아가지 않는 한, 서버리스가 예약 가격을 이깁니다.”

실제로 배포되는 개발자 경험

Modal Labs GPU 클라우드는 특정 페인 포인트를 겨냥합니다: 로컬에서 ML 코드를 작성하는 것과 프로덕션에서 실행하는 것 사이의 간극. Python SDK로 GPU 요구사항, 컨테이너 이미지, 환경변수, 크론 스케줄 등 모든 것을 순수 Python으로 정의할 수 있습니다. YAML도, Dockerfile도 (원하지 않는 한), 별도의 인프라 코드 저장소도 필요 없습니다.

import modal

app = modal.App("inference-service")

@app.function(gpu="A10G", image=modal.Image.debian_slim().pip_install("torch", "transformers"))

def predict(text: str) -> str:

from transformers import pipeline

classifier = pipeline("sentiment-analysis")

return classifier(text)[0]이것이 완전한, 배포 가능한 GPU 추론 서비스입니다. modal deploy를 실행하면 오토스케일링, HTTPS 엔드포인트, scale-to-zero가 내장된 상태로 라이브됩니다. 로컬 개발에서 프로덕션 배포까지의 피드백 루프가 수 시간에서 수 초로 줄어듭니다.

배치 처리, 모델 학습, 스케줄된 추론 작업을 실행하는 팀에게 Modal은 크론 스케줄 함수, 수천 개 컨테이너에 걸친 병렬 맵 연산, 모델 가중치와 데이터셋을 위한 공유 볼륨을 지원합니다. Kubernetes 배포 매니페스트를 왜 직접 작성했는지 의문이 들게 만드는 플랫폼입니다.

Modal vs RunPod vs Beam: 각자의 승리 영역

Modal이 시장의 유일한 서버리스 GPU 플랫폼은 아닙니다. 가장 강력한 두 대안과 비교한 결과입니다:

Modal Labs GPU 클라우드가 이기는 곳: Python 네이티브 개발 경험, 1초 미만 콜드 스타트, 코드로서의 인프라 접근법, 복잡한 오케스트레이션(멀티 스텝 파이프라인, fan-out/fan-in 패턴). DevOps를 최소화하면서 최대한의 제어를 원하는 팀에 최적.

RunPod가 이기는 곳: 최저 GPU 시간당 가격(H100 $2.69/시간 vs Modal $3.95/시간), 인기 모델용 Quick Deploy 템플릿, 영구 볼륨, 안정적 워크로드. 요청의 48%가 200ms 미만의 콜드 스타트를 보이지만 테일 레이턴시는 높습니다. 단순하고 비용 최적화된 추론 엔드포인트가 필요한 팀에 적합.

Beam이 이기는 곳: 단순함과 빠른 프로토타이핑. 첫 추론 엔드포인트를 배포하는 솔로 개발자에게 적합. Modal의 오케스트레이션 기능 대비 규모에서는 제한적.

경쟁 구도가 시사하는 바가 있습니다. Modal은 대규모 펀딩 라운드를 마감했고, RunPod는 확장을 위해 2,000만 달러를 유치했으며, Lambda Labs는 서버리스에서 완전히 철수하여 전통적 VM 인스턴스에 집중합니다. 시장이 자본으로 투표하고 있습니다: 서버리스 GPU가 미래이며, 질문은 Modal의 코드 퍼스트 접근법을 원하는지 RunPod의 배포 퍼스트 단순함을 원하는지입니다.

Modal Labs GPU 클라우드를 써야 할 팀 (그리고 쓰지 말아야 할 팀)

Modal을 써야 할 때: Python 중심 팀이 가변 트래픽의 추론 워크로드를 실행하는 경우. GPU 유휴 비용을 제거하고 싶은 경우. 개발자 경험을 중시하고 Kubernetes를 관리하고 싶지 않은 경우. 복잡한 오케스트레이션 — 멀티 스텝 ML 파이프라인, 배치 작업, 스케줄된 학습 — 이 필요한 경우.

Modal을 건너뛸 때: 절대적으로 가장 낮은 시간당 GPU 요금이 필요한 경우(RunPod가 지속 워크로드에서 더 저렴). 24/7 학습 작업을 실행하여 예약 인스턴스가 경제적으로 더 합리적인 경우. 다국어 지원이 필요한 경우 — Modal은 Python 우선이며 TypeScript/Go SDK는 아직 알파 단계.

결론입니다. 추론에 월 수백 달러 이상을 클라우드 GPU에 지출하는 팀이라면 초당 과금 모델만으로도 비용을 절반으로 줄일 수 있습니다. 그리고 1초 미만의 콜드 스타트 덕분에 서버리스 GPU 플랫폼에 흔히 따르는 성능 트레이드오프가 여기서는 거의 존재하지 않습니다. Modal Labs GPU 클라우드는 단순히 더 싼 옵션이 아닙니다 — AI 인프라가 어떻게 작동해야 하는지에 대한 근본적으로 다른 모델입니다.

AI 인프라 구축이나 클라우드 GPU 비용 최적화가 필요하시다면, 28년 이상의 기술 및 오디오 엔지니어링 경력을 가진 Sean Kim이 도와드립니다.

매주 AI, 음악, 테크 트렌드를 이메일로 받아보세요.