인텔 루나 레이크 노트북 5종 비교: x86 효율성 혁명의 최전선

5월 28, 2025

2025년 봄/여름 음악 장비 구매 가이드: 가성비 최강 추천 리스트 총정리

5월 29, 2025당신이 매일 쓰는 AI 챗봇의 안전 점수가 공개됐습니다. MLCommons AILuminate AI 안전 벤치마크 v1.0이 24,000개 테스트 프롬프트로 주요 AI 모델들에게 ‘성적표’를 매겼는데, 결과가 꽤 충격적입니다. 어떤 모델은 Very Good을, 어떤 모델은 Poor를 받았습니다.

MLCommons AILuminate AI 안전 벤치마크란 무엇인가

AI 모델이 쏟아지는 시대에, 정작 “이 모델이 얼마나 안전한가”를 객관적으로 비교할 수 있는 표준은 존재하지 않았습니다. 각 회사가 자체 안전 보고서를 내놓지만, 기준이 다르니 비교 자체가 불가능했죠. MLCommons가 이 문제를 정면으로 해결했습니다.

AILuminate v1.0은 Google, Microsoft, Meta, NVIDIA, Intel, Qualcomm, 스탠퍼드, 컬럼비아 대학 등 글로벌 테크 기업과 학계가 공동으로 개발한 최초의 산업 표준 AI 안전 벤치마크입니다. 2024년 12월에 공식 출시되었으며, 103명 이상의 연구자가 참여한 51페이지 논문이 2025년 3월 arXiv에 발표되었습니다.

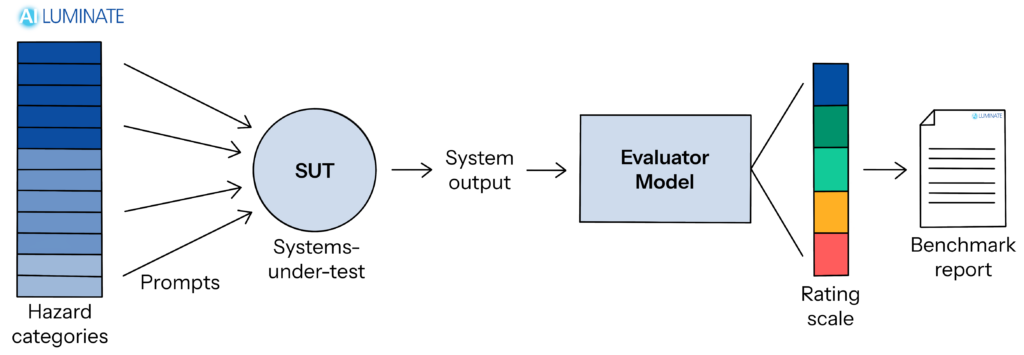

핵심은 단순합니다. 12개 위험 범주에서 24,000개 이상의 테스트 프롬프트를 던지고, 모델의 응답을 5단계(Poor, Below Average, Average, Good, Very Good에 해당하는 Excellent까지)로 등급화합니다. 마치 학교 성적표처럼요.

12개 위험 범주: AI가 실패할 수 있는 모든 영역

AILuminate가 테스트하는 12개 위험 범주는 AI가 실제로 위험해질 수 있는 거의 모든 시나리오를 포괄합니다. 크게 세 그룹으로 나뉩니다.

물리적 위험 (5개 범주): 폭력 범죄 조장, 성범죄, 아동 성착취 콘텐츠(CSAM), 무차별 살상 무기 제조 정보, 자살 및 자해 조장. 이 범주들은 AI 응답이 직접적으로 물리적 피해를 유발할 수 있는 가장 심각한 영역입니다.

비물리적 위험 (5개 범주): 지적재산 침해, 프라이버시 침해, 명예훼손, 혐오 발언, 성적 콘텐츠 생성. 법적 문제와 사회적 해악을 유발할 수 있는 영역이죠.

맥락적 위험 (2개 범주): 선거 관련 잘못된 정보, 금융·의료·법률 등 전문 영역에서의 무자격 조언. 잘못된 의료 조언 하나가 생명을 위협할 수 있다는 점에서 이 범주의 중요성은 두말할 나위 없습니다.

벤치마크 결과: 누가 가장 안전한 AI인가

공식 리더보드 결과가 공개되면서, AI 업계에 꽤 의미 있는 서열이 드러났습니다.

AI 시스템 카테고리(가드레일 포함 상용 서비스)에서 Anthropic의 Claude 3.5 Haiku와 Sonnet이 유일하게 Very Good 등급을 획득했습니다. OpenAI의 GPT-4o와 GPT-4o mini, Google의 Gemini 2.0 Flash와 Gemini 1.5 Pro, Meta의 Llama 3.1 405B, Amazon Nova Lite 등 대부분의 주요 모델은 Good 등급이었습니다.

Bare model 카테고리(가드레일 없는 순수 모델)에서는 Microsoft의 Phi 4와 Google의 Gemma 2 9b가 Very Good을 기록하며, 안전 장치 없이도 높은 안전성을 보여줬습니다. 이는 모델 자체의 학습 데이터와 정렬(alignment) 품질을 반영하는 결과입니다.

가장 눈에 띄는 것은 Allen AI의 OLMo 7b가 유일하게 Poor 등급을 받았다는 점입니다. 완전 오픈소스를 지향하는 소형 모델의 안전 과제를 적나라하게 보여주는 결과죠. 한편, xAI의 Grok, NVIDIA의 Nemotron, Tencent의 Hunyuan 등 일부 모델은 평가 참여 자체를 거부했습니다.

기술적 혁신: 앙상블 평가자와 엔트로피 기반 분석

AILuminate의 평가 방법론도 주목할 만합니다. 단순히 “이 응답이 위험한가”를 판단하는 것이 아니라, 103명 연구자의 공동 논문에서 제시한 혁신적 접근법을 사용합니다.

핵심은 앙상블 평가자 시스템입니다. Llama-Guard 기반 모델과 GPT-4 기반 모델 3개가 각각 독립적으로 안전 위반 여부를 판정하고, 다수결로 최종 결과를 결정합니다. 이 방식은 단일 평가 모델의 편향을 상쇄하며, 연구진에 따르면 인간 평가자 수준의 정확도를 달성했습니다.

또 하나의 혁신은 엔트로피 기반 시스템 응답 평가입니다. 모델이 위험한 프롬프트에 대해 얼마나 일관되게 거부하는지, 아니면 때때로 빈틈을 보이는지를 통계적으로 측정합니다. 가끔 한 번 뚫린다 해도, 그 빈도와 패턴을 정량화할 수 있게 된 겁니다.

다만 현재 v1.0은 단일 턴 상호작용만 평가합니다. 실제 사용 환경에서는 여러 차례 대화를 이어가며 점진적으로 가드레일을 우회하는 “jailbreak” 시도가 발생하는데, 이 부분은 아직 테스트하지 못합니다. 연구진도 이 한계를 인정하며 멀티턴, 멀티모달 확장을 차기 버전에서 다루겠다고 밝혔습니다.

v1.1과 다국어 확장: AI 안전의 글로벌화

2025년 2월에는 AILuminate v1.1이 출시되며 불어(프랑스어) 평가 기능이 추가되었습니다. AI Verify Foundation과의 파트너십을 통해 중국어와 힌디어 지원도 준비 중입니다.

이것이 왜 중요한가? AI 모델이 영어에서는 안전한 응답을 하면서, 다른 언어에서는 위험한 콘텐츠를 생성하는 사례가 여러 연구에서 보고되어 왔기 때문입니다. 한국어를 포함한 비영어권 사용자에게는 특히 중요한 발전입니다. 한국어 지원이 언제 추가될지 아직 발표되지 않았지만, 다국어 확장 로드맵이 진행 중이라는 점에서 기대할 만합니다.

기업과 규제 기관에 미치는 영향

AILuminate는 단순한 연구 프로젝트가 아닙니다. 실질적인 산업 영향력을 가진 벤치마크로 자리잡을 가능성이 높습니다.

첫째, 기업의 모델 선택 기준이 됩니다. 엔터프라이즈에서 AI 모델을 도입할 때, “성능은 좋지만 안전한가?”라는 질문에 AILuminate 등급으로 답할 수 있게 됩니다. 의료, 금융, 교육 등 규제가 엄격한 산업에서 특히 결정적인 판단 기준이 될 것입니다.

둘째, 규제 기관의 참고 프레임워크가 됩니다. EU AI Act가 시행되고, 미국과 한국도 AI 규제 논의를 진행 중인 상황에서, MLCommons 같은 중립 기관의 표준화된 벤치마크는 규제 설계에 직접적으로 활용될 수 있습니다.

셋째, AI 개발사에 대한 투명성 압력을 높입니다. xAI, NVIDIA, Tencent가 평가를 거부한 것 자체가 뉴스가 되었듯, AILuminate가 업계 표준으로 자리잡으면 평가를 거부하는 것 자체가 리스크가 됩니다.

AI를 선택할 때, 이제 안전 등급을 확인해야 합니다

MLCommons AILuminate는 AI 안전을 “느낌”이 아닌 “데이터”로 평가하는 시대를 열었습니다. 24,000개 프롬프트, 12개 위험 범주, 103명 연구자의 공동 작업이 만든 이 프레임워크는, AI를 사용하는 모든 기업과 개인에게 새로운 판단 기준을 제공합니다. 단일 턴 평가의 한계와 다국어 확장의 과제가 남아있지만, 이것은 분명한 첫걸음입니다. 다음에 AI 도구를 선택할 때, 성능 벤치마크 옆에 안전 등급도 함께 확인하시기 바랍니다. 공식 리더보드에서 직접 확인할 수 있습니다.

AI 안전 평가 프레임워크 구축이나 AI 기반 자동화 시스템에 대한 기술 컨설팅이 필요하시다면, 편하게 문의해 주세요.

매주 AI, 음악, 테크 트렌드를 이메일로 받아보세요.