Apple iPhone 17 Pro 리뷰: 카메라 바 디자인, A19 Pro 벤치마크, $1,099 업그레이드 가치 분석

9월 30, 2025Waves Nx 헤드 트래킹: 모든 헤드폰을 몰입형 믹스 룸으로 바꾸는 5가지 가상 스튜디오 비교

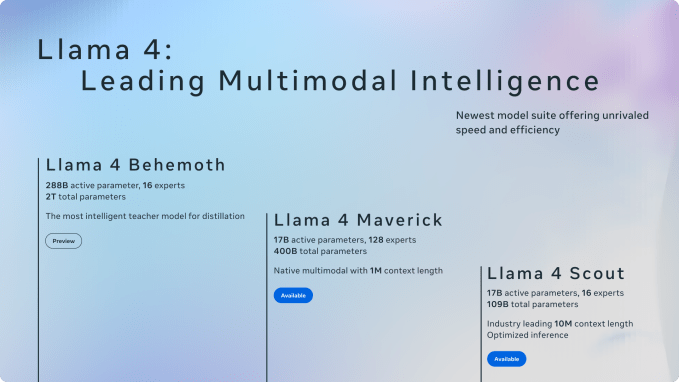

10월 3, 2025H100 GPU 한 장에 들어가는 멀티모달 AI 모델이라니 — Meta가 드디어 해냈습니다. Meta Connect 2025에서 공개된 Llama 4 Scout는 17B 활성 파라미터로 GPT-4급 성능을 내면서도 단일 GPU에서 구동되는, 온디바이스 AI의 새로운 기준입니다.

Meta Connect 2025: Llama 4 온디바이스 AI 전략의 핵심

2025년 9월 17~18일, 멘로파크 Meta 본사에서 열린 Meta Connect 2025는 단순한 제품 발표 행사가 아니었습니다. 마크 저커버그가 ‘개인 초지능(Personal Superintelligence)’이라 명명한 비전 — 이벤트를 기억하고, 핵심 순간을 요약하며, 실시간 코칭을 제공하는 AI 시스템 — 의 기술적 토대가 바로 Llama 4 온디바이스 AI 처리 기술이었습니다.

기존 클라우드 중심 AI와 결정적으로 다른 점은 데이터가 기기를 떠나지 않는다는 것입니다. 메시지, 캘린더 정보, 개인 컨텍스트 — 이 모든 것이 로컬에서 처리됩니다. 프라이버시 시대의 AI가 어떤 모습이어야 하는지, Meta가 명확한 답을 내놓은 셈입니다.

Llama 4 Scout: 109B 파라미터 모델이 H100 한 장에 들어가는 비밀

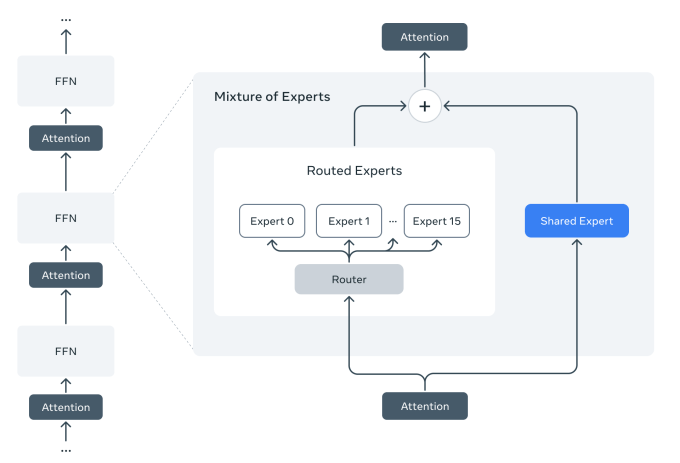

Llama 4 Scout의 핵심은 MoE(Mixture of Experts) 아키텍처입니다. 총 109B 파라미터 중 실제로 활성화되는 것은 17B에 불과합니다. 16개의 전문가(Expert) 모듈 중 토큰당 일부만 활성화되므로, 연산 효율이 획기적으로 높아집니다.

실제 수치를 보면 그 의미가 더 명확해집니다:

- 총 파라미터: 109B (16 전문가)

- 활성 파라미터: 17B (토큰당)

- 컨텍스트 윈도우: 최대 1,000만 토큰 (업계 최대)

- 배포: Int4 양자화로 NVIDIA H100 1장에 적재

- 아키텍처: iRoPE — 위치 임베딩 없는 인터리브 어텐션 레이어

특히 iRoPE 아키텍처는 주목할 만합니다. 위치 임베딩이 없는 어텐션 레이어를 인터리브 방식으로 배치하고, 추론 시점에 온도 스케일링을 적용해 길이 일반화(length generalization) 성능을 극대화합니다. 이 덕분에 256K 컨텍스트로 학습했음에도 1,000만 토큰까지 확장할 수 있는 것입니다.

Llama 3.2에서 Llama 4로: 엣지 AI 진화의 여정

Meta의 온디바이스 AI 전략은 Llama 4에서 갑자기 시작된 것이 아닙니다. 2024년 Meta Connect에서 공개된 Llama 3.2의 1B/3B 경량 모델이 그 시작이었습니다. 프루닝(Pruning)과 증류(Distillation) 기법으로 만들어진 이 모델들은 128K 컨텍스트를 지원하면서도 스마트폰에서 구동될 만큼 가벼웠습니다.

Qualcomm, MediaTek, Arm 프로세서에 최적화되어 출시 첫날부터 지원된 점도 중요합니다. 요약, 지시 수행, 텍스트 재작성 같은 작업에서 동급 최고 성능을 보여줬고, 이 기술 축적이 Llama 4 Scout의 더 야심찬 온디바이스 배포로 이어진 것입니다.

Llama 3.2 → Llama 4 Scout로의 진화를 비교하면:

- Llama 3.2 (1B/3B): 텍스트 전용, 스마트폰급, 128K 컨텍스트

- Llama 4 Scout (17B/109B MoE): 네이티브 멀티모달, GPU 서버급, 10M 컨텍스트

- 공통점: 프라이버시 중심 로컬 처리, 오픈 소스/오픈 웨이트

Ray-Ban Display + Neural Band: 온디바이스 AI의 물리적 형태

기술이 아무리 뛰어나도 하드웨어가 없으면 의미가 없습니다. Meta Connect 2025의 하드웨어 주인공은 Meta Ray-Ban Display($799)와 Meta Neural Band였습니다. Meta 최초의 디스플레이 탑재 스마트 안경이자, sEMG(표면 근전도) 기반 손목 밴드가 동봉된 최초의 제품입니다.

여기서 Llama 4 온디바이스 AI와의 연결고리가 명확해집니다. Neural Band의 원시 EMG 데이터는 전부 온디바이스에서 처리됩니다. 손목 밴드에서 안경으로는 ‘클릭’ 같은 이벤트 정보만 전송됩니다. 민감한 생체 데이터가 클라우드로 올라가지 않는 것입니다.

현재 한계도 분명합니다. 연속 AI 활동 시 배터리가 1~2시간밖에 버티지 못하고, ‘종일 지원’은 배터리와 열 성능 개선이 이루어져야 가능한 미래 목표입니다. 하지만 방향성은 확실합니다 — AI가 클라우드에서 내려와 손끝과 눈앞으로 오고 있습니다.

개발자를 위한 온디바이스 AI 생태계

Meta는 하드웨어와 모델만 공개한 것이 아닙니다. CTO 앤드류 보스워스가 공개한 Meta Wearables Device Access Toolkit은 개발자들이 모바일 앱을 확장하고 핸즈프리 경험을 구축할 수 있는 도구 모음입니다. Horizon Studio에서는 자연어 프롬프트로 지형, 건물, NPC까지 생성할 수 있는 AI 지원 창작 도구도 선보였습니다.

Llama 4 Scout와 Maverick 모델은 llama.com과 Hugging Face에서 다운로드 가능하며, 클라우드 플랫폼, 엣지 실리콘, 서비스 통합 업체로 확대 배포 중입니다. 오픈 웨이트 정책을 유지하면서 엣지 생태계를 키우겠다는 전략이 분명합니다.

온디바이스 AI 경쟁 지형: Apple, Google, Qualcomm과의 대결

Meta만 온디바이스 AI를 추진하는 것은 아닙니다. Apple은 Core ML 기반의 온디바이스 LLM을 iPhone에 통합 중이고, Google은 Gemini Nano를 Pixel 시리즈에 탑재했습니다. Qualcomm은 Snapdragon 8 Gen 3의 NPU에서 70억 파라미터 모델까지 구동할 수 있다고 발표했습니다.

하지만 Meta의 접근법은 결정적으로 다릅니다:

- 오픈 웨이트: Apple(폐쇄), Google(부분 공개)과 달리 완전 공개

- 웨어러블 우선: 스마트폰이 아닌 안경/밴드를 주 폼팩터로 설정

- MoE 효율: 109B 스케일의 지능을 17B 연산량으로 제공

- 1,000만 토큰 컨텍스트: 경쟁사 대비 압도적인 장기 기억 능력

프로듀서이자 엔지니어 관점에서 보면, 이 기술의 파급력은 AI 도구를 넘어섭니다. 실시간 번역, 맥락 인식 AI 어시스턴트, 프라이버시 보장 로컬 처리 — 이 세 가지가 결합되면 라이브 공연부터 스튜디오 세션까지 크리에이티브 워크플로우 전체가 달라질 수 있습니다.

결론: 온디바이스 AI의 진짜 게임은 이제부터

Meta Connect 2025가 보여준 것은 기술 데모가 아니라 명확한 로드맵입니다. Llama 4 Scout의 MoE 아키텍처로 대형 모델의 지능을 소형 하드웨어에 담고, Ray-Ban Display와 Neural Band로 웨어러블 폼팩터를 확보하고, 오픈 웨이트로 생태계를 확장하는 삼각 전략.

배터리 수명과 발열 문제는 여전히 숙제지만, 방향은 되돌릴 수 없습니다. AI가 클라우드 API에서 우리 주머니 속, 그리고 코앞으로 내려오는 시대 — Llama 4가 그 전환점을 찍었습니다.

AI 기반 음악 제작 파이프라인이나 기술 컨설팅에 관심이 있으시다면, Sean Kim과 상담해 보세요.

매주 AI, 음악, 테크 트렌드를 이메일로 받아보세요.