애플 맥미니 M5 루머 총정리: 컴팩트 데스크톱에 프로급 성능이 온다

9월 17, 2025

Waves V15 완전 정리: VST2 종료, 새 설치 프로그램, 그리고 당신이 알아야 할 모든 것

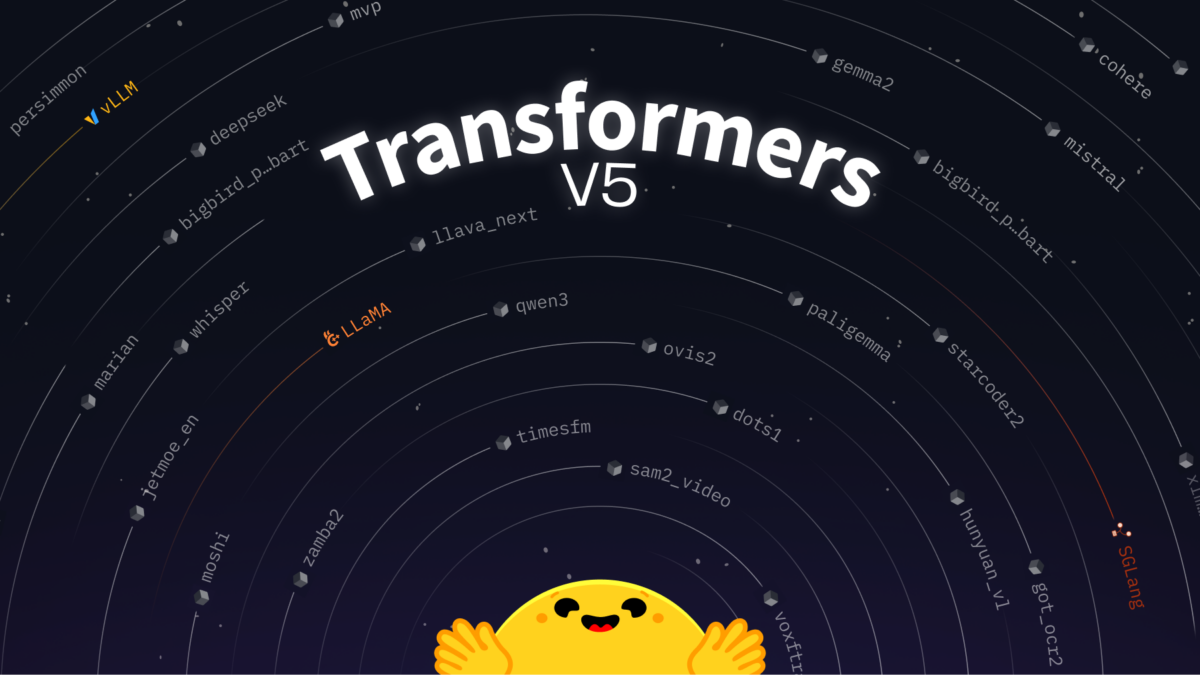

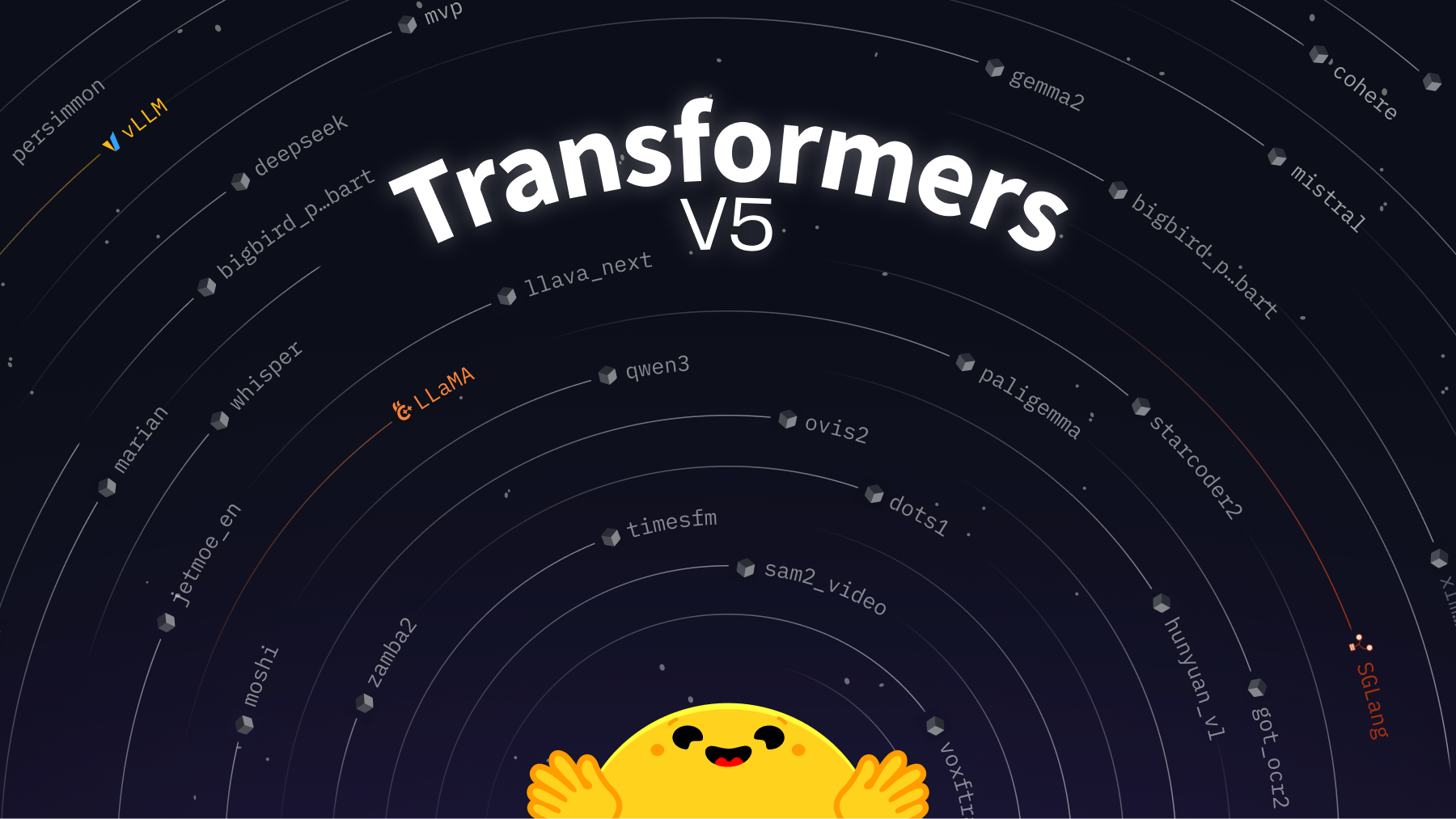

9월 18, 20259월 11일, GitHub에 올라온 단 하나의 이슈가 AI 오픈소스 생태계 전체를 뒤흔들었습니다. “Welcome v5” — Hugging Face Transformers v5의 공식 개발 시작을 알리는 이슈입니다. 매일 300만 회 이상 설치되고, 400개 이상의 모델 아키텍처를 품고 있는 라이브러리가 메이저 버전을 올린다는 것은, 단순한 업데이트가 아니라 ML 인프라의 패러다임 전환을 의미합니다.

이번 Hugging Face Transformers v5 발표에서 가장 눈에 띄는 변화는 명확합니다 — TensorFlow와 JAX 백엔드의 완전한 제거, 그리고 PyTorch 단일 프레임워크로의 전환입니다. 여기에 토크나이저 아키텍처의 전면 재설계, 새로운 AttentionInterface 추상화, WeightConverter API까지. 지금부터 이 모든 변화가 왜 필요했고, 여러분의 프로젝트에 어떤 영향을 미칠지 하나씩 분석하겠습니다.

Hugging Face Transformers v5의 핵심: PyTorch 전용 전환이 의미하는 것

v5의 가장 파격적인 결정은 TensorFlow와 JAX 백엔드를 완전히 제거하는 것입니다. Transformers 라이브러리가 처음 등장했을 때부터 멀티 프레임워크 지원은 핵심 철학이었습니다. TFAutoModel, FlaxAutoModel을 통해 동일한 체크포인트를 세 가지 프레임워크에서 사용할 수 있었습니다. 그런데 왜 이 방향을 포기하는 걸까요?

답은 숫자에 있습니다. Hugging Face Hub에 등록된 75만 개 이상의 체크포인트 중 압도적 다수가 PyTorch 기반입니다. 매주 3개씩 추가되는 새 아키텍처들도 대부분 PyTorch로 먼저 구현됩니다. TF/JAX 모델을 유지하려면 각 아키텍처마다 3벌의 코드를 관리해야 했고, 이는 새로운 모델 추가 속도를 심각하게 저해했습니다. vLLM, SGLang 같은 추론 엔진들이 Transformers를 백엔드로 채택하면서, PyTorch에 집중하는 것이 전체 생태계를 위한 최선이라는 판단이 내려진 것입니다.

실무적으로 이것이 의미하는 바는 분명합니다. from transformers import TFAutoModel이나 FlaxAutoModel을 사용하고 있다면, v5로 넘어가기 전에 PyTorch 기반으로 코드를 마이그레이션해야 합니다. TensorFlow 사용자들에게는 당장 큰 변화이지만, Hugging Face가 공식 블로그에서 밝힌 것처럼 Transformers가 ML 생태계의 “중심 피벗”이 되려면 불가피한 선택입니다. 참고로 v4 브랜치는 별도로 유지보수될 예정이므로, 즉시 전환이 어려운 프로젝트는 v4에 머무르는 것도 가능합니다.

토크나이저 대통합: Fast/Slow 이분법의 종말

Transformers를 써본 개발자라면 한 번쯤은 혼란스러웠을 겁니다 — BertTokenizer와 BertTokenizerFast의 차이, use_fast=True 파라미터, SentencePiece 기반 토크나이저와 Rust 기반 토크나이저의 동작 차이. v5는 이 혼란을 근본적으로 해결합니다.

새로운 토크나이저 시스템은 백엔드 기반 아키텍처로 완전히 재설계됩니다. TokenizersBackend(Rust 기반 tokenizers 라이브러리), SentencePieceBackend, PythonBackend(순수 Python), MistralCommonBackend(Mistral 전용) 등 명확한 백엔드 분류 체계가 도입됩니다. 더 이상 Fast/Slow라는 모호한 구분이 아니라, 실제 내부 구현이 무엇인지 투명하게 드러나는 구조입니다.

마이그레이션 가이드에 따르면 encode_plus 메서드는 deprecated 처리되고, apply_chat_template이 BatchEncoding을 반환하도록 변경됩니다. 또한 special_tokens_map.json이 tokenizer_config.json에 통합되면서 파일 구조도 단순화됩니다. 이 변경들은 breaking change이므로, 토크나이저를 직접 커스터마이징하거나 encode_plus를 사용하는 코드가 있다면 반드시 점검이 필요합니다.

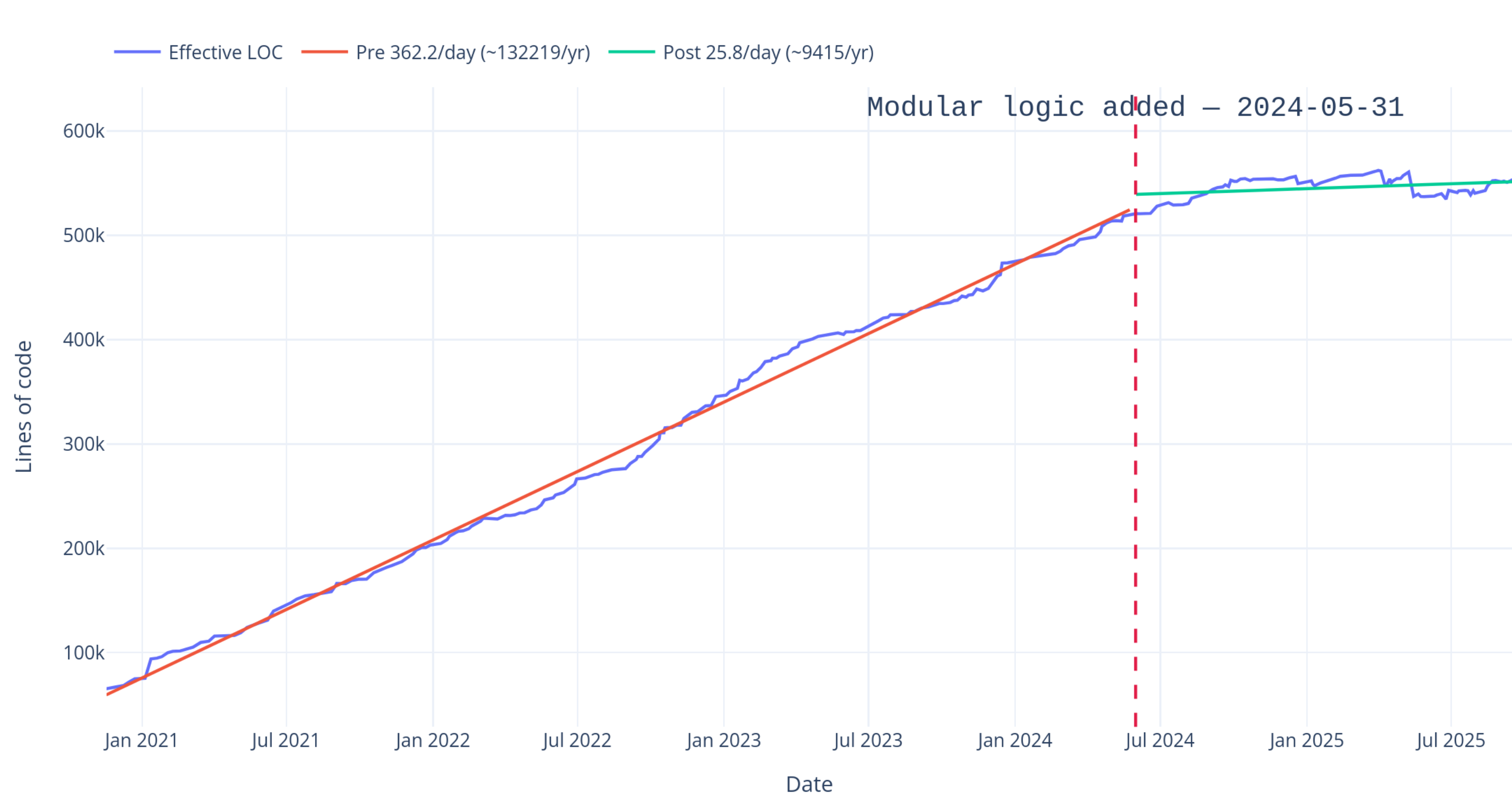

모듈러 모델 아키텍처와 AttentionInterface

v5의 또 다른 핵심 변화는 모델 정의 방식의 근본적인 재설계입니다. 현재 Transformers의 모델 코드를 보면, 각 아키텍처마다 attention 메커니즘이 개별적으로 구현되어 있습니다. SDPA(Scaled Dot-Product Attention), Flash Attention, 일반 attention이 모델마다 중복 코드로 존재합니다. 400개 이상의 아키텍처에서 이 패턴이 반복되니, 유지보수의 악몽이 되어온 것입니다.

v5에서 도입되는 AttentionInterface는 이 문제를 해결하는 추상화 계층입니다. 모든 모델이 동일한 attention 인터페이스를 구현하도록 하여, Flash Attention 2나 새로운 attention 알고리즘이 나왔을 때 한 곳만 수정하면 전체 모델에 적용되는 구조를 만듭니다. 이는 Hugging Face v5 공식 블로그에서 “simple model definitions powering the AI ecosystem”이라고 표현한 핵심 철학과 직결됩니다.

실무에서의 임팩트는 상당합니다. 커스텀 모델을 구현하는 연구자들은 더 적은 코드로 더 다양한 attention 전략을 활용할 수 있게 됩니다. 추론 최적화를 하는 엔지니어들은 모델별로 따로 최적화할 필요 없이, 인터페이스 수준에서 일괄 적용이 가능해집니다. vLLM이나 SGLang처럼 Transformers를 백엔드로 쓰는 추론 프레임워크에게도 일관된 인터페이스를 제공하게 됩니다.

WeightConverter API와 SafeTensors 필수화

v5에서는 체크포인트 관리 방식도 대폭 변경됩니다. WeightConverter API가 새롭게 도입되어, 서로 다른 형식의 체크포인트를 변환하는 작업이 표준화됩니다. 예를 들어 원본 연구 코드의 체크포인트를 Transformers 형식으로 변환하거나, GGUF 형식으로 내보내는 작업이 통일된 인터페이스를 통해 수행됩니다.

SafeTensors가 기본이자 필수 형식이 되는 것도 중요한 변화입니다. 기존의 pickle 기반 .bin 파일은 임의 코드 실행의 보안 위험이 있었는데, SafeTensors는 이를 원천적으로 차단합니다. v5부터는 SafeTensors가 아닌 체크포인트를 로드하려면 명시적으로 옵트인해야 하므로, 보안 측면에서 큰 진전입니다. 양자화(Quantization)도 first-class 기능으로 승격되어, 모델 압축과 효율적 추론이 라이브러리의 핵심 기능으로 자리 잡게 됩니다.

개발자를 위한 마이그레이션 체크리스트

v5가 정식 릴리스되면 breaking change가 상당할 것으로 예상됩니다. 공식 마이그레이션 가이드를 참고하되, 지금부터 점검할 핵심 사항을 정리합니다.

- TF/JAX 코드 의존성 확인:

TFAutoModel,FlaxAutoModel사용 코드를 PyTorch 기반으로 전환 계획 수립 - 토크나이저 API 점검:

encode_plus사용 여부 확인,apply_chat_template반환값 변경에 대비 - SafeTensors 전환: pickle 기반 체크포인트를 SafeTensors로 사전 변환

- Attention 관련 커스텀 코드: 직접 attention을 구현한 경우

AttentionInterface호환성 확인 - CI/CD 파이프라인:

transformers>=5.0호환성 테스트 브랜치 미리 준비 - v4 고정 필요시:

pip install transformers<5.0으로 버전 고정, v4 브랜치 유지보수 일정 확인

특히 프로덕션 환경에서 Transformers를 사용하고 있다면, v5 RC(Release Candidate)가 나오는 시점에 스테이징 환경에서 충분히 테스트하는 것을 강력히 권장합니다. main 브랜치가 이미 v5 개발 브랜치로 전환되었으므로, pip install transformers의 nightly 빌드를 사용하는 경우 즉시 영향을 받을 수 있습니다.

이번 Transformers v5 발표는 단순한 라이브러리 업데이트를 넘어, AI 오픈소스 생태계가 "확장의 시대"에서 "표준화와 최적화의 시대"로 전환하고 있다는 신호입니다. TF/JAX 제거는 아쉽지만, PyTorch에 집중함으로써 얻는 개발 속도와 코드 품질의 향상은 전체 커뮤니티에 돌아갈 것입니다. v5 RC가 나오기 전까지 마이그레이션을 준비하는 것, 그것이 지금 개발자가 할 수 있는 가장 현명한 대응입니다.

ML 파이프라인 자동화나 AI 인프라 구축에 대해 기술 컨설팅이 필요하시다면, Sean Kim이 도와드리겠습니다.

매주 AI, 음악, 테크 트렌드를 이메일로 받아보세요.