2026년을 시작하는 최고의 AI 도구 총정리: 생산성, 코딩, 크리에이티브 추천 10선

1월 22, 2026

2026 음악 산업 전망: AI, 스트리밍, 라이브 이벤트가 만드는 역대급 변곡점

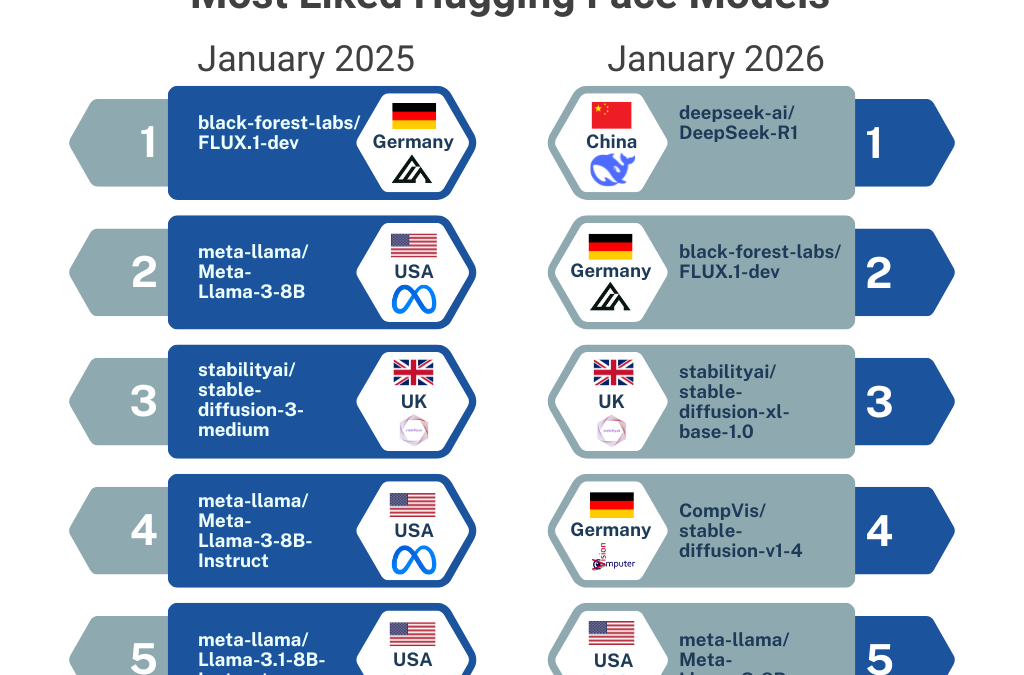

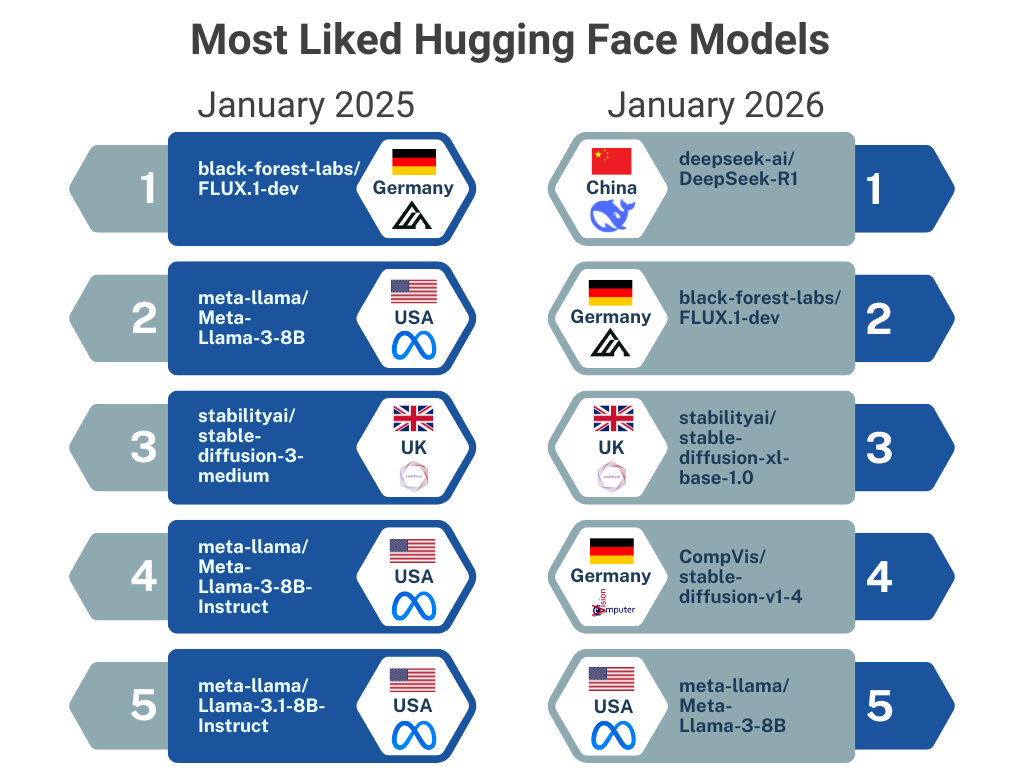

1월 23, 20261년 전 딥시크 R1이 등장했을 때, 오픈소스 AI의 판도가 바뀔 것이라 예상한 사람은 많았습니다. 하지만 허깅페이스 오픈 모델 랭킹 2026의 실제 데이터는 그 누구의 예상도 뛰어넘었습니다. 중국 AI 모델의 글로벌 점유율이 1%에서 15%로 15배 급등했고, 리더보드 상위 4개 모델은 모두 가중치 하나 바꾸지 않은 기법의 후손들입니다. 지금부터 그 1년간 무슨 일이 벌어졌는지 살펴보겠습니다.

허깅페이스 오픈 모델 랭킹 2026, 딥시크 1주년이 공개한 충격적 수치

2026년 1월 20일, 허깅페이스는 “딥시크 모먼트 1주년”이라는 제목의 회고 블로그를 발행했습니다. 딥시크 R1은 허깅페이스 역사상 가장 많은 좋아요를 받은 모델이 되었습니다. 하지만 진짜 이야기는 단일 모델이 아니라, 그 모델이 촉발한 생태계 전체의 변화에 있습니다.

2025년 1월 딥시크가 R1 추론 모델을 오픈소스로 공개했을 때, DeepSeek-V3 기반 모델의 학습 비용이 약 550만 달러에 불과하다는 사실이 업계에 충격을 주었습니다. 그 신호는 베이징, 선전, 항저우에서 분명하게 수신되었고, 12개월 만에 허깅페이스 오픈 모델 랭킹 2026은 과거 미국 중심의 리더보드와는 완전히 다른 모습으로 변모했습니다.

Qwen의 압도적 성장: 7억 다운로드, 11만 3천 개 파생 모델

딥시크가 도화선이었다면, 알리바바의 Qwen 패밀리는 로켓 본체였습니다. 2026년 1월 기준 Qwen은 허깅페이스에서 7억 회 이상의 다운로드를 기록하며 플랫폼 최다 다운로드 오픈 모델 패밀리가 되었습니다. 더 놀라운 것은 113,000개 이상의 파생 모델이 Qwen 체크포인트 위에 구축되었다는 점입니다.

이 수치가 의미하는 바는 단순한 인기를 넘어섭니다. Qwen은 오픈소스 LLM 세계에서 리눅스와 같은 위치를 차지하게 되었습니다. 전 세계 파인튜너, 연구자, 스타트업, 기업들이 Qwen을 기반 레이어로 선택하고 있으며, 11만 개가 넘는 파생 모델은 Qwen이 단순히 다운로드되는 것이 아니라 적극적으로 확장·적용·배포되고 있음을 보여줍니다.

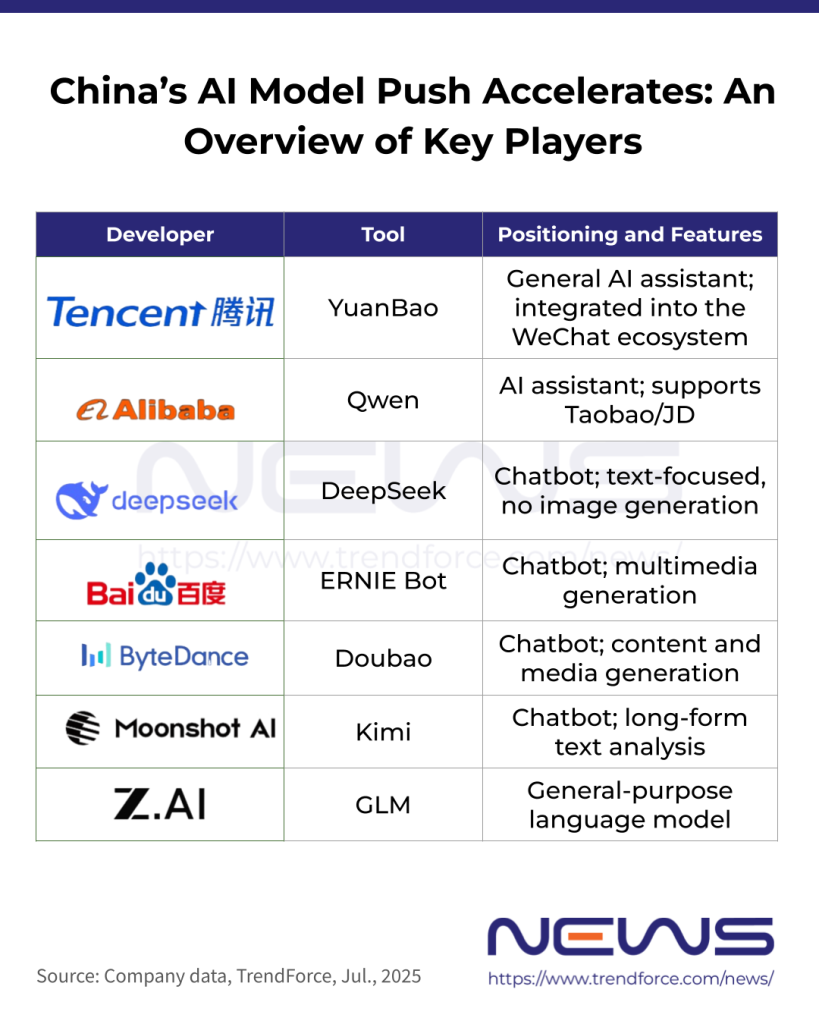

중국 AI의 폭발적 성장: 글로벌 점유율 1%에서 15%로

트렌드포스의 2026년 1월 보고서에 따르면, 중국 AI 모델은 2025년 11월 기준 글로벌 점유율 약 15%를 달성했습니다. 2024년 말 약 1%였던 것에서 15배 증가한 수치입니다. AI 역사상 가장 빠른 시장 점유율 변화 중 하나입니다.

허깅페이스 데이터가 보여주는 개별 기업의 성장 궤적도 놀랍습니다:

- 바이두: 허깅페이스 모델 릴리스 0개에서 100개 이상으로

- 바이트댄스·텐센트: 허깅페이스 활동량 8~9배 성장

- 딥시크: 오픈소스 철학으로 지속적인 혁신 주도

- 알리바바 Qwen: 전 세계 최다 다운로드 모델 패밀리 등극

이 성장의 동력은 오픈소스 AI를 장려하는 정부 정책, 치열한 국내 경쟁, 그리고 오픈 모델이 강력한 개발자 유입 채널이라는 인식의 결합입니다. 모든 사람이 파인튜닝하는 모델이 곧 생태계의 지배자가 됩니다.

RYS-XLarge: 가중치 하나 안 바꾸고 리더보드 1위를 차지한 비밀

허깅페이스 오픈 모델 랭킹 2026에서 가장 흥미로운 이야기는 바로 RYS-XLarge입니다. 2026년 1월 현재 오픈 LLM 리더보드 상위 4개 모델은 모두 RYS-XLarge의 후손인데, 이 기법은 놀라울 정도로 단순합니다.

Qwen2-72B의 중간 레이어 7개(45~51번)를 복제해서 파라미터 수를 72B에서 78B로 늘린 것이 전부입니다. 재학습 없음. 가중치 수정 없음. 새로운 데이터 없음. 단순 레이어 복제만으로 44.75점을 달성했고, 이를 기반으로 추가 파인튜닝을 적용하자 결과는 더욱 놀라웠습니다:

- calme-3.2-instruct-78b: 52.08점 (1위)

- calme-3.1-instruct-78b: 51.29점 (2위)

- CalmeRys-78B-Orpo: 51.23점 (3위)

특히 MuSR 벤치마크에서 레이어 복제만으로 17.72%의 성능 향상을 보였습니다. 이는 현재 벤치마크가 실제로 무엇을 측정하고 있는지에 대한 근본적인 의문을 제기합니다. 학습 없이 레이어만 복제해서 점수가 급등한다면, 우리가 테스트하는 것은 지능일까요, 아니면 평가 시스템을 우회하는 능력일까요?

Open-R1: 허깅페이스의 딥시크 파이프라인 재현 프로젝트

딥시크의 영향력을 인식한 허깅페이스는 Open-R1 프로젝트를 출범했습니다. 딥시크-R1의 전체 학습 파이프라인을 오픈소스로 재현하려는 야심찬 시도입니다. Elie Bakouch, Leandro von Werra, Lewis Tunstall이 이끄는 이 프로젝트는 3단계 로드맵을 따릅니다:

- 1단계: 딥시크-R1 출력에서 추론 데이터셋 증류

- 2단계: 강화학습 파이프라인(GRPO) 재현

- 3단계: 전체 다단계 학습 절차 구현

Open-R1이 중요한 이유는 딥시크가 가중치는 공개했지만 전체 학습 레시피는 공개하지 않았기 때문입니다. 파이프라인 전체를 재현 가능하게 만듦으로써 모델뿐 아니라 방법론까지 민주화하겠다는 것이 허깅페이스의 목표입니다.

LLM을 넘어서: NVIDIA Cosmos와 Red Hat AI의 등장

2026년 1월의 변화는 언어 모델에만 국한되지 않습니다. NVIDIA는 Cosmos Predict 2.5(월드 파운데이션 모델), Reason 2(추론), Isaac GR00T N1.6(휴머노이드 로봇) 등 다수의 모델을 허깅페이스에 공개했습니다. Red Hat은 AI 3.3 검증 모델 배치를 출시하며 엔터프라이즈 오픈 모델 도입이 실험에서 프로덕션으로 전환되고 있음을 보여주었습니다.

Red Hat의 보고서에 따르면 2025년에는 IBM Granite 4가 ISO 42001 인증을 받았고, OpenAI도 gpt-oss(120B/20B)를 깜짝 공개했습니다. 허깅페이스 오픈 모델 랭킹 2026은 오픈소스가 단순한 대안이 아니라 기본 개발 패러다임이 된 세계를 반영하고 있습니다.

더 큰 그림: 모델 전쟁에서 시스템 전쟁으로

허깅페이스 회고 시리즈의 가장 핵심적인 통찰은 경쟁의 본질이 근본적으로 변했다는 점입니다. RYS-XLarge 사례가 보여주듯 벤치마크는 취약합니다. 진정한 경쟁은 이제 시스템 수준의 역량 — 생태계, 응용 프레임워크, 인프라, 배포 파이프라인 — 으로 이동했습니다.

Qwen의 11만 3천 개 파생 모델이 어떤 단일 벤치마크 점수보다 중요합니다. 딥시크의 문화적 영향이 파라미터 수보다 중요합니다. 중국 랩들의 집단적 15% 시장 점유율이 개별 모델 출시보다 중요합니다. 최고의 모델이 아니라 최고의 플랫폼이 승자가 되는 시대에 진입했습니다.

1년 전 딥시크가 보여준 것은 오픈소스가 폐쇄형 모델과 동등한 성능을 훨씬 적은 비용으로 달성할 수 있다는 사실이었습니다. 지금, 그 순간이 촉발한 생태계는 AI 개발의 규칙 자체를 다시 쓰고 있습니다. 이제 질문은 오픈 모델이 경쟁할 수 있느냐가 아니라, 폐쇄형 모델이 이 물결에서 살아남을 수 있느냐입니다.

오픈소스 AI 모델 선정, 배포 파이프라인 구축, 또는 자동화 시스템 설계에 대해 도움이 필요하시다면 편하게 문의해 주세요.

매주 AI, 음악, 테크 트렌드를 이메일로 받아보세요.