Pixel 10 Tensor G5: 구글의 TSMC 전환이 모든 것을 바꿀 수 있는 이유 — Google I/O 2025 프리뷰

5월 1, 2025

서피스 프로 11 스냅드래곤 X 엘리트: 2025 스프링 업데이트로 완성된 ARM PC의 미래

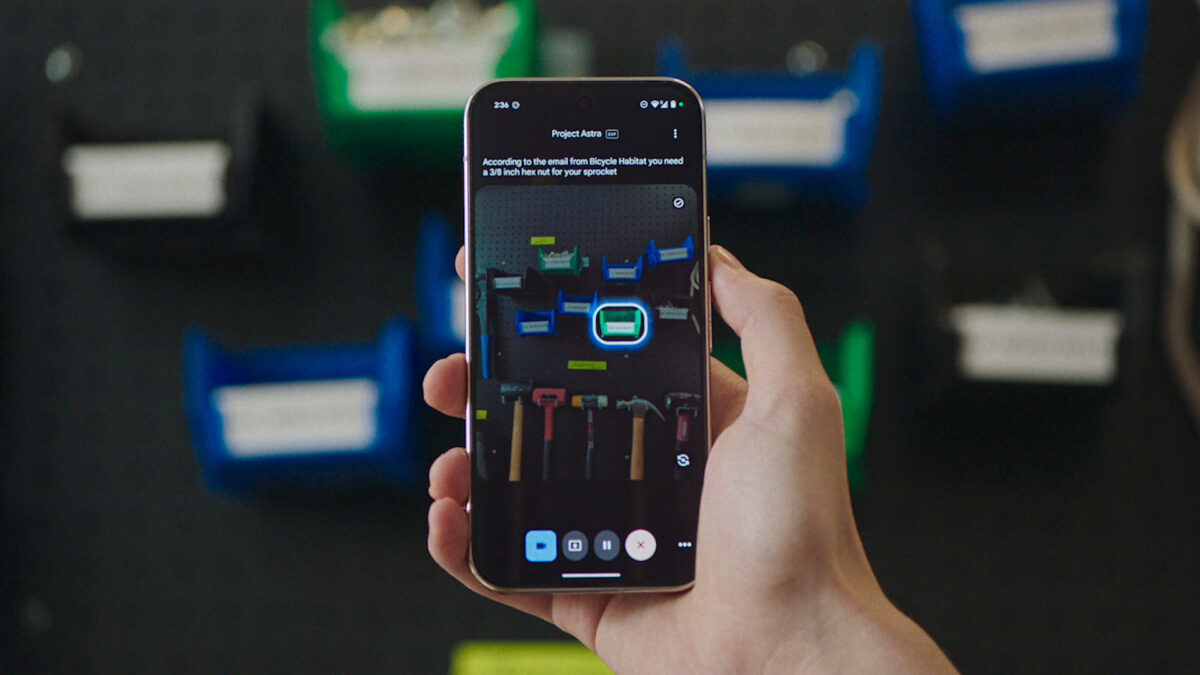

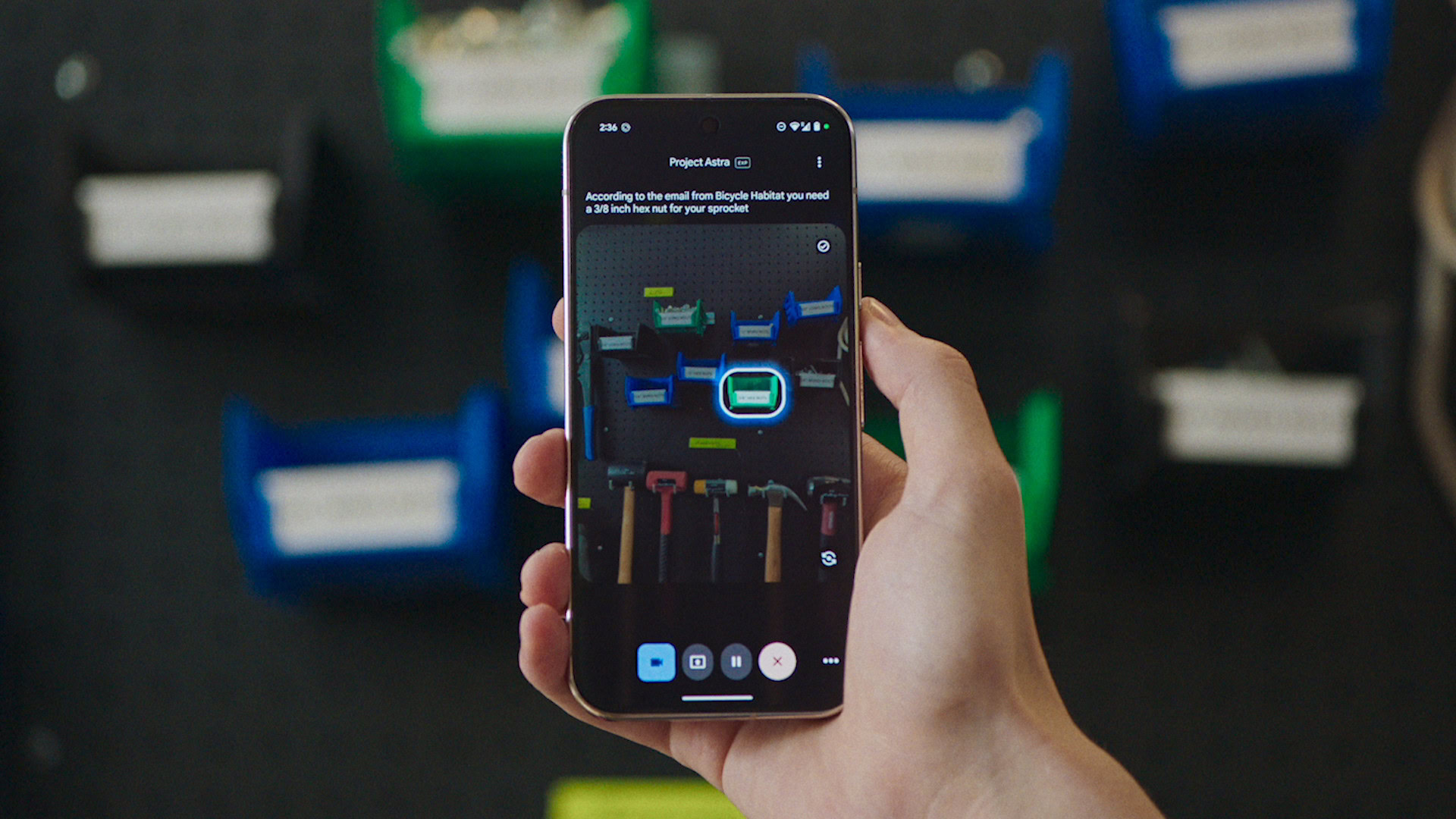

5월 2, 2025구글이 진짜 AI 어시스턴트가 무엇인지 보여줬습니다 — 텍스트 상자 안에 앉아 있는 챗봇이 아닙니다. Google I/O 2025에서 구글 프로젝트 아스트라는 스마트폰 카메라로 실시간 비디오를 스트리밍하면서 어수선한 차고에서 특정 자전거 부품을 식별하고, 수리 매뉴얼을 찾아 열고, 수리 과정을 안내하고, 근처 자전거 가게에 전화까지 걸었습니다 — 도중에 다른 사람이 말을 걸어도 대화를 놓치지 않으면서요.

이건 컨셉 영상이 아닙니다. 구글이 I/O 키노트에서 라이브로 시연한 실제 기능이며, 일부는 이미 Android와 iOS의 Gemini Live 사용자에게 제공되고 있습니다. 구글 프로젝트 아스트라는 Demis Hassabis가 “범용 AI 어시스턴트”라고 부르는 것 — 스마트폰을 통해 현실 세계를 보고, 듣고, 행동하는 AI를 향한 구글의 가장 공격적인 행보입니다.

구글 프로젝트 아스트라란? 기술적 기반

프로젝트 아스트라의 핵심은 Google DeepMind의 연구 프로토타입으로, 물리적 세계를 실시간으로 이해하고 상호작용하는 AI 어시스턴트를 구축하는 방법을 탐구합니다. “아스트라”라는 이름 자체가 구글의 야심을 보여줍니다 — 이건 기존 Google Assistant의 점진적 업데이트가 아니라, 인간-AI 상호작용에 대한 근본적으로 다른 접근입니다.

기술적 기반은 Gemini 2.5 Pro입니다. Google DeepMind의 가장 진보된 멀티모달 트랜스포머로, 기존 대형 언어 모델이 텍스트를 순차적으로 처리하는 것과 달리, Gemini 2.5 Pro는 동기화된 비디오, 오디오, 텍스트 데이터로 동시에 훈련되었습니다. 언어만 이해하는 것이 아니라 보고, 듣고, 읽는 것 사이의 공간적·시간적 관계를 이해합니다.

핵심 기술 돌파구는 아스트라의 연속 인코딩 파이프라인입니다. 비디오 프레임을 실시간으로 처리하고, 시각·청각 입력을 통합 이벤트 타임라인으로 결합하며, 이 정보를 캐싱하여 즉시 회상할 수 있게 합니다. 결과적으로 거의 제로에 가까운 지연 시간 — 카메라가 보는 것에 대해 질문하면 아스트라가 즉시 답합니다.

Google I/O 2025를 사로잡은 프로젝트 아스트라 6가지 기능

I/O 키노트 데모는 대본에 따른 마케팅 영상이 아니었습니다 — 점점 더 복잡해지는 실제 작업을 아스트라가 처리하는 연속적이고 끊김 없는 워크플로우였습니다. BGR의 분석에 따르면, 다음이 6가지 핵심 기능입니다:

1. 실시간 문서 검색 및 탐색

데모에서 사용자가 카메라로 자전거를 비추며 수리 매뉴얼을 찾아달라고 했습니다. 아스트라는 웹을 검색해 올바른 PDF 매뉴얼을 찾고, 열고, 브레이크 수리 섹션으로 정확히 스크롤했습니다 — 사용자의 손은 자전거에 그대로 둔 채 음성 명령만으로요. 이건 웹 검색이 아닙니다. 인간 리서치 어시스턴트처럼 문서를 탐색하는 AI 에이전트입니다.

2. YouTube 영상 검색 및 재생

텍스트 매뉴얼만으로 부족할 때, 사용자가 비디오 튜토리얼을 찾아달라고 했습니다. 아스트라는 YouTube 앱을 실행하고, 관련 수리 튜토리얼을 검색하고, 가장 적절한 결과를 선택해 재생했습니다 — 사용자가 화면을 한 번도 터치하지 않고요. AI가 특정 수리 작업에 가장 잘 맞는 영상을 판단해서 선택했습니다.

3. 멀티모달 크로스레퍼런스 검색

기술적으로 가장 인상적인 기능이었습니다. 아스트라는 자전거 부품을 보여주는 라이브 카메라 피드를 분석하면서, 동시에 Gmail에서 해당 부품의 구매 확인 이메일을 검색하고, 비디오 피드에서 올바른 부품을 하이라이트했습니다. 실시간 비전, 이메일 검색, 공간 이해를 단일 응답으로 통합한 것입니다.

4. 백그라운드 전화 통화 및 작업 위임

사용자가 가장 가까운 자전거 가게를 찾아 전화해달라고 했습니다. 아스트라는 가게를 찾고, 전화를 걸고, 부품 재고를 문의했습니다 — 사용자는 자전거 작업을 계속하면서 다른 주제로 아스트라와 대화하는 동안에요. 통화가 끝나자 아스트라가 결과를 보고했습니다. 이것이 진정한 멀티태스킹입니다: 전화 통화와 대면 대화를 동시에 처리하는 것.

5. 다중 화자 컨텍스트 인식

대화 중간에 다른 사람이 끼어들었습니다. 아스트라는 방해를 감지하고 자동으로 멈췄다가, 사용자가 돌아오자 정확히 끊긴 지점에서 재개했습니다 — “어디까지 했죠?”라고 묻지도, 컨텍스트를 잃지도 않았습니다. 이는 정교한 화자 분리와 대화 상태 관리 능력을 보여줍니다.

6. 컨텍스트 인식 쇼핑 통합

아스트라는 Google Photos에서 사용자의 반려동물을 인식하고 관련 상품을 제안했습니다. 이후 Google Shopping 통합을 통해 구매를 지원했습니다. 시사점은 명확합니다: 아스트라는 당신의 삶에 대한 지속적 이해 — 소유물, 선호도, 관계 — 를 구축하고 이를 능동적으로 활용합니다.

구글 프로젝트 아스트라 vs OpenAI GPT-4o: 멀티모달 AI 경쟁

당연한 비교 대상은 OpenAI의 GPT-4o입니다. GPT-4o도 텍스트, 오디오, 비디오 입력을 처리합니다. 하지만 접근 방식이 근본적으로 다릅니다. GPT-4o는 오디오 입력을 최소 232밀리초 만에 처리합니다 — 인간의 대화 응답 시간과 맞먹는 수준입니다. 구글은 프로젝트 아스트라의 구체적 지연 시간을 공개하지 않았지만, I/O 데모에서는 인지 가능한 지연이 사실상 없었습니다.

결정적 차이는 에이전트 능력에 있습니다. GPT-4o는 여러 모달리티에 걸친 콘텐츠 이해와 생성에 탁월하지만, 프로젝트 아스트라는 더 나아갑니다 — 디바이스를 직접 제어하고, 앱을 실행하고, 전화를 걸고, 문서를 탐색하고, 다단계 워크플로우를 실행합니다. 질문에 답하는 AI와 행동하는 AI의 차이입니다.

구글은 생태계 통합에서도 압도적 우위를 가집니다. 프로젝트 아스트라는 Search, Gmail, Google Photos, Google Maps, Calendar, Tasks, Keep, YouTube를 활용합니다 — 어떤 경쟁자도 따라올 수 없는 개인 컨텍스트의 깊이입니다. 아스트라가 라이브 카메라 피드를 보면서 Gmail 영수증에서 자전거 부품을 식별할 때, 그것이 바로 구글 생태계 우위의 실체입니다.

Search Live와 개발자 API: 데모 너머의 프로젝트 아스트라

소비자 측면에서 가장 중요한 통합은 Search Live입니다. Google AI Mode 검색이나 Google Lens를 사용할 때, “Live” 버튼을 탭하면 카메라가 보는 것에 대해 질문할 수 있습니다. 프로젝트 아스트라가 비디오와 오디오를 Gemini 2.5 Pro에 스트리밍하고 거의 제로 지연으로 답변합니다. 이것은 Google 검색을 텍스트 입력/출력 도구에서 앰비언트 멀티모달 정보 레이어로 변환합니다.

개발자들에게는 Live API의 새 기능이 공개되었습니다 — Gemini과의 저지연 음성 상호작용을 가능하게 하는 개발자용 엔드포인트입니다. I/O 당일부터 개발자들은 오디오 및 비주얼 입력과 네이티브 오디오 출력을 지원하는 경험을 구축할 수 있습니다. 키노트 데모를 구동한 동일한 기술을 구글이 민주화하고 있는 것입니다.

Gemini Live의 카메라 및 화면 공유 기능은 — 기존에 Gemini Advanced 구독자로 제한되었던 것이 — 이제 모든 Android 및 iOS 사용자에게 무료로 제공됩니다. Google Maps, Calendar, Tasks, Keep과의 통합도 수개월 내 예정입니다.

내 생각: 28년차 엔지니어의 관점

거의 30년 가까이 기술의 약속이 실현되지 않는 것을 지켜봤습니다 — Siri가 모든 것을 바꿀 거라고 했던 때를 기억하시나요? 하지만 프로젝트 아스트라는 다릅니다. 그 이유는 이렇습니다: 라이브 데모에서 연속적이고, 다단계의, 실제 작업 완수를 단 한 번의 실패나 어색한 멈춤 없이 보여줬기 때문입니다. 이건 마케팅이 아닙니다 — 실제로 작동하는 기술입니다.

매일 자동화된 파이프라인을 운영하고 여러 AI 에이전트를 관리하는 사람으로서, 그 시사점이 명확하게 보입니다. 프로젝트 아스트라가 인터럽션을 처리하고, 모달리티 간 컨텍스트를 유지하고, 작업을 위임하는 능력(전화 통화처럼)은 우리가 소프트웨어에서 구축하는 멀티 에이전트 아키텍처를 거울처럼 반영합니다 — 다만 일반 소비자용으로 패키징한 것입니다. 구글이 본질적으로 에이전틱 AI를 대중화하고 있습니다.

음악 프로덕션 관점은 명확하지 않지만 실재합니다. 하드웨어 신디사이저에 폰을 들이대고 아스트라가 매뉴얼을 찾고, 튜토리얼 영상을 검색하고, 제조사 고객센터에 전화까지 거는 것을 상상해 보세요 — 케이블을 연결하는 동안 핸즈프리로요. 물리적 컨텍스트를 이해하는 실시간 멀티모달 어시스턴트는 스튜디오 프로들에게 창작 흐름을 깨는 끊임없는 화면 전환을 없애줄 수 있습니다.

우려도 있습니다. 프라이버시입니다. 아스트라의 힘은 Google 데이터와의 깊은 통합에서 나옵니다 — 이메일, 사진, 위치, 검색 기록. 유용하게 만드는 그 깊은 컨텍스트가 동시에 역사상 가장 은밀한 AI 감시 도구가 됩니다. 구글이 프라이버시 제어를 제대로 잡지 않으면, 기밀 클라이언트 작업을 다루는 전문가 사용자들에게는 딜브레이커가 될 것입니다.

AI 산업에 미치는 영향

프로젝트 아스트라는 명확한 변곡점입니다. 쿼리에 응답하는 AI 어시스턴트에서, 물리적 세계를 인식하고, 추론하고, 행동하는 AI 에이전트로 이동하고 있습니다. 구글의 우위는 AI 모델만이 아닙니다 — Gemini 2.5 Pro의 멀티모달 역량과 구글의 서비스·데이터 생태계의 결합입니다.

경쟁자들에게 메시지는 급박합니다. Apple Intelligence, Samsung Galaxy AI, Microsoft Copilot 모두 유사한 기능을 개발 중이지만, 어느 것도 프로젝트 아스트라 수준의 통합된 실시간 에이전트 행동에 근접한 것을 보여주지 못했습니다. OpenAI의 GPT-4o가 가장 가까운 라이벌이지만, 아스트라를 실용적으로 만드는 디바이스 제어와 생태계 통합이 부족합니다.

앞으로 12개월이 프로젝트 아스트라의 I/O 데모가 사람들이 폰과 상호작용하는 기본 방식이 될지 — 아니면 대규모로 출시되지 못한 인상적인 구글 데모의 무덤에 합류할지를 결정할 것입니다. Gemini Live 카메라 기능이 이미 모든 사용자에게 무료라는 사실에 근거하면, 구글은 전자에 진지해 보입니다.

프로젝트 아스트라 같은 AI 혁신이 크리에이티브 워크플로우와 기술 전략에 어떤 영향을 미치는지 알고 싶으시다면

매주 AI, 음악, 테크 트렌드를 이메일로 받아보세요.