Teenage Engineering TX-6 Superbooth 2025 리뷰: Field System Black과 Link 모드로 진화한 160g 포터블 스튜디오

5월 5, 2025

Mac용 USB-C 모니터 추천 7선: M4 칩 호환 최고의 디스플레이 (2025년 5월)

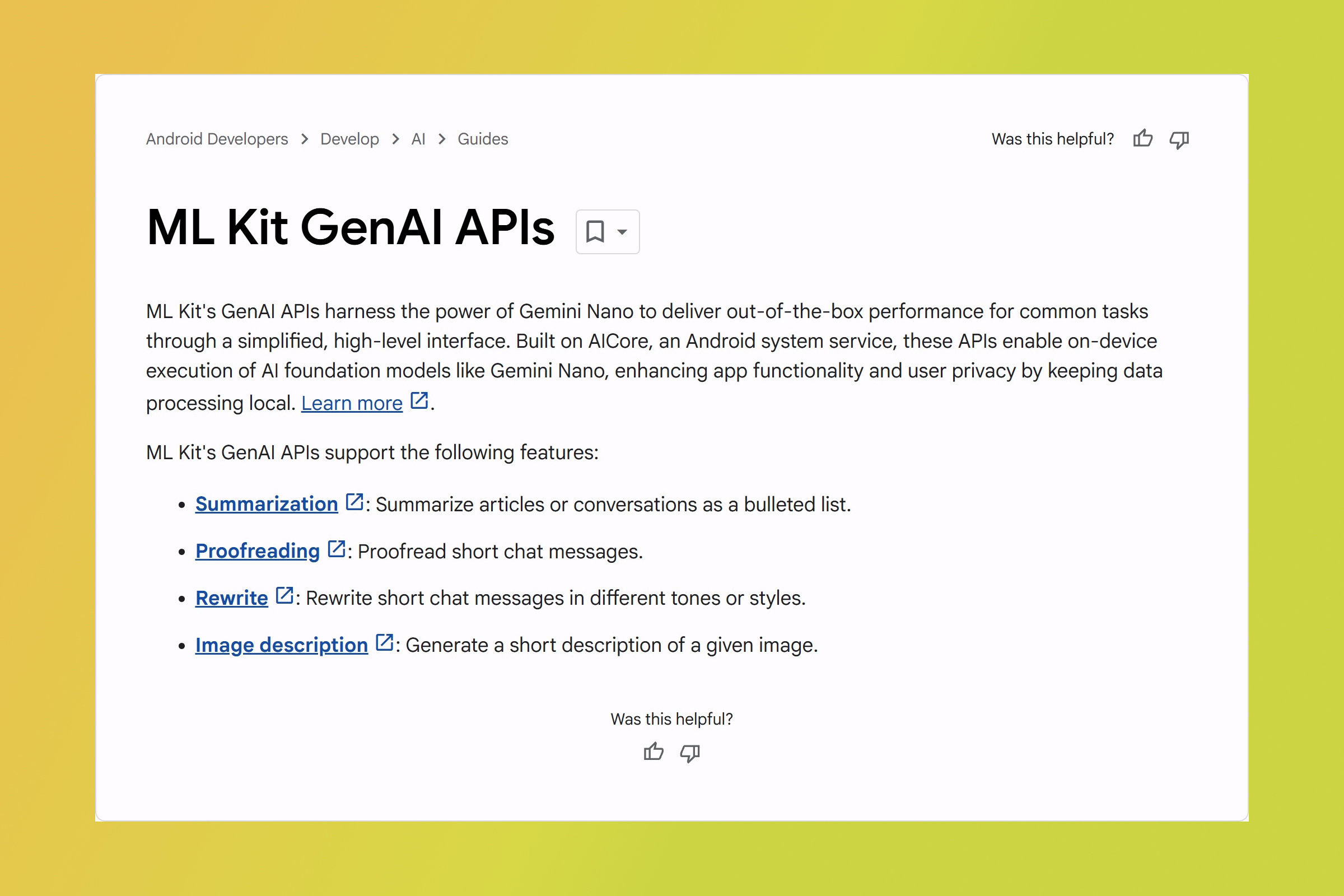

5월 5, 2025클라우드 비용 0원, 데이터 유출 위험 0%. Google I/O 2025 안드로이드 16 AI의 핵심은 바로 이 두 숫자입니다. 구글이 Gemini Nano 기반 ML Kit GenAI API 4종을 프로덕션 레디 상태로 공개했습니다. 요약, 교정, 재작성, 이미지 설명 — 네 가지 기능 모두 스마트폰 내에서 처리되며, 서드파티 앱 개발자라면 누구나 지금 바로 통합할 수 있습니다.

Google I/O 2025 안드로이드 16 AI: 온디바이스가 바꾸는 게임의 규칙

그동안 스마트폰에서 생성형 AI를 실행한다는 것은 곧 클라우드 서버에 데이터를 보내고, 토큰당 요금을 지불하고, 빠른 네트워크 연결을 기도하는 것을 의미했습니다. 구글의 새로운 ML Kit GenAI API는 이 공식을 완전히 뒤집습니다. 구글의 가장 작고 효율적인 대형 언어 모델인 Gemini Nano를 기반으로 모든 처리가 디바이스의 NPU(신경 처리 장치)에서 로컬로 수행됩니다.

의료 기록 앱이 민감한 건강 데이터를 전송하지 않고도 환자 기록을 요약할 수 있습니다. 이메일 클라이언트가 비행기 모드에서도 문법을 교정할 수 있습니다. 콘텐츠 제작 도구가 API 크레딧을 소모하지 않고 문단을 재작성할 수 있습니다. 프라이버시가 기능이 아니라 아키텍처 자체인 것입니다.

Android Developers Blog에 따르면, 구글은 계층적 아키텍처를 설계했습니다. 특화된 LoRA(Low-Rank Adaptation) 어댑터 모델이 Gemini Nano 기본 모델 위에 쌓이며, 각 작업에 맞춰 온도(temperature), top-K 샘플링, 배치 크기 등의 추론 파라미터가 최적화되어 있습니다.

4가지 API: 실제로 무엇을 할 수 있나

1. 요약(Summarization)

최대 3,000 영어 단어 분량의 문서를 간결하게 요약합니다. 스트리밍과 비스트리밍 워크플로우를 모두 지원하여 개발자가 결과를 유연하게 제공할 수 있습니다. LoRA 파인튜닝 후 구글 내부 벤치마크 점수가 77.2에서 92.1로 19% 향상되었으며, 현재 영어, 일본어, 한국어를 지원합니다.

2. 교정(Proofreading)

단순한 맞춤법 검사를 넘어 문법 오류, 어색한 표현, 문체 일관성까지 잡아냅니다. 파인튜닝 후 벤치마크 점수 84.3에서 90.2로 상승했습니다. 7개 언어를 지원하여 글로벌 서비스를 운영하는 다국어 앱에 유용합니다.

3. 재작성(Rewriting)

의미를 보존하면서 텍스트를 다시 작성하는 기능입니다. 콘텐츠 제작, 접근성 기능, 톤 조정에 활용할 수 있습니다. 파인튜닝으로 79.5에서 84.1까지 점수가 개선되었으며, 교정과 마찬가지로 7개 언어를 지원합니다.

4. 이미지 설명(Image Description)

이번 업데이트에서 가장 눈에 띄는 추가 기능입니다. 기존 AI Edge SDK는 텍스트만 처리할 수 있었지만, 새 API는 이미지도 처리합니다. 시각 콘텐츠에 대한 대체 텍스트(alt text)와 상세 설명을 자동 생성하며, 접근성 측면에서 획기적인 변화입니다. Android Authority에 따르면 벤치마크 점수가 86.9에서 92.3으로 상승했으며, 현재는 영어만 지원합니다.

Pixel 전용에서 생태계 전체로: 디바이스 지원 확대

Gemini Nano는 처음에 Pixel 9 전용이었습니다. 하지만 이제 지원 디바이스가 대폭 확대되었습니다:

- 삼성 Galaxy S25 시리즈

- OnePlus 13

- Xiaomi 15

- Motorola Razr 60 Ultra

- HONOR Magic 7

- MediaTek Dimensity, Qualcomm Snapdragon, Google Tensor 탑재 전 기기

더 이상 실험실 프로젝트가 아닙니다. 삼성, 원플러스, 샤오미, 모토로라, 아너 등 주요 제조사의 플래그십 기기가 모두 지원하므로, 개발자는 수억 명의 사용자에게 도달할 것을 확신하면서 온디바이스 AI 기능을 구축할 수 있습니다.

ML Kit GenAI vs. AI Edge SDK: 무엇이 달라졌나

이미 Gemini Nano로 실험하고 있는 개발자라면 이 차이점을 정확히 이해해야 합니다. 기존 AI Edge SDK는 실험적 단계로 텍스트 전용 처리에 제한되어 있습니다. 새로운 ML Kit GenAI API는 베타지만 프로덕션 준비 완료 상태입니다:

- 이미지 지원: AI Edge SDK는 텍스트 전용이었지만, ML Kit GenAI는 텍스트와 이미지 모두 처리

- 고수준 추상화: 프롬프트 엔지니어링 불필요 — 바로 사용 가능한 품질

- 확대된 디바이스 지원: Pixel 넘어 삼성, OnePlus, Xiaomi 등으로 확장

- 프로덕션 안정성: 실험적 단계에서 프로덕션 레디 베타로 격상

InfoQ는 ML Kit GenAI API가 Gemini Nano 기본 모델 위에 특화된 LoRA 어댑터를 쌓는 구현 방식을 채택했다고 보도했습니다. 이는 구글이 전체 기본 모델을 업데이트하지 않고도 개별 작업의 성능을 계속 개선할 수 있다는 뜻입니다.

Firebase AI Logic: 온디바이스로 부족할 때

구글은 온디바이스 AI가 모든 것을 해결한다고 주장하지 않습니다. Gemini Nano의 역량을 초과하는 복잡한 사용 사례를 위해 Google I/O 2025에서 Firebase AI Logic도 함께 공개했습니다. Gemini Pro, Gemini Flash, Imagen 등 더 강력한 클라우드 모델에 접근할 수 있습니다.

현명한 개발 전략은 하이브리드 접근입니다. 프라이버시와 제로 레이턴시의 이점이 있는 일상적인 작업(요약, 교정, 기본 재작성)에는 Gemini Nano를 사용하고, 더 깊은 추론, 긴 컨텍스트 윈도우, 이미지 생성이 필요한 작업에는 Firebase AI Logic을 통해 클라우드 모델로 에스컬레이션하는 것입니다. 이 계층적 아키텍처는 비용을 낮추면서도 기능의 상한선을 유지합니다.

AI 너머: 안드로이드 16의 다른 주요 변화

TechCrunch의 보도에 따르면 Google I/O 2025에서는 AI 외에도 안드로이드 16의 여러 중요한 발표가 있었습니다:

- 라이브 업데이트: 차량 공유, 배달 추적, 내비게이션을 위한 실시간 알림 표면

- 프로페셔널 미디어 및 카메라 기능: 프로급 사진/영상 촬영을 위한 향상된 API

- 데스크톱 윈도잉: 대형 화면 기기와 데스크톱 모드를 위한 멀티윈도우 지원

- 접근성 강화: 새로운 이미지 설명 API를 보완하는 대규모 개선

- Androidify 샘플 앱: 온디바이스와 클라우드 AI를 모두 사용하여 셀피를 고유한 안드로이드 로봇으로 변환하는 데모

내 생각: AI 자동화를 매일 돌리는 엔지니어의 관점

1년 넘게 자동화된 AI 파이프라인을 운영하면서 이번 발표에서 가장 인상적인 점은, 구글이 온디바이스 AI를 ‘지루한 인프라’로 만들고 있다는 것입니다. 좋은 의미에서요. ML Kit GenAI API가 프롬프트 엔지니어링 없이 요약과 이미지 설명에서 벤치마크 90점 이상을 달성한다면, 그것은 연구 논문이 아니라 인프라입니다.

실무적 관점에서 진짜 이야기는 클라우드 비용 제로입니다. 저는 여러 AI 기반 자동화 시스템을 운영하고 있는데, API 비용이 빠르게 누적됩니다. 매일 수천 건의 사용자 요청을 처리하는 모바일 개발자라면, 요약과 교정이 추론당 정확히 0원이 되는 순간 수학이 완전히 달라집니다. 구글은 기본적으로 반복적인 운영 비용(OpEx)이었던 것을 일회성 통합 작업으로 전환시킨 것입니다.

LoRA 어댑터 아키텍처도 주목할 가치가 있습니다. Gemini Nano 기본 모델 위에 작업별 어댑터를 쌓음으로써, 구글은 전체 모델을 모든 기기에 푸시하지 않고도 개별 작업의 개선사항을 배포할 수 있습니다. 파인튜닝된 모델을 매일 다루는 사람으로서, 어댑터 레이어를 독립적으로 업데이트할 수 있을 때 반복 주기가 얼마나 빨라지는지 잘 압니다. 이 설계 결정은 구글이 온디바이스 AI에 대해 데모가 아닌 장기 전략을 가지고 있다는 신호입니다.

제 예측은 이렇습니다: 12개월 이내에 온디바이스 요약과 교정은 텍스트 중심 안드로이드 앱에서 사용자가 당연히 기대하는 기본 기능이 될 것입니다. 마치 맞춤법 검사가 보이지 않는 기본 기능이 된 것처럼요. 지금 이 API를 통합하는 개발자가 사용자 기대치가 바뀔 때 유리한 출발점에 서게 됩니다.

개발자가 지금 바로 해야 할 일

안드로이드 개발자라면 행동 항목이 명확합니다. 첫째, 현재 텍스트를 클라우드 API로 보내서 처리하는 기능(요약, 문법 검사, 콘텐츠 재작성)을 감사하세요. 그것들이 ML Kit GenAI API로의 즉각적인 마이그레이션 후보입니다. 둘째, 접근성 개선을 위한 이미지 설명 API를 탐색하세요. 자동 생성된 대체 텍스트는 UX 향상이자 많은 시장에서 접근성 규정 준수 요건입니다. 셋째, 하이브리드 모델로 AI 아키텍처를 설계하세요: 일상적인 온디바이스 작업에는 Gemini Nano, 복잡한 클라우드 처리에는 Firebase AI Logic.

구글이 방금 출시한 프라이버시 우선, 비용 무료, 오프라인 가능 AI 레이어는 더 이상 있으면 좋은 것이 아닙니다. 안드로이드 개발의 새로운 기준선이며, 전 세계 수억 대의 기기에서 오늘 바로 사용할 수 있습니다.

AI 기반 시스템 구축이나 온디바이스 vs. 클라우드 AI 전략 설계에 대해 궁금하신가요? Sean Kim이 28년 이상의 테크 및 프로덕션 경험으로 도와드립니다.

매주 AI, 음악, 테크 트렌드를 이메일로 받아보세요.