Microsoft MAI 모델 3종 동시 출시 — Whisper 25개 언어 완파, 1초 만에 60초 오디오 생성하는 시대

4월 3, 2026

레노버 레기온 탭 Gen 5 리뷰: 4시간 60FPS, $849로 게이밍폰 시대를 끝내는 8.8인치 괴물

4월 3, 20264월 24일까지 21일 남았습니다. 그리고 그날이 지나면, 여러분이 GitHub Copilot에 입력한 코드 스니펫, 파일명, 레포 구조, 심지어 커서 주변 컨텍스트까지 — 전부 Microsoft의 AI 모델 훈련 데이터가 됩니다. GitHub Copilot 데이터 훈련 정책 변경, 아직 모르고 계셨다면 지금이 마지막 기회입니다.

무슨 일이 벌어지고 있는가: GitHub Copilot 데이터 훈련 정책 변경

2026년 3월 25일, GitHub는 개인정보 처리방침 및 서비스 약관 업데이트를 공지했습니다. 핵심은 단순합니다. 30일 사전 고지 후 4월 24일부터 Copilot Free, Pro, Pro+ 사용자의 인터랙션 데이터를 AI 모델 훈련에 사용하겠다는 것입니다.

GitHub의 CPO Mario Rodriguez는 공식 블로그에서 Microsoft 직원 데이터로 훈련한 모델이 다수 프로그래밍 언어에서 acceptance rate를 향상시켰다고 밝혔습니다. 즉, 여러분의 코드가 Copilot을 더 똑똑하게 만드는 연료가 된다는 뜻입니다.

수집되는 데이터 8가지: 프라이빗 레포도 예외 아닙니다

많은 개발자가 “프라이빗 레포니까 안전하다”고 생각합니다. 하지만 여기서 중요한 구분이 있습니다. GitHub은 프라이빗 레포의 ‘코드 at rest’ — 즉, 저장소에 가만히 있는 코드 — 는 수집하지 않는다고 합니다. 그러나 Copilot 활성 세션 중에 여러분이 작업하는 코드 스니펫은 수집 대상입니다.

GitHub이 수집하는 데이터 유형은 다음과 같습니다:

- 코드 스니펫 — Copilot에 입력하거나 Copilot이 제안한 코드

- 입출력 데이터 — 프롬프트와 응답 전체

- 커서 주변 컨텍스트 — 현재 편집 중인 코드 주변 내용

- 파일명 — 작업 중인 파일의 이름

- 레포 구조 — 프로젝트 디렉토리 구조

- 네비게이션 패턴 — 파일 간 이동 패턴

- 피드백 ratings — 제안 수락/거절 여부

- 편집 이벤트 — 코드 변경 내역

The Register에 따르면, 프라이빗 레포 ‘코드 at rest’는 수집하지 않지만 Copilot 활성 세션 중 코드 스니펫은 수집 대상이라는 점이 핵심입니다. 이 구분이 실질적으로 무엇을 의미하는지 생각해 보십시오 — 프라이빗 레포에서 작업하면서 Copilot을 사용하면, 그 코드 조각은 수집됩니다.

누가 영향을 받고, 누가 보호되는가

영향 범위를 정리하면 명확합니다:

- 영향 대상: Copilot Free, Pro, Pro+ 사용자 (opt-out하지 않으면 자동 적용)

- 제외 대상: Business, Enterprise 구독자 (계약 조건으로 보호)

- 제외 대상: 학생 및 교사 계정 (GitHub Education)

- 이전 opt-out 사용자: 기존에 opt-out 설정한 경우 그대로 유지

결론적으로, 개인 개발자와 소규모 팀이 가장 큰 영향을 받습니다. 대기업은 Enterprise 라이선스로 보호받지만, 프리랜서나 스타트업 개발자들은 직접 opt-out해야 합니다.

커뮤니티 반응: 59개의 Thumbs-Down

GitHub 커뮤니티 토론의 반응은 압도적으로 부정적이었습니다. 59개의 thumbs-down 대 3개의 rocket emoji. 39개 댓글 중 긍정적 반응을 보인 것은 GitHub VP Martin Woodward 한 명뿐이었습니다.

보안 전문가들은 opt-out by default — 즉, 사용자가 직접 거부하지 않으면 자동으로 데이터를 수집하는 방식 — 를 “다크 패턴”이라고 비판하고 있습니다. InfoQ의 분석에 따르면 이번 정책 변경의 기술적 임팩트는 1억 명 이상의 GitHub 사용자에게 영향을 미칠 수 있습니다.

GitHub의 방어 논리도 흥미롭습니다. Anthropic, JetBrains, Microsoft도 유사한 opt-out 정책을 운영하고 있다는 것입니다. 하지만 “다른 회사도 하니까 괜찮다”는 논리가 개발자들의 분노를 잠재우지는 못하고 있습니다.

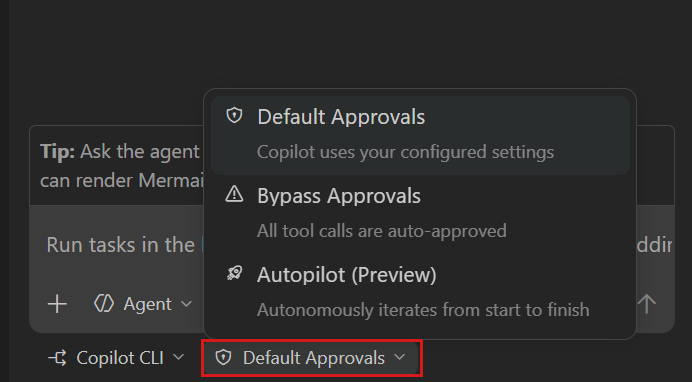

Opt-Out 방법: 4월 24일 전에 반드시 확인하세요

다행히 opt-out 과정은 간단합니다. 단계별로 따라하시면 됩니다:

- 1단계: GitHub.com에 로그인 후 우측 상단 프로필 아이콘 클릭

- 2단계: Settings → Copilot 메뉴로 이동

- 3단계: “Allow GitHub to use my code snippets from Copilot for product improvements” 옵션 찾기

- 4단계: 해당 토글을 OFF로 전환

- 5단계: 조직 레포에서도 작업한다면, 조직 관리자에게 조직 수준 설정도 확인 요청

중요: 이미 이전에 opt-out한 사용자는 설정이 유지됩니다. 하지만 한 번도 확인한 적 없다면 반드시 점검하십시오. 4월 24일 이후에는 이미 수집된 데이터를 되돌릴 수 없습니다.

GitHub의 방어 논리 vs 현실

GitHub은 이번 정책을 정당화하면서 몇 가지 포인트를 내세웁니다. 하나씩 살펴보겠습니다.

“Microsoft 직원 데이터로 훈련한 결과, acceptance rate가 향상되었다.” 사실일 수 있습니다. 하지만 내부 직원은 데이터 사용에 대해 고용 계약으로 동의한 상태입니다. 외부 사용자에게 같은 논리를 적용하는 것은 다른 문제입니다.

“Anthropic, JetBrains도 유사한 정책을 운영한다.” 맞습니다. 하지만 다른 회사가 한다고 해서 윤리적으로 정당화되는 것은 아닙니다. 특히 GitHub은 전 세계 오픈소스 생태계의 중심이라는 특수한 위치에 있습니다.

“프라이빗 레포 코드는 수집하지 않는다.” 저장소에 있는 코드 자체는 맞습니다. 하지만 Copilot 세션 중 해당 코드를 편집하면? 그 순간의 스니펫은 수집 대상입니다. 이 ‘기술적 구분’이 실무에서 얼마나 의미 있는지는 의문입니다.

Sean’s Take: 현장 개발자가 지금 당장 해야 할 일

28년간 음악과 테크 업계를 넘나들면서 수많은 플랫폼의 정책 변경을 목격했습니다. 패턴은 항상 비슷합니다 — 무료로 사용자를 끌어모으고, 충분히 의존하게 만든 다음, 조건을 바꿉니다. Spotify가 아티스트 정산 구조를 바꿨을 때도, Adobe가 구독 모델로 전환했을 때도 그랬습니다.

이번 GitHub Copilot 데이터 훈련 정책 변경도 같은 맥락입니다. 저는 현재 여러 자동화 프로젝트에서 Copilot을 활발하게 사용하고 있고, 당연히 4월 24일 전에 opt-out을 완료할 계획입니다. 하지만 단순히 opt-out 버튼을 누르는 것만으로는 충분하지 않다고 생각합니다.

실무 개발자로서 제안하는 액션 아이템은 이렇습니다. 첫째, 지금 바로 GitHub Settings → Copilot에서 데이터 사용 토글을 끄십시오. 둘째, 팀에서 작업한다면 조직 관리자에게 조직 수준 설정을 확인하라고 알리십시오. 셋째, 민감한 코드(인증 로직, API 키 처리, 프로프라이어터리 알고리즘)를 다룰 때는 Copilot을 일시적으로 비활성화하는 습관을 들이십시오. 넷째, 장기적으로는 GitHub 의존도를 줄이고 대안 플랫폼(GitLab, Codeberg 등)도 살펴보는 것이 현명합니다.

이건 Copilot의 가치에 대한 부정이 아닙니다. AI 코딩 어시스턴트는 생산성을 확실히 올려줍니다. 문제는 그 대가로 지불하는 것이 월 구독료만이 아니라 여러분의 코드 데이터까지라는 점입니다. 개발자라면 자신의 코드에 대한 주권은 직접 챙겨야 합니다.

이번 GitHub Copilot 데이터 훈련 정책 변경은 AI 시대에 개발자 데이터 주권이라는 더 큰 질문을 던지고 있습니다. 4월 24일이라는 데드라인이 있다는 것은 오히려 다행입니다 — 최소한 행동할 시간은 있으니까요. 중요한 것은 그 시간을 허비하지 않는 것입니다.

개발 워크플로우 자동화나 기술 컨설팅이 필요하시다면, 28년 경력의 전문가와 상담해 보세요.

매주 AI, 음악, 테크 트렌드를 이메일로 받아보세요.