삼성 오디세이 OLED G8 32인치 리뷰: $999에 만나는 4K 240Hz QD-OLED의 진짜 실력

10월 17, 2025

Ableton Live 12 클립 런칭 고급 테크닉: 전자음악 라이브 퍼포먼스의 게임 체인저

10월 20, 2025OpenAI API 비용 청구서를 보고 깜짝 놀란 적 있으신가요? 저도 그랬습니다. 프로토타입 단계에서 하루 $47이 나왔을 때, 이대로는 프로덕션에 올릴 수 없다는 걸 깨달았습니다. 그때 발견한 것이 바로 Cloudflare AI Gateway입니다. 코드 한 줄만 바꾸면 모든 LLM API 호출을 모니터링하고, 캐싱하고, 속도 제한까지 걸 수 있습니다.

Cloudflare AI Gateway란? — LLM API의 관제탑

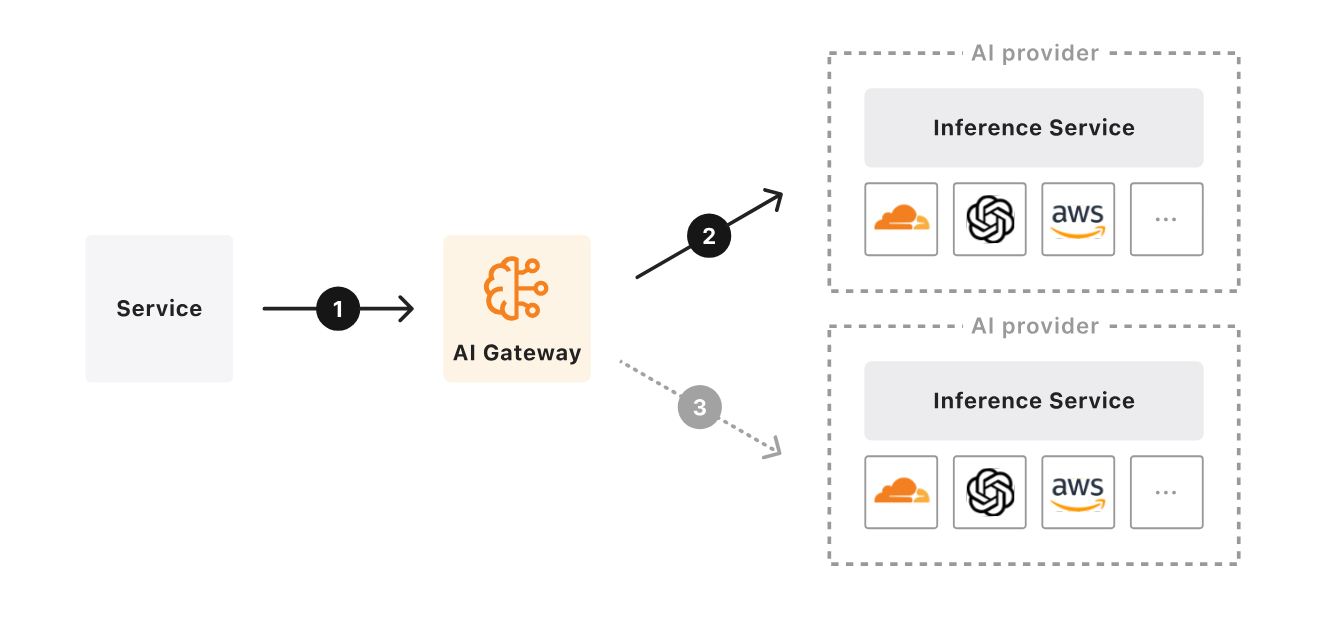

Cloudflare AI Gateway는 여러분의 애플리케이션과 AI 모델 제공자(OpenAI, Anthropic, Groq, Hugging Face 등) 사이에 위치하는 프록시 레이어입니다. 2023년 9월 베타로 시작해 2024년 5월 정식 출시(GA)되었으며, 출시 이후 20억 건 이상의 요청을 처리했습니다. 핵심은 단순합니다 — API 호출의 baseURL 한 줄만 Cloudflare 엔드포인트로 바꾸면, 기존 코드를 전혀 수정하지 않고도 모니터링, 캐싱, 속도 제한, 폴백 등 모든 기능을 사용할 수 있습니다.

무료 플랜에서도 핵심 기능(대시보드 분석, 캐싱, 속도 제한)을 모두 사용할 수 있다는 점이 특히 매력적입니다. Cloudflare 계정만 있으면 됩니다.

5분 만에 설정하기 — 실전 가이드

Step 1: Gateway 생성

Cloudflare 대시보드에서 AI → AI Gateway로 이동한 뒤, Gateway를 생성합니다. Gateway ID는 URL에 사용되는 슬러그이므로 프로젝트명과 일치시키면 관리가 편합니다.

Step 2: 코드 한 줄 변경

기존 OpenAI SDK를 사용하고 있다면, baseURL만 변경하면 됩니다:

// 변경 전

const openai = new OpenAI({ apiKey: "sk-..." });

// 변경 후 — Cloudflare AI Gateway 경유

const openai = new OpenAI({

apiKey: "sk-...",

baseURL: "https://gateway.ai.cloudflare.com/v1/{account_id}/{gateway_id}/openai"

});Anthropic SDK도 동일한 패턴입니다:

import Anthropic from '@anthropic-ai/sdk';

const client = new Anthropic({

apiKey: "sk-ant-...",

baseURL: "https://gateway.ai.cloudflare.com/v1/{account_id}/{gateway_id}/anthropic"

});이것이 전부입니다. 이 한 줄의 변경으로 모든 요청이 Cloudflare를 경유하게 되고, 대시보드에서 실시간으로 모니터링할 수 있습니다.

캐싱으로 비용 90% 절감 — 동일 요청은 한 번만

Cloudflare AI Gateway의 가장 강력한 기능은 캐싱입니다. 동일한 프롬프트로 동일한 모델에 요청하면, 첫 번째 응답을 캐시에 저장하고 이후 동일 요청은 캐시에서 즉시 반환합니다. Cloudflare에 따르면 캐싱으로 레이턴시를 최대 90%까지 줄일 수 있습니다.

실제로 어떤 시나리오에서 효과적일까요?

- FAQ 챗봇: 비슷한 질문이 반복되는 고객 지원 봇에서 80% 이상의 캐시 적중률 달성 가능

- 콘텐츠 분류: 동일한 카테고리 분류 프롬프트가 반복되는 파이프라인

- 코드 리뷰: 같은 패턴의 코드에 대한 분석 요청

- 번역: 동일 문구의 다국어 번역 요청

캐싱 규칙은 대시보드에서 TTL(Time To Live)을 설정하거나, 커스텀 캐시 키를 정의하여 세밀하게 제어할 수 있습니다.

속도 제한으로 예산 폭탄 방지

LLM 기반 서비스에서 가장 두려운 것은 예상치 못한 트래픽 급증입니다. 한 사용자가 봇을 돌리거나, 버그로 무한 루프가 발생하면 몇 시간 만에 수천 달러가 청구될 수 있습니다. Cloudflare AI Gateway의 속도 제한(Rate Limiting)은 이런 상황을 원천 차단합니다.

- 고정 창(Fixed Window): 지정 시간당 최대 요청 수 제한

- 슬라이딩 창(Sliding Window): 더 세밀한 트래픽 제어

- 사용자별/IP별 제한: 특정 사용자의 남용 방지

예를 들어, 분당 100요청, 일일 10,000요청으로 제한하면 월 최대 비용을 예측 가능한 수준으로 관리할 수 있습니다. GPT-4 turbo 기준 일일 10,000요청이면 약 $30~50 범위로 제어됩니다.

실시간 분석 대시보드 — 토큰, 비용, 에러 한눈에

Cloudflare AI Gateway 대시보드는 모든 AI 제공자의 요청을 한 곳에서 모니터링할 수 있게 해줍니다. 추적 가능한 지표:

- 요청 수: 시간대별 트래픽 패턴

- 토큰 사용량: 입력/출력 토큰 분리 집계

- 비용 추적: 제공자별, 모델별 비용 분석

- 에러율: 4xx, 5xx 에러 패턴 파악

- 레이턴시: P50, P95, P99 응답 시간

- 캐시 적중률: 캐싱 효율 확인

2024년 9월 Birthday Week 업데이트에서 영구 로그(Persistent Logs)가 오픈 베타로 추가되어, 게이트웨이당 최대 1,000만 건의 로그를 저장하고 검색할 수 있게 되었습니다. 각 요청의 프롬프트, 응답, 비용, 소요 시간을 상세히 확인할 수 있어 디버깅과 최적화에 필수적입니다.

폴백(Fallback)과 재시도(Retry) — 장애에도 끄떡없는 AI 서비스

OpenAI가 다운되면 여러분의 서비스도 다운됩니다 — AI Gateway를 쓰기 전까지는요. 폴백 기능을 설정하면, 주 모델에 에러가 발생했을 때 자동으로 대체 모델로 라우팅합니다.

// Universal Endpoint — 폴백 체인 예시

const response = await fetch(

`https://gateway.ai.cloudflare.com/v1/{account_id}/{gateway_id}`,

{

method: "POST",

headers: { "Content-Type": "application/json" },

body: JSON.stringify([

{ provider: "openai", endpoint: "chat/completions", ... },

{ provider: "anthropic", endpoint: "messages", ... },

{ provider: "workers-ai", endpoint: "@cf/meta/llama-3.1-8b-instruct", ... }

])

}

);이 설정으로 OpenAI → Anthropic → Workers AI 순서로 폴백이 작동합니다. 재시도 옵션도 있어서 일시적인 네트워크 오류에도 자동으로 복구됩니다. 프로덕션 환경에서 99.9% 가용성을 달성하는 데 핵심적인 기능입니다.

실전 활용 시나리오: 블로그 자동화 파이프라인에 적용

실제로 Cloudflare AI Gateway를 적용하면 어떤 변화가 생길까요? 예를 들어, 매일 LLM을 활용해 콘텐츠를 생성하는 파이프라인이 있다고 가정합시다:

- 도입 전: 일일 API 비용 $30~50, 에러 시 수동 재시도, 비용 추적은 월말 청구서로만 확인

- 도입 후: 캐싱으로 반복 요청 제거 → 일일 $5~15, 폴백으로 자동 복구, 실시간 대시보드로 비용/성능 즉시 확인

특히 여러 AI 제공자를 동시에 사용하는 경우(예: GPT-4 turbo + Claude + Llama), 각 제공자의 대시보드를 따로 확인할 필요 없이 Cloudflare AI Gateway 하나로 통합 모니터링이 가능합니다.

무료인데 왜 안 쓰나요? — 시작하기

Cloudflare AI Gateway의 핵심 기능(분석 대시보드, 캐싱, 속도 제한, 폴백)은 모든 플랜에서 무료입니다. 유료 기능은 영구 로그 확장(무료: 10만~20만 건, 추가: 10만 건당 월 $8)과 Logpush 통합 정도입니다.

LLM API를 사용하는 모든 프로젝트에서 Cloudflare AI Gateway는 필수 도구라고 생각합니다. 5분 만에 설정할 수 있고, 코드 변경은 한 줄이며, 그 한 줄이 매달 수백 달러의 비용을 절감해줄 수 있습니다. 아직 AI API 호출에 프록시를 쓰지 않고 있다면, 오늘 당장 시작해보시길 권합니다.

더 자세한 설정 방법은 Cloudflare AI Gateway 공식 문서에서 확인하실 수 있으며, GA 발표 블로그에서 전체 기능 목록을 확인할 수 있습니다.

AI 기반 자동화 시스템 구축이나 LLM API 파이프라인 최적화에 관심이 있으시다면, 기술 상담을 통해 구체적인 방법을 안내해드리겠습니다.

매주 AI, 음악, 테크 트렌드를 이메일로 받아보세요.