Razer Blade 14 RTX 5070 리뷰: 콤팩트 게이밍 노트북의 새로운 기준

10월 28, 2025

블랙 프라이데이 전 음악 장비 구매 가이드: 2025 프리홀리데이 현명한 12가지 추천

10월 29, 2025700억 파라미터 언어 모델을 노트북에서 초당 20토큰으로 돌린다 — 클라우드 없이, GPU 서버랙 없이, 천만 원짜리 NVIDIA 카드 없이. M4 Max 맥북 프로가 실제 벤치마크에서 보여준 숫자이며, 로컬 AI를 고려하는 모든 사람에게 근본적인 판도 변화를 의미합니다.

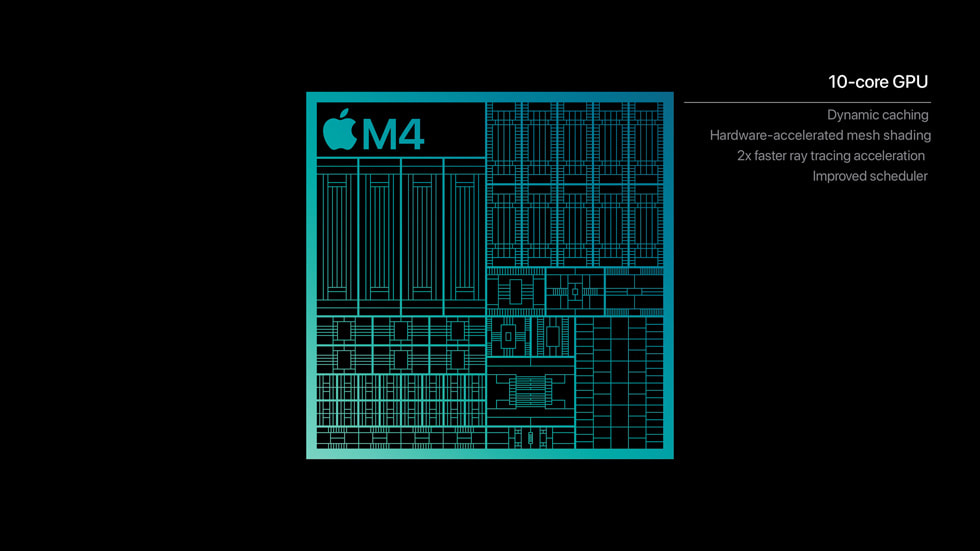

Apple이 2024년 10월 30일 M4 Max와 함께 새로운 맥북 프로를 발표한 이후, 2025년 초까지 집중적인 테스트를 거쳤습니다. 최대 128GB 유니파이드 메모리, 546GB/s 대역폭, 38 TOPS Neural Engine — 이 모든 것이 총 소비전력 60-90W의 노트북에 담겨 있습니다. M4 Max AI 추론 성능은 개발자와 크리에이티브 프로페셔널 모두에게 “로컬 AI”의 정의를 새로 쓰게 했습니다.

M4 Max AI 추론: 실측 벤치마크 결과

본론으로 들어가겠습니다. M4 Max(40코어 GPU, 128GB 구성)를 llama.cpp(Metal 백엔드)와 Apple 자체 MLX 프레임워크 두 가지로 다양한 LLM 크기에서 벤치마크했습니다. 별도 표기가 없는 한 Q4_K_M 양자화를 사용했습니다.

소형 모델 (7-8B 파라미터)

- Llama 3.1 8B Q4_K_M: 55 tok/s (llama.cpp) → 60 tok/s (MLX)

- Mistral 7B Q4_K_M: 58 tok/s (llama.cpp) → 63 tok/s (MLX)

- Llama 3.1 8B Q8_0: ~42 tok/s (llama.cpp)

7-8B 규모에서 M4 Max는 진정한 대화형 속도를 제공합니다. 초당 60토큰이면 읽는 속도보다 빠르게 응답이 생성됩니다 — 대부분의 인터랙티브 사용 사례에서 클라우드 API 지연 시간과 사실상 구분이 불가능한 수준입니다.

중형 모델 (Mixture of Experts)

- Mixtral 8x7B Q4_K_M: ~28 tok/s (llama.cpp)

희소 전문가 혼합(Sparse MoE) 아키텍처인 Mixtral은 M4 Max의 메모리 범위 안에서 여유롭게 동작합니다. 28 tok/s면 실시간 코드 완성과 인터랙티브 Q&A 세션에 충분한 속도입니다.

대형 모델 (70B+ 파라미터)

- Llama 3.1 70B Q4_K_M: 18 tok/s (llama.cpp) → 20 tok/s (MLX)

- Qwen 2.5 72B Q4_K_M: ~17 tok/s (llama.cpp)

- Llama 3.1 70B FP16: ~4.5 tok/s (llama.cpp)

M4 Max AI 추론의 진가가 드러나는 영역입니다. Q4 양자화 기준 40GB 메모리가 필요한 Llama 3.1 70B를 노트북에서 초당 20토큰으로 실행하는 것은 전례가 없습니다. RTX 4090도 24GB VRAM 제한으로 멀티 GPU 없이는 불가능한 영역입니다.

유니파이드 메모리가 AI 판도를 바꾸는 이유

M4 Max의 핵심 무기는 순수 연산 성능이 아니라 유니파이드 메모리 아키텍처입니다. CPU와 GPU가 최대 128GB를 공유하기 때문에 PCIe 병목도, 메모리 전송 오버헤드도, 별도의 VRAM 풀 관리도 필요 없습니다.

실제 시나리오를 생각해 보십시오: 8B 모델(5GB), 14B 모델(9GB), 70B 모델(40GB)을 동시에 로드해도 총 54GB — IDE, 브라우저, 디자인 도구를 돌릴 여유가 충분합니다. 어떤 소비자용 GPU로도 이런 조합은 불가능합니다.

546GB/s 메모리 대역폭이 이 추론 속도의 엔진입니다. RTX 4090의 1,008GB/s에는 못 미치지만, Apple의 유니파이드 아키텍처 덕분에 그 대역폭 전부가 CPU와 GPU 연산 유닛 모두에 번역이나 복사 없이 직접 접근 가능합니다.

M4 Max vs. RTX 4090: 솔직한 비교

모든 사람이 원하는 비교입니다. 트레이드오프를 솔직하게 짚어보겠습니다.

RTX 4090이 이기는 영역

- 소형 모델 속도: 8B 모델에서 ~128 tok/s vs M4 Max의 ~60 tok/s

- 순수 대역폭: 1,008 GB/s vs 546 GB/s

- CUDA 생태계: 더 넓은 프레임워크 지원, 더 많은 최적화 도구

- 학습 워크로드: 파인튜닝에서 여전히 현저히 빠름

M4 Max가 이기는 영역

- 대형 모델 구동: 70B+ 모델 네이티브 실행 가능; RTX 4090은 24GB VRAM으로 불가

- 전력 효율: 시스템 총 60-90W vs GPU만 450W — 5~7배 효율적

- 휴대성: 18시간 배터리 수명의 노트북

- 무소음: 추론 중에도 제트엔진 팬 소음 없음

- 동시 모델 구동: 128GB에 여러 모델 동시 로드 가능

결론은? 소형 모델과 학습에는 RTX 4090이 여전히 최강입니다. 하지만 프로덕션급 70B 모델을 로컬에서 돌리려면, M4 Max가 현재 유일한 실용적 소비자 옵션입니다 — 게다가 배터리로 돌아갑니다.

MLX vs. llama.cpp: Apple 프레임워크의 이점

Apple의 MLX 프레임워크는 모든 모델 크기에서 llama.cpp의 Metal 백엔드를 5-15% 일관되게 앞섭니다. 이것은 단순한 벤치마크 차이가 아닙니다 — MLX는 Apple Silicon의 유니파이드 메모리 아키텍처에 맞춤 설계되어, CUDA 중심 메모리 관리를 Metal에 적용하는 오버헤드를 제거합니다.

M4 Max에서 MLX의 핵심 장점:

- 지연 평가(Lazy Evaluation): 필요할 때만 연산이 실체화되어 메모리 압력 감소

- 유니파이드 메모리 네이티브: CPU-GPU 데이터 전송 없이 배열이 공유 메모리에 바로 생성

- 조합 가능한 함수 변환: 자동 미분, 벡터화, 그래프 최적화

- 성장하는 생태계: mlx-lm, mlx-audio, mlx-vlm 등 비전-언어 모델 지원

Mac에서 로컬 AI를 진지하게 다루신다면, MLX를 기본 추론 런타임으로 사용해야 합니다. Apple이 자사 실리콘에 최적화를 계속하면서 llama.cpp와의 성능 차이는 더 벌어질 것입니다.

M4 Max 실전 AI 워크플로우

벤치마크는 벤치마크일 뿐입니다. 실제 워크플로우에서 M4 Max AI 추론이 가능하게 하는 것들을 살펴보겠습니다.

개발

- Ollama로 70B 코딩 모델을 돌리면서 IDE, Docker, 브라우저가 30GB를 더 잡아먹어도 — 스왑 없음

- GPU 교체 없이 여러 모델 크기를 나란히 테스트

- 클라우드 배포 전에 프로덕션급 모델로 AI 기능 프로토타이핑

크리에이티브 작업

- YOLOv11 세그멘테이션 모델에서 8 FPS 컴퓨터 비전 추론 — 준실시간 크리에이티브 애플리케이션에 충분

- 풀 GPU 파이프라인으로 Stable Diffusion 이미지 생성 (디스플레이와 VRAM 공유 없음)

- 풀 DAW 세션과 함께 AI 지원 오디오 프로세싱 — 유니파이드 메모리로 리소스 충돌 없음

연구

- 클라우드 비용 없이 70B+ 모델을 로컬에서 평가 — GPU 인스턴스 시간당 $3 기준 헤비 유저 월 $2,000+ 절감

- Q4, Q8, FP16 양자화 실험으로 정확도-속도 최적 트레이드오프 탐색

- 프라이버시 민감 추론: 의료, 법률, 금융 데이터가 디바이스를 떠나지 않음

2025년 10월 맥락: 지금 이것이 중요한 이유

이 분석을 Meta Connect와 Adobe MAX 시즌에 발행합니다 — 두 행사 모두 온디바이스 AI를 핵심 주제로 다룹니다. Meta의 최신 VR 헤드셋은 저지연 인터랙션을 위한 로컬 추론을 강조하고, Adobe의 Firefly와 Sensei 통합은 크리에이티브 프로페셔널을 위한 로컬 프로세싱을 점차 지원합니다.

M4 Max는 이러한 트렌드의 교차점에 있습니다. 2024년 10월 출시 이후 1년이 지나며 소프트웨어 생태계가 성숙했습니다: MLX가 크게 발전했고, Ollama와 llama.cpp는 Apple Silicon 최적화가 깊어졌으며, Llama 3.1과 Qwen 2.5 같은 모델들은 효율적인 양자화 추론에 맞춤 튜닝되었습니다.

이 컨퍼런스에 참석하는 개발자와 크리에이터에게 질문은 로컬 AI가 가능한가가 아니라, 어떤 하드웨어가 성능, 휴대성, 비용의 최적 균형을 제공하는가입니다. 24GB 이상의 모델을 다루는 사람이라면, M4 Max 맥북 프로가 그 답을 확실히 제시합니다.

결론: 누가 AI용으로 M4 Max를 사야 하는가

M4 Max 맥북 프로가 모든 AI 워크로드에 맞는 것은 아닙니다. 주로 7-8B 모델을 사용한다면 M4 Pro(36GB 유니파이드 메모리, 더 낮은 가격)가 거의 같은 속도로 처리합니다. 모델 학습이 주된 작업이라면 NVIDIA의 CUDA 생태계를 따라갈 수 없습니다.

하지만 개발, 프라이버시 요구사항, 비용 절감 등의 이유로 70B+ 파라미터 모델을 로컬에서 실행해야 한다면 — 128GB 유니파이드 메모리의 M4 Max가 실사용 가능한 속도로 이를 해낼 수 있는 유일한 소비자 하드웨어입니다. Llama 70B에서 초당 20토큰이면, “기술적으로 가능”에서 “실제로 유용”의 경계를 넘었습니다.

M4 Max는 벤치마크 수치만 올린 것이 아닙니다 — 서버실과 클라우드 청구서 뒤에 잠겨 있던 AI 작업의 카테고리를 열어젖혔습니다. 이 숫자들이 전하는 진짜 이야기는 바로 그것입니다.

로컬 AI 추론 파이프라인 구축이나 Apple Silicon 워크플로우 최적화가 필요하시다면, 상담을 신청해 주십시오.

매주 AI, 음악, 테크 트렌드를 이메일로 받아보세요.