삼성 갤럭시 워치 울트라 리뷰: $649 티타늄 스마트워치가 Wear OS의 게임을 바꾼 이유

8월 15, 2025

컨볼루션 리버브 완벽 비교: Space Designer vs Altiverb vs 무료 IR Loader (2025)

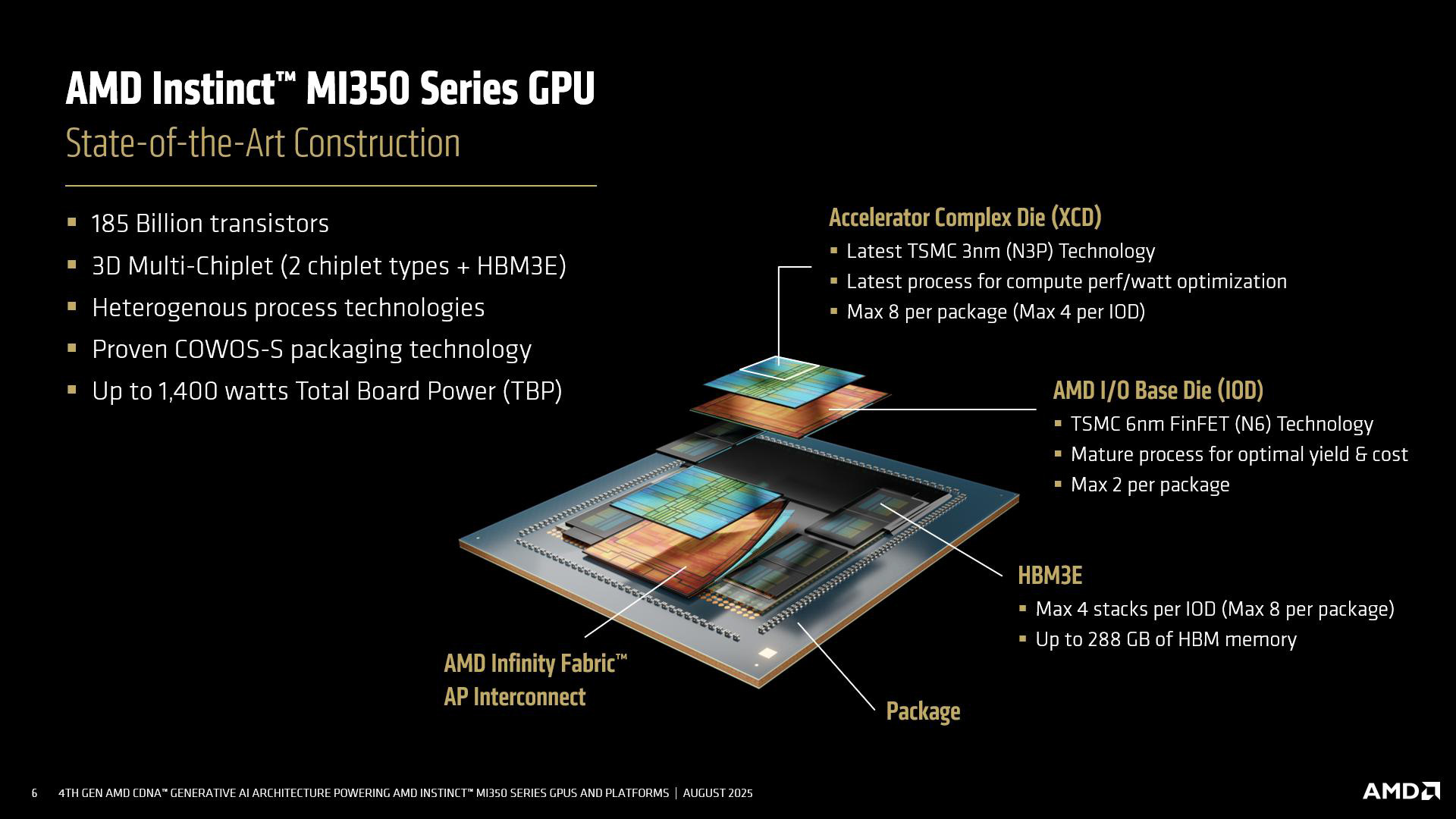

8월 18, 20251,850억 개의 트랜지스터. 288GB HBM3e 메모리. 10페타플롭스 AI 연산 성능. 로드맵 슬라이드의 예상 수치가 아닙니다 — AMD가 Hot Chips 2025에서 Instinct MI350의 전체 기술 사양을 공개했고, 이 숫자들은 주목할 만합니다.

AMD Instinct MI350: Hot Chips에서 공개된 CDNA 4 아키텍처 심층 분석

2025년 8월 Hot Chips 심포지엄에서 AMD 아키텍트들은 새로운 Instinct MI350 시리즈를 구동하는 CDNA 4 아키텍처의 가장 포괄적인 기술 분석을 발표했습니다 (ServeTheHome 분석). 이것은 마케팅 키노트가 아니었습니다 — AMD가 데이터센터 AI 가속기 시장에서 NVIDIA와의 격차를 어떻게 좁힐 계획인지 실리콘 수준에서 공개한 심층 다이브였습니다.

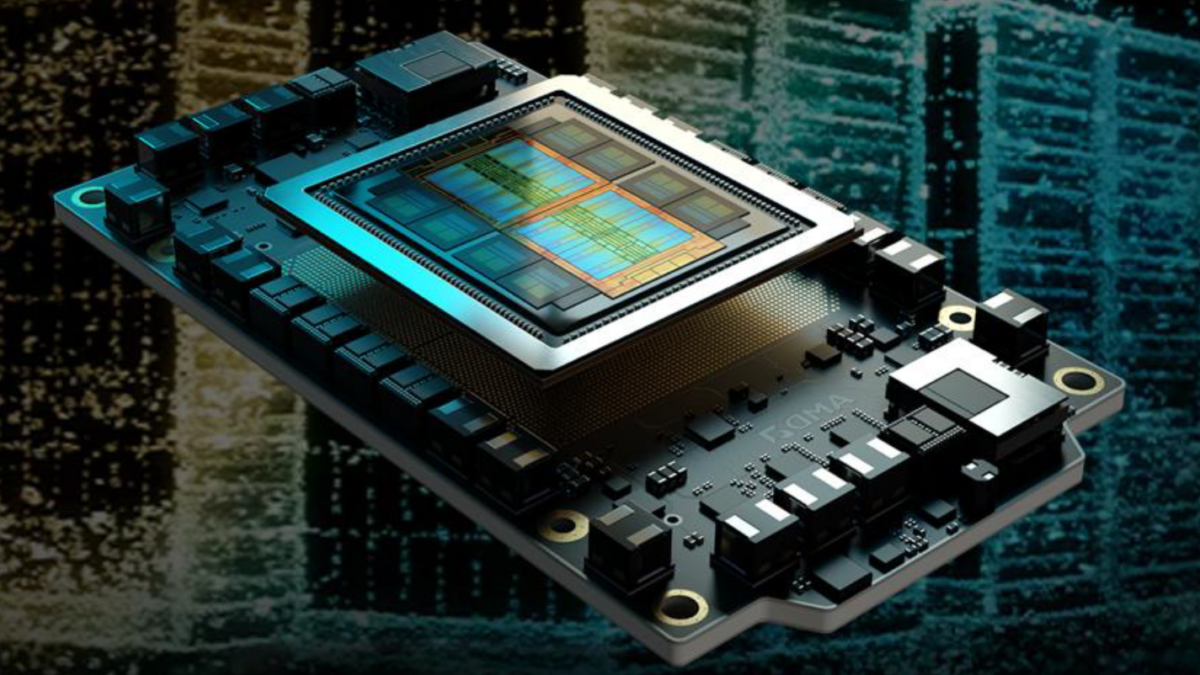

AMD Instinct MI350은 MI300 시리즈에서 세대적 도약을 이루었습니다. 컴퓨트 다이에 TSMC N3P 공정, I/O 다이에 N6 공정을 적용한 MI350은 정교한 3D 칩렛 설계를 채택했습니다. 최대 8개의 가속기 컴플렉스 다이(XCD)가 CoWoS-S 패키징 기술로 2개의 I/O 다이 위에 적층되어, 반도체 공학의 한계를 밀어붙이는 1,850억 개 트랜지스터의 거대한 프로세서를 만들어냈습니다.

MI350X vs MI355X: 데이터센터 요구사항에 맞춘 두 가지 변형

AMD는 MI350을 두 가지 구성으로 출시합니다. MI350X는 1,000W TDP와 최대 2.2GHz 엔진 클럭으로 공랭 환경을 대상으로 합니다. MI355X는 수랭 방식으로 더 나아가 1,400W에서 2.4GHz를 달성합니다 — 상당한 전력 규모이지만, AMD는 전례 없는 성능 밀도를 제공한다고 주장합니다.

두 변형 모두 16,384개의 스트림 프로세서와 1,024개의 매트릭스 엔진을 탑재한 256개의 컴퓨트 유닛을 갖추고 있습니다. 8개 XCD 각각에 32개의 CDNA 4 기반 컴퓨트 유닛이 포함되어 있으며, 모든 XCD에 걸쳐 코히런트한 4MB L2 캐시를 제공합니다. 메모리 서브시스템은 8스택의 12-Hi HBM3e 메모리로 구성되어 288GB 용량에 8.0TB/s 대역폭을 제공합니다 — MI300X의 192GB HBM3, 5.3TB/s에서 대폭 업그레이드된 수치입니다.

AMD Instinct MI350을 주목하게 만드는 성능

AMD의 Hot Chips 발표에서 나온 성능 수치는 놀랍습니다. MI355X는 매트릭스 FP16/BF16에서 2.5 PFLOPS를 달성합니다 — MI300X 대비 1.9배 향상입니다. AI 추론의 표준이 되어가는 FP8 정밀도에서 MI350은 5.0 PFLOPS에 도달하며, 역시 전세대를 약 두 배 뛰어넘습니다.

그러나 헤드라인 수치는 새로운 MXFP6 및 MXFP4 데이터 타입 지원입니다. CDNA 4는 최초로 하드웨어 네이티브 FP6 및 FP4 연산을 도입하여 10 PFLOPS의 AI 처리량을 가능하게 합니다 — 이전 하드웨어에는 존재하지 않았던 기능입니다. AMD는 이것이 Llama 3.1 405B와 같은 모델 실행 시 MI300 대비 35배의 추론 성능 도약과 전체 AI 컴퓨트의 4배 세대간 개선으로 이어진다고 주장합니다.

NVIDIA 대결: MI350 vs GB200 비교 분석

AMD는 Hot Chips에서 경쟁 비교를 피하지 않았습니다. MI350이 NVIDIA GB200 SXM 대비 2.1배 높은 컴퓨트 출력을 제공한다고 주장했습니다 — 독립 벤치마크에서 검증될 경우, AI 가속기 시장의 판도를 크게 바꿀 수 있는 대담한 주장입니다. Infinity Fabric 4 인터커넥트는 MI300의 IF3보다 2TB/s 더 많은 대역폭을 제공하며, 유연한 NUMA 구성을 지원하여 멀티 GPU 스케일링 시나리오에서 AMD에게 이점을 줄 수 있습니다.

플랫폼 전략도 중요합니다. MI350X는 기존 MI300/MI325 시스템의 드롭인 업그레이드로 설계되어, AMD 생태계에 이미 투자한 데이터센터의 진입 장벽을 낮춥니다. 랙 밀도는 수랭 랙당 96-128 GPU, 공랭 구성에서 64 GPU에 달합니다. AMD의 ROCm 7 소프트웨어 스택이 하드웨어 출시와 함께 추론 및 학습 워크로드 최적화를 제공합니다.

로드맵: 2026년 MI400과 그 너머

AMD의 야심을 가장 잘 보여주는 것은 Hot Chips 발표에서 공개된 미래 로드맵입니다. CDNA 5 아키텍처 기반으로 2nm/3nm 공정에서 제조되는 MI400 시리즈는 2026년 출시 예정이며, AI 프론티어 모델에 최대 10배 더 많은 성능을 약속합니다. 더 먼 미래에는 완전한 2nm 공정의 CDNA 6 기반 MI500도 로드맵에 올라 있습니다. AMD는 NVIDIA가 설정한 공격적인 속도에 맞춰 연간 가속기 업그레이드 주기에 확실히 투자하고 있습니다.

AI 가속기 시장은 오랫동안 NVIDIA의 독무대였지만, AMD Instinct MI350은 AMD의 가장 신뢰할 수 있는 도전을 대표합니다. 1,850억 개의 트랜지스터, 10 PFLOPS AI 컴퓨트, 그리고 파트너사들의 공격적인 가격 정책으로, Hot Chips 2025 발표는 AI 하드웨어 단일 벤더 독점 시대가 끝나가고 있음을 시사합니다. 다음 GPU 조달 사이클을 평가하는 데이터센터 운영자라면, MI350은 반드시 검토 대상에 포함시켜야 합니다.

AMD가 이러한 약속을 대규모로 이행할 수 있을지 — 그리고 ROCm 7이 CUDA와의 소프트웨어 생태계 격차를 좁힐 수 있을지 — 이 인상적인 스펙이 실제 채택으로 이어질지를 결정할 것입니다. 하지만 한 가지는 확실합니다: Hot Chips 2025가 AI 가속기 경쟁을 훨씬 더 흥미롭게 만들었다는 것입니다.

매주 AI, 음악, 테크 트렌드를 이메일로 받아보세요.