침실 프로듀서 프로 전환: 2026년 현실적인 커리어 로드맵 7단계

3월 9, 2026

2026년 3월 최고의 샘플 팩 추천: 드럼 킷, 루프, 원샷 총정리

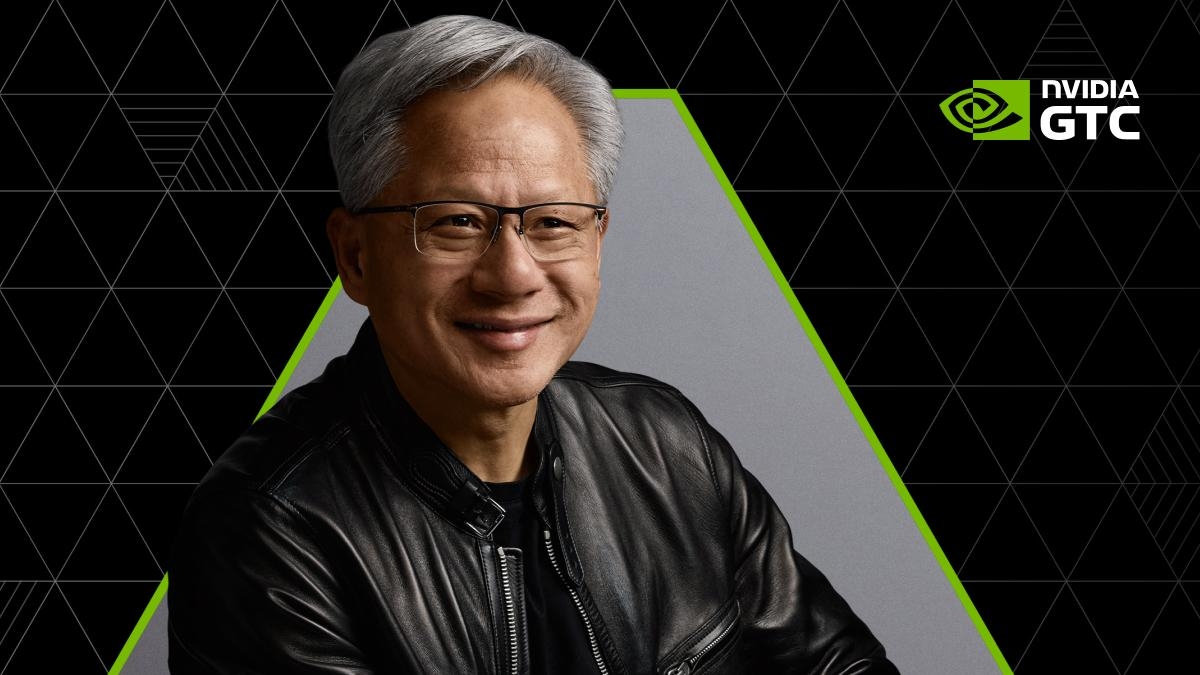

3월 10, 2026GDC 2026 둘째 날, 이미 폭탄급 발표들이 쏟아지고 있습니다. AI 개발자 컨퍼런스 2026 시즌이 본격적으로 시작된 지금, 마이크로소프트는 DirectX에 머신러닝을 직접 통합하겠다고 선언했고, 텐센트는 텍스트 한 줄로 3D 에셋을 생성하는 엔진을 공개했습니다. 그리고 일주일 후에는 젠슨 황이 GTC 2026 키노트 무대에 오릅니다.

음악과 오디오 업계에서 28년을 보낸 저도, 이번 3월만큼 AI가 모든 크리에이티브 산업을 동시에 흔드는 시기는 처음 봅니다. GDC에서는 게임 개발의 패러다임이 바뀌고 있고, 다음 주 GTC에서는 AI 인프라의 미래가 공개됩니다. 지금 이 순간 무슨 일이 벌어지고 있는지, 그리고 다음 주에 무엇을 기대해야 하는지 정리했습니다.

GDC 2026 현장: AI 개발자 컨퍼런스 2026의 핵심 발표들

샌프란시스코 모스코니 센터에서 3월 9일부터 13일까지 열리는 GDC 2026은 올해 유난히 AI 세션이 많습니다. 현장에서 가장 주목받는 발표들을 살펴보겠습니다.

마이크로소프트 DirectX ML: GPU에서 직접 돌아가는 머신러닝

마이크로소프트가 GDC에서 공개한 DirectX ML 업그레이드는 게임 그래픽의 미래를 바꿀 수 있는 발표입니다. Shader Model 6.9에 Cooperative Vectors를 도입하고, DirectX Linear Algebra로 그래픽 파이프라인 안에서 직접 ML 워크로드를 처리할 수 있게 됩니다. Compute Graph Compiler는 GPU 위에서 네이티브 ML 모델을 실행하는 것을 가능하게 하며, 올여름에는 DXR 2.0 프리뷰도 예정되어 있습니다.

이것이 왜 중요할까요? 지금까지 게임 내 AI 추론은 별도의 파이프라인을 거쳐야 했습니다. 이제 렌더링 파이프라인 자체에 ML이 녹아들면, 뉴럴 렌더링이 실시간으로 가능해집니다. 오디오 쪽에서도 이런 접근이 확산되면, 실시간 공간 오디오 처리에 GPU ML을 활용하는 시대가 올 것입니다.

텐센트 AI Summit: HY 3D 엔진과 멀티 에이전트 시스템

텐센트 게임즈는 GDC 기간 중 3월 10일 AI Summit을 개최하며 HY 3D AI 크리에이션 엔진을 공개했습니다. 텍스트, 이미지, 스케치 입력만으로 3D 에셋을 자동 생성하는 이 엔진은 멀티 에이전트 씬 레이아웃 추론 기능까지 갖추고 있습니다. 20개 이상의 세션이 AI 기반 개발 도구를 다루며, 대형 스튜디오들이 실제 프로덕션에서 AI를 어떻게 활용하는지 공유합니다.

Unity도 AI Gateway에 MCP(Model Context Protocol) 통합을 발표하면서, 에이전틱 워크플로우가 게임 엔진 안으로 들어오는 흐름이 가속화되고 있습니다. 개발자가 자연어로 게임 로직을 설계하고, AI 에이전트가 레벨 디자인을 제안하는 시대가 눈앞에 와 있습니다.

GDC 2026 업계 설문: 개발자들의 AI에 대한 복잡한 시선

흥미로운 것은 GDC의 State of the Game Industry 설문 결과입니다. 2,300명 이상의 개발자를 대상으로 한 조사에서 52%가 생성형 AI가 부정적 영향을 미친다고 답했습니다. 작년 30%에서 크게 증가한 수치입니다. 동시에 36%는 이미 업무에 AI 도구를 사용하고 있으며, ChatGPT가 74%로 가장 많이 사용되고 있습니다. 81%는 리서치와 브레인스토밍에 AI를 활용한다고 답했고, 비주얼 아티스트 중 64%가 가장 강하게 반대 의견을 보였습니다.

이 데이터가 보여주는 것은 명확합니다. AI는 이미 현장에 깊숙이 들어와 있지만, 크리에이터들의 우려도 동시에 커지고 있다는 것입니다. 도구의 편리함과 창작의 가치 사이에서 업계가 균형점을 찾아가는 과정입니다.

NVIDIA GTC 2026 프리뷰: 다음 주가 진짜 본게임

GDC가 게임 개발에서의 AI를 보여줬다면, 다음 주 3월 16일부터 19일까지 산호세에서 열리는 NVIDIA GTC 2026은 AI 산업 전체의 방향을 제시할 것입니다. 젠슨 황 CEO가 3월 16일 SAP Center에서 키노트를 진행하며, 190개국에서 3만 명 이상의 참석자가 700개 이상의 세션에 참여할 예정입니다.

이번 GTC의 확인된 연사 라인업이 강력합니다. Perplexity CEO 아라빈드 스리니바스, LangChain CEO 해리슨 체이스, Mistral AI CEO 아서 멘쉬 등 AI 업계의 핵심 인물들이 총출동합니다. 에이전틱 AI, 피지컬 AI, AI 팩토리가 핵심 주제로 예고되어 있으며, 새로운 GPU 아키텍처나 AI 인프라 관련 발표가 나올 가능성이 높습니다.

왜 이번 AI 개발자 컨퍼런스 2026 시즌이 특별한가

GDC와 GTC가 같은 달에 열리는 것은 처음이 아니지만, 올해처럼 두 컨퍼런스 모두 AI를 핵심 축으로 삼은 것은 전례가 없습니다. GDC에서는 AI가 실제 게임 개발 파이프라인에 어떻게 통합되는지 보여주고, GTC에서는 그 AI를 구동하는 하드웨어와 플랫폼의 미래를 제시합니다. 이 두 컨퍼런스를 연결해서 보면, AI 기술이 연구 단계를 넘어 프로덕션 도구로 자리잡고 있다는 것이 선명하게 드러납니다.

특히 주목해야 할 트렌드는 세 가지입니다. 첫째, GPU 네이티브 ML의 확산입니다. 마이크로소프트의 DirectX ML이 보여주듯, ML이 별도 레이어가 아니라 렌더링 파이프라인의 일부가 되고 있습니다. 둘째, 에이전틱 워크플로우의 실용화입니다. Unity의 MCP 통합과 텐센트의 멀티 에이전트 시스템은 AI 에이전트가 개발 도구 안에서 작동하는 현실을 보여줍니다. 셋째, 크리에이터 커뮤니티의 양면적 반응입니다. 52%가 부정적이라고 답하면서도 36%가 이미 사용 중인 이 모순은, 기술 전환기의 전형적인 모습입니다.

앞으로 주목해야 할 것들

GDC는 이번 주 금요일(3월 13일)까지 계속됩니다. 남은 세션 중에서도 NVIDIA의 AI 비디오 생성 도구 세션과 대형 스튜디오들의 AI 파이프라인 사례 발표가 기대됩니다. 그리고 다음 주 월요일(3월 16일) 젠슨 황의 GTC 키노트에서는 새로운 AI 하드웨어와 소프트웨어 플랫폼이 공개될 가능성이 높습니다.

크리에이티브 산업 종사자로서 이 컨퍼런스들에서 주목해야 할 핵심은 하나입니다. AI가 도구로서 실제 워크플로우에 녹아드는 속도입니다. 음악이든, 게임이든, 영상이든 — 단순한 데모가 아니라 실제 프로덕션에 투입 가능한 AI 도구들이 매달 쏟아지고 있습니다. 이 흐름을 읽고 자신의 분야에 적용하는 것이 2026년의 경쟁력이 될 것입니다.

GTC 2026에서 주목해야 할 핵심 기술 트렌드

젠슨 황의 3월 17일 키노트는 2027년까지 AI 개발 방향을 제시할 것으로 예상됩니다. 사전 개발자 세션 자료를 분석한 결과, 세 가지 주요 테마가 부각될 것 같습니다: 자율 에이전트 오케스트레이션, 대규모 멀티모달 추론, 그리고 NVIDIA가 “추론 우선” 하드웨어 설계라고 부르는 새로운 접근법입니다.

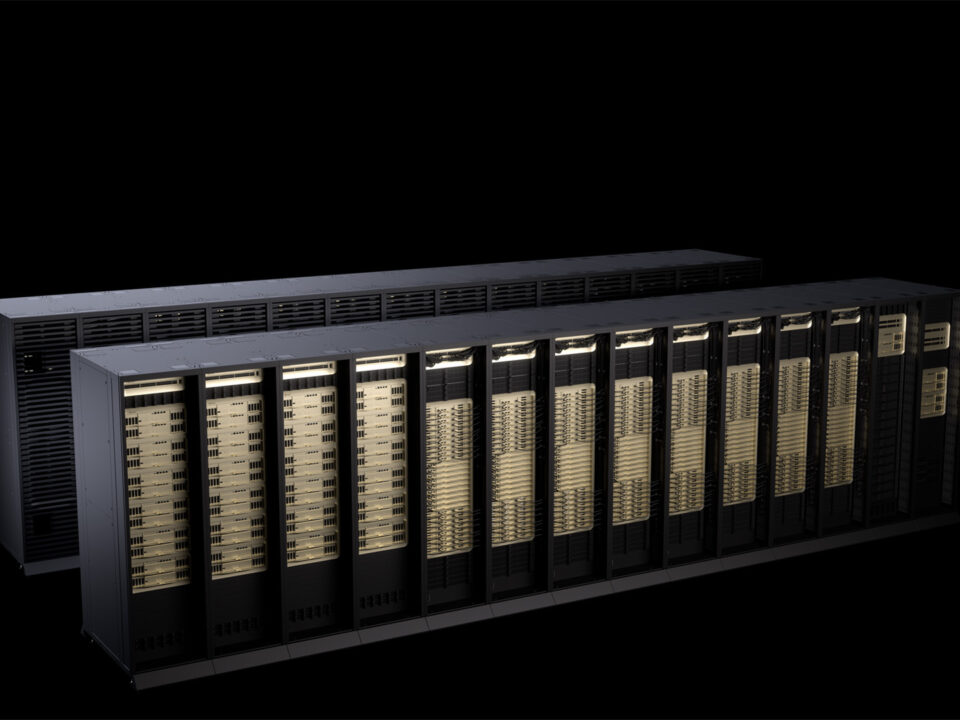

타이밍이 우연은 아닙니다. 마이크로소프트가 DirectX에 ML을 직접 임베드하고 텐센트가 프로덕션 준비된 멀티 에이전트 워크플로우를 시연하는 상황에서, 업계는 이런 새로운 패러다임을 스케일에서 지원할 수 있는 인프라가 필요합니다. NVIDIA의 H200과 B100 아키텍처는 학습, 추론, 실시간 상호작용 처리를 동시에 수행하는 혼합 워크로드에 특화되어 최적화되었습니다.

멀티 에이전트 시스템의 실제 구현 패턴

GTC 개발자 세션에서 공개되는 내용을 보면, 스튜디오들이 실제로 멀티 에이전트 시스템을 어떻게 배포하는지 흥미로운 세부사항들이 드러납니다. Epic Games의 Unreal Engine 팀은 AI 에이전트들이 레벨 디자인, 조명 최적화, 에셋 배치와 같은 복잡한 작업을 동시에 조율할 수 있게 하는 Agent Communication Protocol(ACP)을 시연할 예정입니다.

- 에이전트 전문화는 모놀리식 AI 시스템 대비 40-60% 연산 오버헤드를 줄입니다

- 메시지 패싱 아키텍처가 공유 메모리 방식보다 예측 가능하게 스케일됩니다

- Human-in-the-loop 개입은 에이전트가 추론 과정을 설명할 수 있을 때 가장 효과적입니다

성능 벤치마크와 현실적 한계점

마케팅 헤드라인을 넘어서 실제 성능이 관건입니다. 마이크로소프트의 DirectX ML 통합은 통제된 데모에서 인상적인 수치를 보여주지만, 실제 배포에서는 다른 이야기입니다. 독립 개발자들의 초기 테스트에 따르면, ML 추론이 전통적인 렌더링과 동시에 실행될 때 모델 복잡도와 목표 프레임레이트에 따라 15-25%의 성능 오버헤드가 발생합니다.

텐센트의 HY 3D 엔진은 인상적인 에셋을 생성하지만, 생성 시간은 여전히 단순한 객체의 경우 45초부터 복잡한 건축 요소의 경우 8-12분까지 소요됩니다. 반복적인 디자인 워크플로우에는 충분히 빠르지만 실시간 창작 탐구에는 아직 부족합니다. 멀티 에이전트 씬 추론은 정말 인상적입니다 – 세 개의 AI 에이전트가 협력하여 중세 타운 스퀘어를 디자인하는 데모를 봤는데, 하나는 건축을, 다른 하나는 조명과 분위기를, 세 번째는 성능과 폴리곤 수 최적화를 담당했습니다.

오디오 산업에 미치는 파급효과와 전망

28년간 음악 기술 분야에서 일하면서, 이번 AI 컨퍼런스들이 오디오 산업에 미칠 영향을 예측해봅니다. DirectX ML의 GPU 네이티브 처리는 실시간 공간 오디오에서 획기적인 변화를 가져올 것입니다. 지금까지 CPU에서 처리하던 복잡한 convolution reverb나 HRTF 계산을 GPU에서 ML 가속화하면, 수백 개의 동시 음원을 실시간으로 처리할 수 있게 됩니다.

텐센트의 멀티 에이전트 접근법도 음악 제작에 직접 적용 가능합니다. 하나의 에이전트는 화성 진행을, 다른 하나는 리듬 패턴을, 세 번째는 음색과 사운드 디자인을 담당하는 협업형 작곡 시스템을 상상해보십시오. DAW 환경에서 이런 에이전트들이 실시간으로 소통하며 음악을 만들어가는 시대가 곧 올 것입니다.

GTC 2026이 크리에이티브 산업에 미칠 파장

젠슨 황의 3월 16일 키노트는 통상적으로 향후 18개월간 GPU 컴퓨팅의 기술 로드맵을 제시합니다. 세션 제목과 개발자 프리뷰를 종합해보면, 올해는 NVIDIA가 “Omniverse Agents”라고 부르는 멀티 애플리케이션 AI 시스템이 핵심이 될 것으로 보입니다.

오디오 전문가들에게는 특히 흥미로운 변화입니다. 현재 AIVA나 Boomy 같은 AI 오디오 도구들은 독립적으로 작동하며, 프로덕션 단계마다 수동으로 익스포트와 임포트를 반복해야 합니다. 하지만 NVIDIA의 멀티 애플리케이션 에이전트 아키텍처가 약속을 지킨다면, DAW에서의 초기 작곡부터 최종 마스터링과 배포까지 전체 창작 워크플로우를 이해하는 AI 어시스턴트를 볼 수 있을 것입니다.

예상되는 하드웨어 발표와 성능 영향

업계 소식통들에 따르면 NVIDIA는 전용 AI 추론 코어를 탑재한 RTX 5090 Ti를 발표할 것으로 보이며, 현재 RTX 4090 대비 2.5배의 ML 성능을 제공할 예정입니다. 개발자들에게 더 중요한 것은 소문으로 들리는 “Grace Hopper Studio” 워크스테이션으로, 데이터센터급 AI 성능을 개별 크리에이터에게 제공할 수 있습니다. 128GB 통합 메모리와 최대 700억 파라미터 모델에 대한 네이티브 지원을 말입니다.

기술적 심화 분석: AI 변화를 이끄는 인프라 혁신

두 컨퍼런스의 진짜 이야기는 화려한 데모가 아니라, 표면 아래에서 일어나는 근본적인 인프라 변화입니다. 세 가지 기술적 변화가 수렴하며 AI 네이티브 창작 도구의 새로운 세대를 가능하게 하고 있습니다.

메모리 아키텍처와 대역폭 개선

마이크로소프트의 DirectX ML 구현은 “Cooperative Vectors”라는 공유 메모리 풀에 크게 의존합니다. 이는 AI 모델과 전통적인 그래픽스 셰이더가 동일한 데이터에서 동시에 작업할 수 있게 해줍니다. 이전까지 AI 처리와 실시간 렌더링 사이에 병목을 만들었던 메모리 복사를 제거하는 것입니다.

- 현재 RTX 4090: 1008 GB/s 메모리 대역폭, 컴퓨트와 그래픽스용 분리된 풀

- 소문의 RTX 5090 Ti: 1500+ GB/s와 통합 메모리 아키텍처

- Grace Hopper Studio: 3200 GB/s와 CPU/GPU 메모리 일관성

실질적으로는 프로페셔널 샘플 레이트와 버퍼 크기에서 AI 지원 실시간 오디오 처리가 현실적이 된다는 의미입니다. 현재 AI 오디오 플러그인들은 드롭아웃을 피하기 위해 512나 1024 샘플 버퍼가 필요한 경우가 많습니다. 통합 메모리 아키텍처에서는 뉴럴 처리에서도 64 샘플 버퍼가 현실적이 됩니다. 이는 AI를 창작 브레인스토밍 도구에서 퍼포먼스 악기로 변화시키는 차이입니다.

AI 기반 워크플로우 구축이나 크리에이티브 파이프라인 자동화에 관심이 있으시다면, 28년 경력의 실전 경험을 바탕으로 상담해 드립니다.