Waldorf Attack 3 리뷰: 25년 역사의 드럼 신디사이저가 FM 합성과 24보이스 폴리포니로 €99에 부활

3월 16, 2026

Django 6.0 내장 Tasks 프레임워크: Celery 없이 백그라운드 작업을 처리하는 최초의 방법

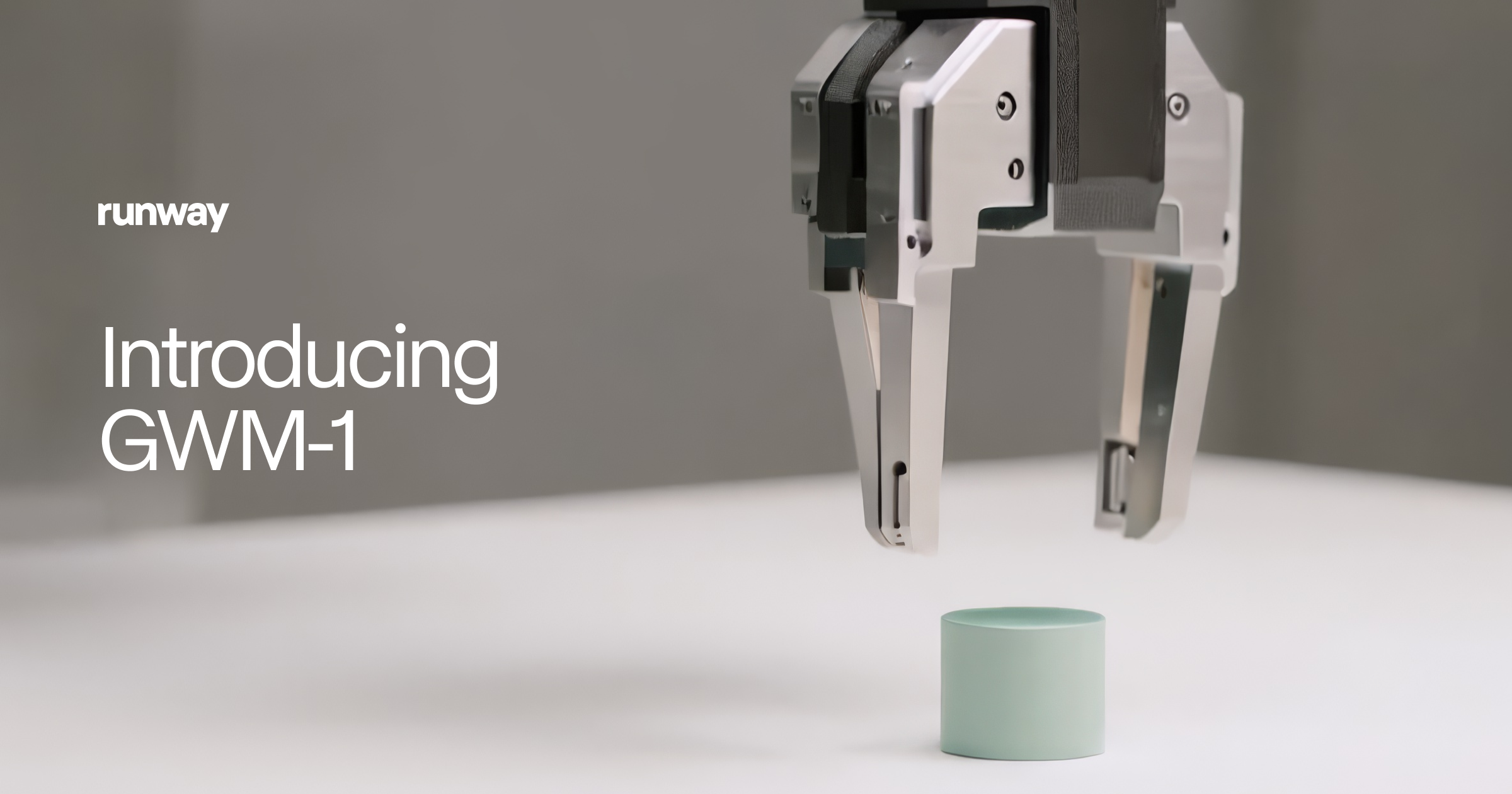

3월 16, 202610초짜리 AI 영상 클립은 이제 옛날이야기입니다. Runway가 업계 전체를 뛰어넘었습니다. 새로 공개된 Runway GWM-1 월드 모델은 단순히 영상을 생성하는 것이 아니라, 직접 걸어 다닐 수 있고, 대화할 수 있으며, 로봇을 훈련시킬 수 있는 현실 자체를 시뮬레이션합니다 — 그것도 24fps 실시간으로.

General World Model이란 정확히 무엇인가?

월드 모델(World Model)은 환경의 내부 표현을 구축한 뒤, 그 표현을 활용하여 다음에 일어날 상황을 시뮬레이션하는 AI 시스템입니다. 사진을 찍는 것과 살아 움직이는 방을 만드는 것의 차이라고 생각하시면 됩니다. 언어 모델이 다음 단어를 예측하고, 영상 모델이 다음 프레임을 예측한다면, Runway GWM-1 월드 모델은 전체 환경의 다음 상태를 예측합니다 — 기하학, 조명, 물리법칙, 사운드까지 전부.

GWM-1은 Runway의 Gen-4.5를 기반으로 구축된 자기회귀 모델입니다. 프레임 단위로 생성하며, 720p/24fps 실시간으로 구동됩니다. 카메라 이동, 로봇 명령, 오디오 입력을 통해 인터랙티브하게 제어할 수 있으며, 최대 2분까지 일관된 물리법칙을 유지합니다.

세 가지 변형, 세 가지 혁명

Runway는 하나의 모델이 아닌, GWM-1 우산 아래 세 가지 특화 변형을 동시에 출시했습니다. 각각 인터랙티브 AI의 서로 다른 최전선을 겨냥합니다.

GWM Worlds: 이미지 한 장으로 탐색 가능한 3D 환경 생성

GWM Worlds에 정적 이미지를 하나 넘기면 — 사진이든, 컨셉 아트든, 렌더링 프레임이든 — 그 주위로 무한히 탐색 가능한 3D 공간을 실시간으로 생성합니다. 카메라를 이동하면 새로운 기하학, 조명, 환경 디테일이 즉석에서 만들어집니다. 공간 일관성이 뛰어나서 물체가 제자리를 유지하고, 그림자가 정확하게 작동하며, 오랜 탐색 세션에서도 물리법칙이 무너지지 않습니다.

게임, VR, 건축 시각화, 교육 시뮬레이션에 미치는 영향은 막대합니다. 컨셉 아트 한 장을 게임 엔진에 넘기면 몇 초 만에 완전히 탐색 가능한 레벨이 돌아오는 미래를 상상해보십시오.

GWM Avatars: 포토리얼 대화형 캐릭터

GWM Avatars는 오디오 기반 인터랙티브 영상 생성 모델입니다. 오디오와 캐릭터 참조를 입력하면 정확한 립싱크, 자연스러운 눈 움직임, 실감나는 표정, 맥락에 맞는 제스처를 갖춘 포토리얼(또는 스타일화된) 토킹 헤드를 생성합니다. 말하는 상태뿐 아니라 듣는 상태도 자연스럽게 처리하며, 장시간 대화에서도 품질 저하가 없습니다.

콘텐츠 크리에이터에게는 값비싼 모션 캡처나 스튜디오 시간 없이도 생생한 AI 진행자, 설명 캐릭터, 가상 프레젠터를 만들 수 있다는 의미입니다. Runway는 곧 웹 제품과 API에 GWM Avatars를 통합할 계획입니다.

GWM Robotics: 물리적 AI를 위한 합성 훈련 데이터

가장 혁신적인 변형입니다. GWM Robotics는 로봇 동작에 조건화된 합성 영상을 생성하여, 물리적 하드웨어 없이 로봇이 훈련할 수 있는 가상 물리 샌드박스를 제공합니다. 반사실적 생성(counterfactual generation)도 지원하여 “로봇이 왼쪽으로 돌았다면?”이라는 가정에 대한 그럴듯한 영상 롤아웃을 받아볼 수 있습니다.

Runway는 Python SDK를 제공하여 로보틱스 연구자와 엔지니어의 접근성을 높였습니다. 물리적 테스트 환경은 비싸고, 느리며, 제한적인데 — 로봇 훈련 데이터 수집 비용과 시간을 획기적으로 줄일 수 있는 잠재력이 대단합니다.

Gen-4.5와의 관계

GWM-1은 독립적으로 존재하지 않습니다. Gen-4.5 위에 직접 구축되었으며, Gen-4.5 자체도 GWM-1 출시와 함께 대폭 업그레이드되었습니다. 네이티브 오디오 생성 및 편집, 멀티샷 영상 편집 기능이 추가되어 한 장면에 적용한 변경사항이 전체 영상에 일관되게 전파됩니다.

경쟁 구도가 뜨거워지고 있습니다

Runway만 월드 모델에 도전하는 것은 아닙니다. Google DeepMind, Fei-Fei Li의 World Labs(2억 3천만 달러 투자 유치), Decart, Tencent, Spaitial, Etched, 그리고 Yann LeCun의 새로운 벤처까지 — 업계 리더들은 월드 모델을 언어 모델 너머 범용 인공지능(AGI)으로 가는 핵심 단계로 보고 있습니다.

Runway의 차별점은 통합적 접근입니다. 공통 아키텍처를 공유하는 세 가지 특화 변형을 제공하면서, 이를 단일 범용 모델로 통합하는 명확한 로드맵을 갖추고 있습니다.

누가 관심을 가져야 하는가?

- 게임 개발자와 VR 크리에이터 — GWM Worlds가 환경 프로토타이핑과 절차적 생성을 극적으로 가속화할 수 있습니다

- 콘텐츠 크리에이터와 마케터 — GWM Avatars로 고비용 모션 캡처 없이 생생한 AI 프레젠터를 제작할 수 있습니다

- 로보틱스 엔지니어 — GWM Robotics가 저렴하고 빠른 물리 인식 합성 훈련 데이터를 제공합니다

- AI 연구자 — 영상 생성에서 인터랙티브 월드 시뮬레이션으로의 실현 가능한 경로를 보여줍니다

- 기업 팀 — 디지털 트윈, 훈련 시뮬레이션, 가상 프로토타이핑이 한층 접근 가능해집니다

출시 현황과 접근 방법

GWM-1은 2025년 12월 11일에 출시되었습니다. 현재 Runway 웹사이트의 조기 접근 신청 폼을 통해 이용할 수 있습니다. GWM Avatars는 웹 제품과 API 통합이 예정되어 있고, GWM Robotics는 자격을 갖춘 사용자에게 Python SDK를 제공합니다. 파인튜닝 접근에는 별도 신청이 필요합니다.

결론

GWM-1은 AI 영상 도구가 할 수 있는 일의 근본적 전환점입니다. “클립 생성”에서 “세계 시뮬레이션”으로 넘어가고 있습니다. 환경, 캐릭터, 로보틱스를 아우르는 세 가지 변형 접근법은 가장 상업적 가치가 높은 영역을 커버하면서, 궁극적으로 셋을 하나로 통합하는 모델을 향해 나아갑니다. 디지털 환경, 가상 캐릭터, 로봇 훈련 파이프라인에 관련된 일을 하고 계시다면, 경쟁이 치열해지기 전에 지금 조기 접근을 신청할 가치가 있습니다.

GWM-1 같은 AI 도구를 크리에이티브 또는 기술 워크플로우에 통합하는 방법이 궁금하시다면, Sean Kim이 도와드리겠습니다.