AI 마스터링 LANDR eMastered CloudBounce 비교 2025: 하나가 죽었다 — 남은 승자는?

4월 24, 2025

패러렐 컴프레션 드럼 프로세싱: 펀치감 넘치는 믹스를 위한 완벽 가이드

4월 25, 2025한 달 만에 클라우드 GPU 가격이 26% 뛰었습니다. NVIDIA H200 클라우드 GPU 가용성이 급격히 확대되어 28개 이상 제공업체가 HBM3e 인스턴스를 제공하고 있지만, 정작 시간당 평균 비용은 $2.97에서 $3.73으로 급등했습니다. GPU 부족 사태가 끝난 게 아니라 형태가 바뀌고 있는 것입니다.

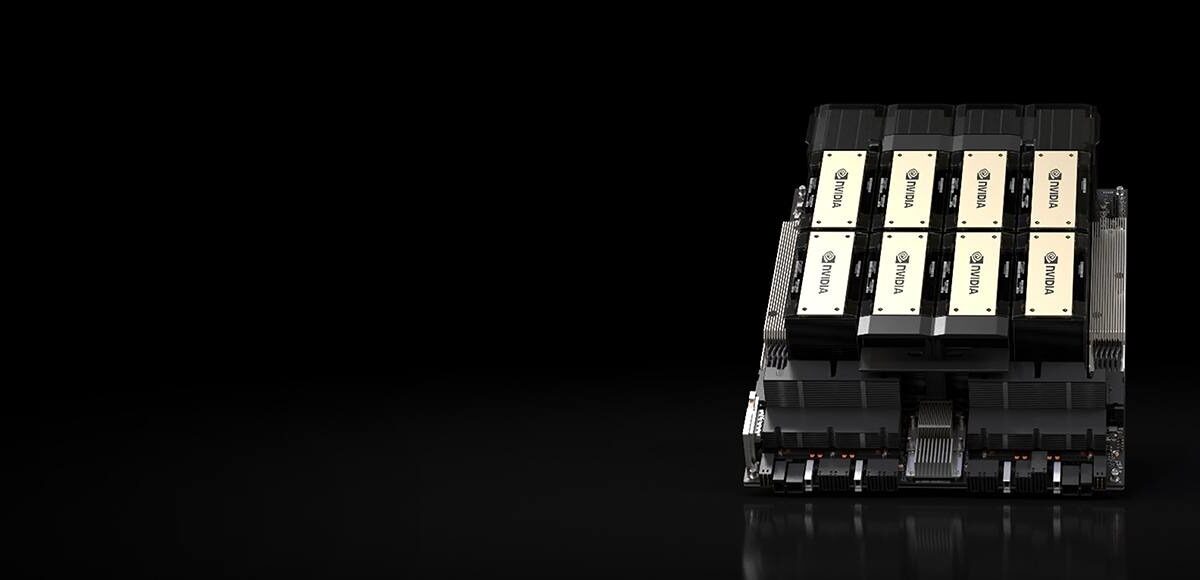

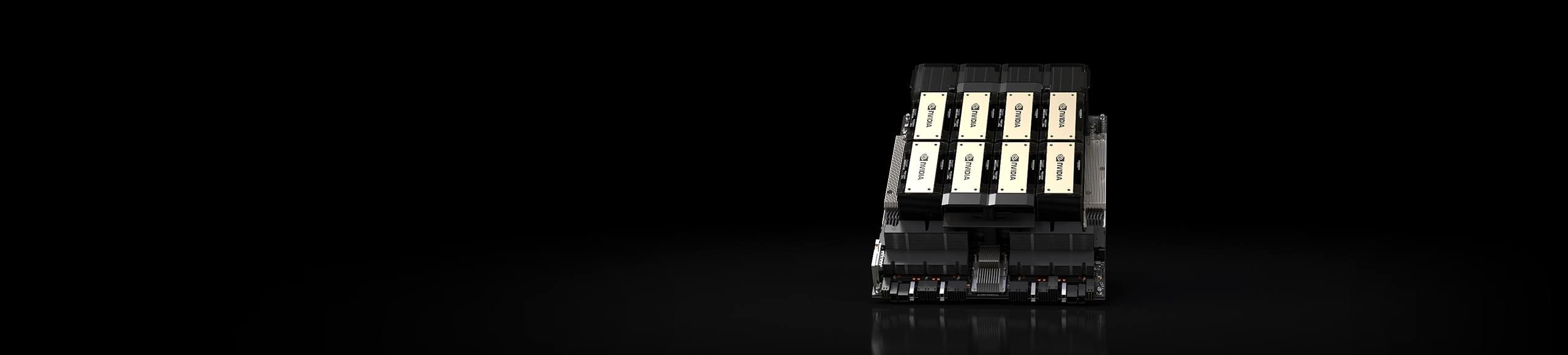

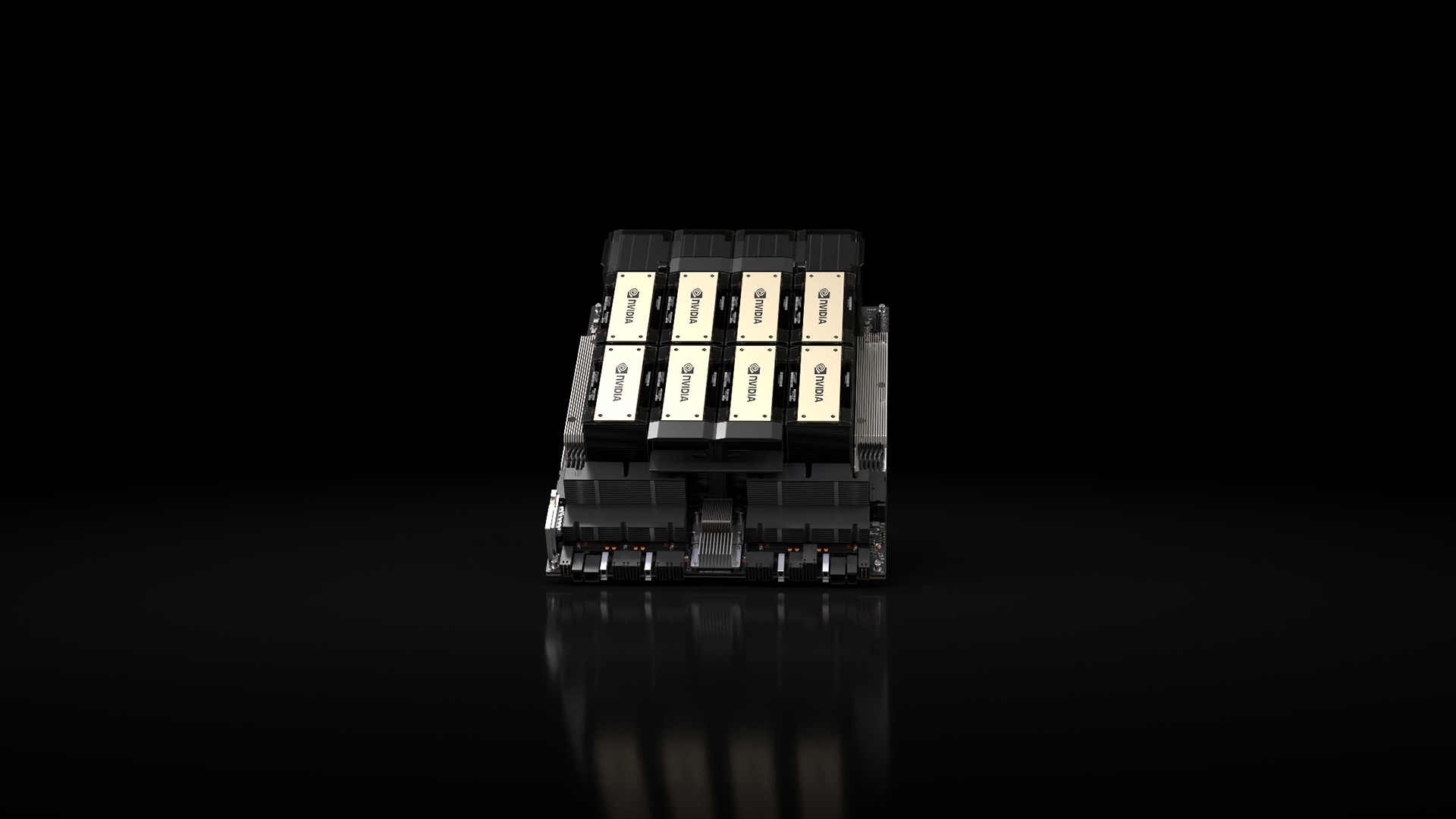

NVIDIA H200 클라우드 GPU: 왜 주목해야 하는가

NVIDIA H200은 Hopper 아키텍처 기반으로, 전작 H100 대비 메모리 성능이 대폭 향상된 GPU입니다. H100이 80GB HBM3(3.35TB/s 대역폭)을 탑재한 반면, H200은 141GB HBM3e(4.8TB/s 대역폭)를 장착했습니다. 메모리 용량이 거의 2배, 대역폭은 43% 향상된 수치입니다.

NVIDIA 공식 벤치마크에 따르면, H200은 Llama 2 70B 모델 추론에서 H100 대비 1.9배, GPT-3 175B 추론에서 1.6배 빠른 성능을 보여줍니다. 8-way HGX H200 시스템은 FP8 기준 32+ PFLOPS를 달성하며, 총 1.1TB의 HBM 메모리를 제공합니다. 이전에는 멀티 노드 구성이 필요했던 모델을 단일 서버에서 구동할 수 있게 된 것입니다.

클라우드 배포 관점에서 핵심 사양을 정리하면 다음과 같습니다:

- 컴퓨팅: 4 PFLOPS FP8 텐서 코어 성능 (H100과 동일한 연산력에 메모리 우위)

- 전력: SXM 폼팩터 기준 700W TDP

- 구성: HGX(4/8 GPU), MGX NVL(최대 8 GPU), GH200 Grace Hopper Superchip

클라우드 가용성: 28개 이상 제공업체 현황

2025년 2분기에 가장 눈에 띄는 변화는 H200 인스턴스를 제공하는 업체 수입니다. 클라우드 GPU 가격 비교 데이터에 따르면, 28개 이상의 제공업체가 H200 인스턴스를 리스팅하고 있습니다. 2024년 말 소수의 얼리 액세스 파트너만 있던 것과 비교하면 극적인 확장입니다.

하이퍼스케일러 제공 현황

주요 클라우드 플랫폼들은 H200을 GPU 인스턴스 라인업에 통합했습니다:

- AWS: p5e.48xlarge, p5en.48xlarge 인스턴스 (8x H200 GPU)

- Google Cloud: a3-ultragpu-8g 인스턴스 (8x H200 + 고대역 네트워킹)

- Microsoft Azure: H200 기반 ND 시리즈 인스턴스 정식 출시

- Oracle Cloud: BM.GPU.H200.8 베어메탈 인스턴스

전문 GPU 클라우드 제공업체

더 흥미로운 부분은 전문 GPU 클라우드 업체들입니다. CoreWeave, Lambda, RunPod, Nebius AI Cloud, GMI Cloud, Hyperstack, Genesis Cloud, Jarvislabs 등이 하이퍼스케일러 대비 30-60% 저렴한 가격에 H200 인스턴스를 제공하고 있습니다. CoreWeave의 8x H200 구성은 시간당 약 $50.44, Jarvislabs는 GPU당 시간당 약 $3.80부터 시작합니다.

NVIDIA H200 클라우드 GPU 가격: 26% 급등의 원인

H200 인스턴스의 온디맨드 가격은 현재 GPU당 시간당 $3.72에서 $10.60 사이입니다. 2025년 3월 이후 평균 온디맨드 가격이 약 26% 상승하여 $2.97/hr에서 $3.73/hr로 올랐습니다. 단 한 달 만의 상당한 인상입니다.

이 가격 상승을 주도하는 요인들이 있습니다:

- 수요 급증: H200 수요가 분기 대비 약 40% 증가하며 공급 확장 속도를 추월

- Blackwell 전환 불확실성: B200/B300 가용성을 기다리는 동안 H200을 안정적 브리지로 확보하려는 수요

- AI 추론 스케일링: 학습 중심에서 추론 중심 워크로드로의 전환이 H200의 메모리 이점을 부각

- 예약 인스턴스 유도: 제공업체들이 온디맨드 요금을 올려 장기 약정 계약을 유도

예산을 계획하는 팀이라면 대략적인 가격 구조를 알아둘 필요가 있습니다. 하이퍼스케일러는 GPU당 시간당 $6-$10 이상(예약 할인 20-40%), 전문 제공업체는 $3.72-$5.50(더 유연한 약정 조건)으로 가격이 형성되어 있습니다.

H200 vs H100: 업그레이드가 실질적으로 의미 있는 경우

H200은 만능 업그레이드가 아닙니다. 컴퓨팅 성능 자체는 H100과 동일한 4 PFLOPS FP8입니다. H200이 진가를 발휘하는 것은 메모리 바운드 워크로드입니다:

- LLM 추론: Llama 2 70B에서 1.9배, GPT-3 175B에서 1.6배 빠른 성능 — 141GB HBM3e가 대형 모델의 메모리 병목을 해소

- 대형 트랜스포머 학습: 메모리 스왑 감소로 최대 1.4배 빠른 학습 속도

- 멀티 모델 서빙: 141GB 용량으로 여러 모델을 GPU 분할 없이 동시 서빙 가능

- RAG 파이프라인: 더 큰 임베딩 캐시를 GPU 메모리에 완전 적재, 검색 증강 생성의 레이턴시 감소

80GB 미만 메모리 요구 사항의 학습이나 이미지 생성처럼 메모리 벽에 부딪히지 않는 컴퓨팅 바운드 작업이라면, H100 인스턴스가 여전히 비용 대비 효율적입니다. H200의 프리미엄은 실제로 메모리 대역폭이나 용량에 병목이 걸릴 때만 가치가 있습니다.

공급망 현실 점검: 2025년 2분기와 그 이후

가용성이 개선되었음에도 H200 공급망은 여전히 제약 상태입니다. 업계 보고에 따르면 리드 타임은 주문량과 채널에 따라 8-20주로 나타납니다.

HBM3e 생산 능력: Samsung과 SK hynix가 H200 하나당 6개의 HBM3e 스택을 공급합니다. HBM3e 수요는 NVIDIA뿐 아니라 경쟁 AI 가속기 전반에서 예상을 초과하고 있으며, 이 메모리 병목이 H200 생산의 주요 제약 요인입니다.

중국 변수: Tom’s Hardware 보도에 따르면, NVIDIA는 약 82,000개의 H200 GPU를 중국에 출하할 준비를 하고 있습니다. 5,000-10,000개 칩 모듈(40,000-80,000개 개별 칩)에 해당하며, 25% 관세가 부과됩니다. Q2에 새로운 생산 능력 주문도 개시됩니다.

업계 분석에 따르면, NVIDIA의 하이엔드 GPU 출하량은 2025년 전년 대비 55% 성장이 전망됩니다. 그러나 상당 부분은 Blackwell 중심 성장입니다. NVIDIA는 Blackwell이 더 높은 평균 판매 가격을 확보하므로 H 시리즈 웨이퍼 투입을 늘릴 가능성이 낮습니다.

TrendForce에 따르면 H200 주문은 2024년 Q3부터 출하가 시작되었으며, 하이퍼스케일러의 강한 수요가 공급망에 모멘텀을 제공하고 있습니다. 서버 OEM들이 생산 능력을 확대하고 있지만, 지속적인 수요 증가와 HBM3e 제약이 결합되어 스팟 가용성은 여전히 불안정합니다.

Blackwell 브리지: H200 수요가 강세를 유지하는 이유

2025년 2분기의 흥미로운 역학 중 하나는 H200의 브리지 GPU로서의 역할입니다. 차세대 Blackwell B200과 B300이 있지만, 램프업은 아직 초기 단계입니다. 프로덕션 추론, 파인튜닝, 기존 AI 서비스 확장을 위해 지금 당장 GPU 용량이 필요한 조직은 Blackwell 가용성이 성숙할 때까지 6-12개월을 기다릴 수 없습니다.

이것은 H200에 대한 자기 강화적 수요 순환을 만들어냅니다. 기업들은 오늘 H200 인스턴스를 확보하고, 그 위에 인프라를 구축하며, Blackwell이 비용 효율적이 될 때 마이그레이션을 계획합니다. 결과적으로 차세대가 다가오고 있음에도 H200 수요는 지속됩니다 — 가용성 확대에도 불구하고 가격이 오르는 이유가 바로 이것입니다.

Sean’s Take: AI 인프라를 계획하는 팀이 놓치고 있는 것

CUDA 컴퓨팅 붐부터 크립토 수급 대란, 그리고 현재의 AI 골드러시까지 GPU 인프라 사이클을 수년간 지켜봐 오면서, 대부분의 팀이 놓치고 있는 패턴이 보입니다. H200 공급 확대는 진전처럼 느껴지고, 절대적 기준으로는 맞습니다. 하지만 한 달 만에 26%라는 가격 인상이 시장의 실제 상태를 말해줍니다 — 수요가 공급보다 빠르게 성장하고 있다는 것입니다.

프로덕션 AI 시스템을 구축하는 팀에 대한 실질적 조언은 이렇습니다: 가격 하락을 기다리지 마십시오. Blackwell 전환이 결국 H200에서 수요를 전환할 것이지만, 그것은 빨라야 2025년 Q4 또는 2026년 Q1의 이야기입니다. 지금 추론 용량이 필요하다면, 비용 차이가 상당한 전문 제공업체에서 예약 가격을 확보하십시오. 하이퍼스케일러 대비 30-60% 절감이 수개월의 프로덕션 워크로드에 걸쳐 복리되면 상당한 금액이 됩니다.

더 흥미로운 질문은 아키텍처적 관점입니다. H200의 141GB HBM3e는 기존 워크로드를 빠르게 하는 것만이 아니라, H100에서는 실용적이지 않았던 워크로드를 가능하게 합니다. 양자화 타협 없이 단일 GPU에서 70B 파라미터 모델 추론 실행, 하나의 인스턴스에서 여러 전문 모델 서빙, RAG를 위한 대규모 임베딩 테이블을 GPU 메모리에 유지 — 이것들은 단순한 성능 향상이 아닌 질적으로 다른 능력입니다. H200을 “더 빠른 H100″으로 생각하는 팀은 가장 가치 있는 기능을 활용하지 못하고 있습니다.

마지막으로 중국 출하에 대해 한 가지: 82,000개의 H200 GPU는 글로벌 공급의 적지 않은 비중입니다. 그 칩들이 풀에서 빠져나가면 나머지 모든 사람이 영향을 받습니다. 조달 타임라인에 이 요소를 반영하십시오.

2025년 2분기 실질적 권장 사항

현재 시장 역학을 기반으로, H200 클라우드 GPU 옵션을 평가하는 팀을 위한 핵심 포인트를 정리합니다:

- 메모리 바운드 추론 워크로드: H200이 명확한 선택입니다. 70B+ 모델에서 1.9배 추론 속도 향상은 프로덕션 배포 며칠 내에 가격 프리미엄을 회수합니다

- 80GB 미만 메모리 요구 학습: H100 인스턴스가 여전히 비용 효율적입니다. 여분의 메모리를 사용하지 않는다면 H200 프리미엄을 지불하지 마십시오

- 비용 민감 팀: Lambda, RunPod, Jarvislabs 등 전문 업체가 $3.72-$3.80/hr 진입점을 제공합니다 — 하이퍼스케일러로 기본 설정하기 전에 신중히 비교하십시오

- 장기 계획: 지금 예약 가격을 확보하십시오. 온디맨드 가격은 상승 추세이며 Blackwell이 성숙하기 전에는 반전되기 어렵습니다

- Blackwell에 관심 있는 팀: 향후 6-9개월간 H200을 프로덕션 플랫폼으로 활용하고, 인스턴스가 가용해지면 병렬로 Blackwell 평가를 시작하십시오

AI GPU 시장은 빠르게 변화하고 있지만, 2025년 2분기 기준 NVIDIA H200은 검증된 안정성과 최첨단 능력 사이의 최적점을 대표합니다. 문제는 H200을 도입할지 여부가 아니라, 수요와 공급의 균형이 계속 이동하는 상황에서 어떻게 비용 효율적으로 도입할 것인가입니다.

GPU 인프라 트렌드와 AI 기술 동향을 놓치지 않으시려면, 매주 최신 인사이트를 받아보세요.

매주 AI, 음악, 테크 트렌드를 이메일로 받아보세요.