2025 아버지의 날 테크 선물 베스트: 예산별 가젯 완벽 가이드

6월 24, 2025

WaveLab Pro 13 미터링 완전 개편 — MasterRig 2와 TruePeak이 마스터링을 바꾸는 7가지 이유

6월 25, 2025노트가 500개를 넘어가면서 Obsidian 볼트가 디지털 쓰레기장이 되어버린 경험, 한 번쯤 있지 않습니까? 저도 마찬가지였습니다. 그런데 로컬 LLM 기반 Obsidian AI 플러그인 3종을 설치한 뒤, 2,000개가 넘는 노트가 자동으로 연결되고 태깅되는 걸 보면서 생각이 완전히 바뀌었습니다. 클라우드에 데이터 한 바이트도 보내지 않고 말입니다.

마침 Apple이 WWDC 2025에서 Foundation Models 프레임워크를 발표하면서 온디바이스 AI가 대세임을 확인시켜 줬습니다. Swift 코드 3줄이면 무료로 온디바이스 추론이 가능한 시대입니다. 그런데 Obsidian 생태계에서는 이미 로컬 LLM을 활용한 플러그인들이 실전 배치되어 있습니다. 오늘은 그중 가장 강력한 3개를 완전히 파헤쳐 보겠습니다.

왜 로컬 LLM인가: 프라이버시와 성능의 교차점

Obsidian AI 플러그인을 선택할 때 가장 먼저 고려해야 할 것은 데이터 프라이버시입니다. Obsidian을 쓰는 이유 자체가 로컬 마크다운 파일 기반의 소유권 있는 지식 관리인데, 노트 내용을 외부 API로 보내는 건 그 철학에 정면으로 위배됩니다. 로컬 LLM은 이 문제를 완벽하게 해결합니다.

Ollama를 사용하면 Llama 3, Phi-3, Mistral, Gemma 같은 오픈소스 모델을 로컬에서 바로 실행할 수 있습니다. M1 이상의 Mac이라면 7B~13B 모델이 충분히 돌아가고, RTX 3060 이상의 GPU가 있는 PC라면 더 큰 모델도 문제없습니다. 즉, 여러분의 노트는 절대로 여러분의 컴퓨터를 떠나지 않습니다.

Smart Connections v4: 시맨틱 검색의 끝판왕

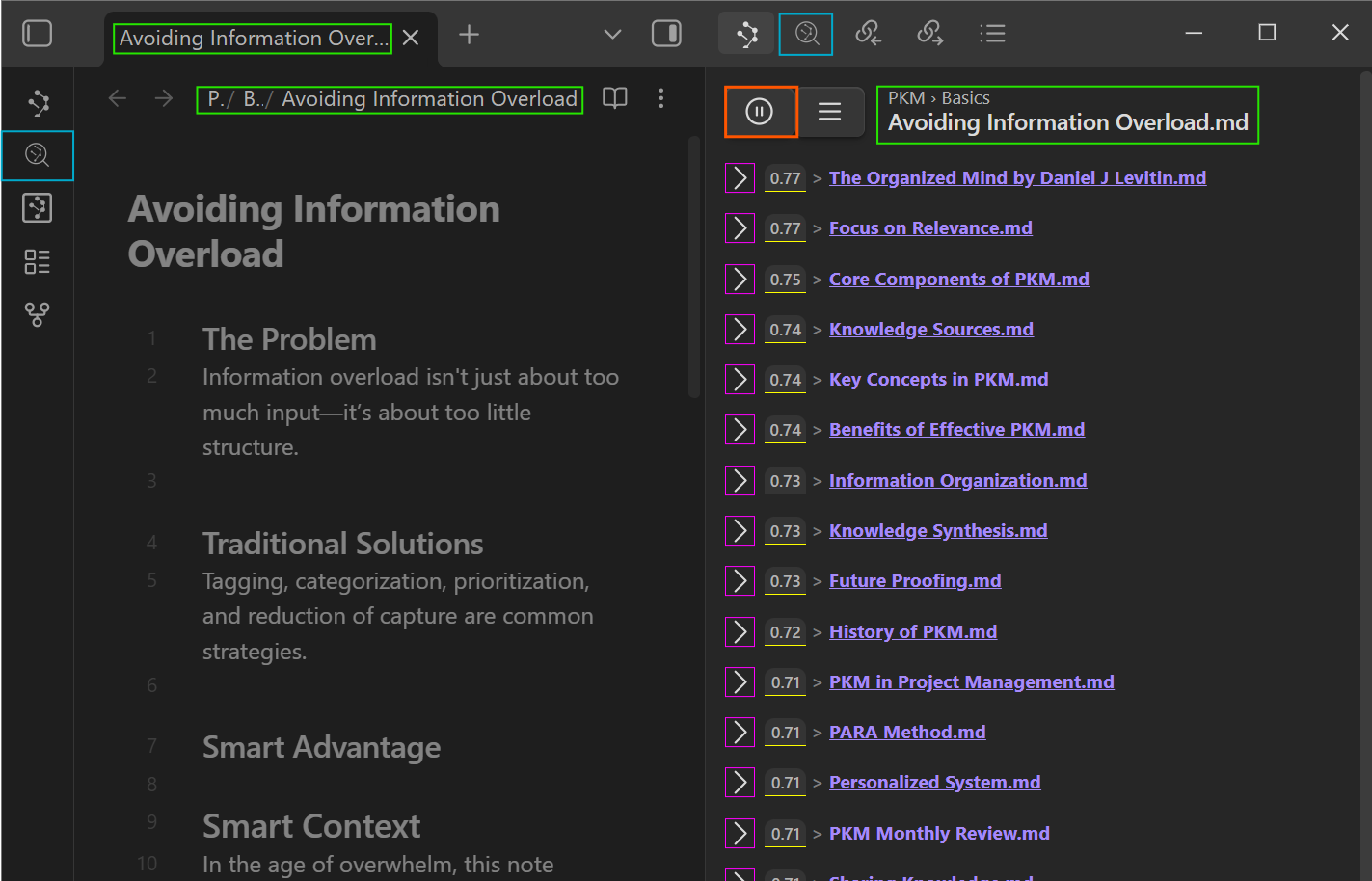

Smart Connections는 Obsidian AI 플러그인 중 가장 인기 있는 선택지입니다. 핵심 기능은 로컬 퍼스트 시맨틱 검색입니다. 키워드가 아니라 의미 기반으로 관련 노트를 찾아주기 때문에, “머신러닝 최적화”라고 쓴 노트와 “모델 성능 개선 기법”이라고 쓴 노트가 자동으로 연결됩니다.

주요 특징

- 제로 셋업 임베딩: 설치 즉시 로컬 임베딩 모델이 작동합니다. 외부 API 키 없이 바로 시작할 수 있습니다.

- Connections View 사이드바: 현재 노트와 의미적으로 연결된 노트 목록을 실시간으로 보여줍니다.

- Smart Lookup: 볼트 전체를 대상으로 자연어 질문이 가능합니다.

- 드래그 투 링크: 연결된 노트를 드래그해서 바로 위키링크로 삽입할 수 있습니다.

- Chat with Notes: Claude, GPT, Llama 3 등 100개 이상의 AI 모델과 연동하여 노트 기반 대화가 가능합니다.

- 오프라인 완전 지원: 인터넷 없이도 임베딩과 검색이 작동합니다.

- 모바일 호환: iOS/Android Obsidian 앱에서도 사용 가능합니다.

무료 코어 버전만으로도 시맨틱 검색과 로컬 임베딩이 가능하고, Pro 티어에서는 더 정교한 모델과 추가 기능을 제공합니다. GitHub 리포지토리에서 소스 코드도 확인할 수 있습니다.

AI Tagger Universe v1.0.16: 자동 태깅의 혁명

노트를 쓰면서 태그를 일일이 다는 건 가장 귀찮은 작업 중 하나입니다. AI Tagger Universe는 이 고통을 완전히 해결해 줍니다. LLM을 활용해 노트 내용을 분석하고 적절한 태그를 자동으로 생성합니다.

핵심 기능 상세

- 15개 이상 백엔드 지원: Ollama, LM Studio, LocalAI 같은 로컬 솔루션은 물론 Claude, GPT, Gemini 등 클라우드 서비스도 지원합니다.

- 기존 태그 매칭: 새 태그를 무작위로 만드는 게 아니라, 볼트에 이미 있는 태그 체계를 학습하여 일관된 태깅을 합니다.

- 계층형 태그:

#project/ai/nlp같은 중첩 태그를 자동으로 생성합니다. - 배치 태깅: 폴더 단위로 수백 개 노트를 한 번에 태깅할 수 있습니다. 기존 볼트 정리에 필수적인 기능입니다.

- 5가지 태그 포맷: 인라인 태그, YAML 프론트매터, 혼합 등 다양한 형식을 지원합니다.

- 태그 네트워크 시각화: 태그 간의 관계를 그래프로 보여주어 지식 구조를 한눈에 파악할 수 있습니다.

특히 Ollama와 연동하면 완전 오프라인 환경에서도 태깅이 가능합니다. Llama 3 8B 모델이면 대부분의 태깅 작업에 충분한 성능을 발휘합니다.

Smart Second Brain: 볼트 전체를 RAG 파이프라인으로

Smart Second Brain은 Obsidian AI 플러그인 중 가장 야심찬 프로젝트입니다. 볼트 전체를 RAG(Retrieval-Augmented Generation) 파이프라인으로 전환하여, 자신의 노트를 기반으로 질문-답변이 가능한 개인 AI 어시스턴트를 만들어 줍니다.

Smart Second Brain의 차별점

- 완전 오프라인 RAG: Ollama만 있으면 인터넷 연결 없이 작동합니다.

- 원본 노트 참조: 답변할 때 어떤 노트에서 정보를 가져왔는지 출처를 명확히 표시합니다.

- 다중 모델 지원: Llama 3, Phi-3, Mistral, Gemma 등 다양한 로컬 모델 선택이 가능합니다.

- 프라이버시 최우선: 모든 처리가 로컬에서 이루어지며, 외부로 데이터가 전송되지 않습니다.

예를 들어, 6개월 전에 작성한 프로젝트 회의록의 특정 결정 사항이 기억나지 않을 때, “Q3 예산 관련 결정 사항이 뭐였지?”라고 물으면 관련 노트들을 검색하여 정확한 답변을 제공합니다. 노트가 많을수록 더 강력해지는 구조입니다.

3대 Obsidian AI 플러그인 비교표

세 플러그인은 각각 다른 문제를 해결합니다. 한눈에 비교해 보겠습니다.

| 기능 | Smart Connections v4 | AI Tagger Universe v1.0.16 | Smart Second Brain |

|---|---|---|---|

| 핵심 기능 | 시맨틱 노트 검색/연결 | 자동 태깅 | 볼트 Q&A (RAG) |

| 로컬 LLM 지원 | 임베딩 로컬 + Chat 100+ 모델 | Ollama, LM Studio, LocalAI | Ollama 네이티브 |

| 오프라인 작동 | 완전 지원 | 로컬 모델 사용 시 가능 | 완전 지원 |

| 배치 처리 | 볼트 전체 자동 임베딩 | 폴더 단위 배치 태깅 | 볼트 전체 인덱싱 |

| 가격 | 무료 코어 / Pro 유료 | 무료 | 무료 |

| 모바일 | 지원 | 미지원 | 미지원 |

| 추천 대상 | 노트 간 연결 강화 | 태그 체계 자동화 | 노트 기반 질문/답변 |

실전 셋업 가이드: Ollama + 3대 플러그인 한 번에 구성하기

세 플러그인 모두 Ollama를 백엔드로 사용할 수 있으므로, Ollama 한 번만 설치하면 됩니다. 단계별로 진행해 보겠습니다.

1단계: Ollama 설치 및 모델 다운로드

# macOS / Linux

curl -fsSL https://ollama.com/install.sh | sh

# 또는 ollama.com에서 설치 파일 다운로드

# 추천 모델 다운로드

ollama pull llama3:8b # 범용 (태깅, Q&A)

ollama pull nomic-embed-text # 임베딩 전용 (Smart Connections)M1/M2/M3 Mac 기준으로 Llama 3 8B는 약 4.7GB의 저장 공간을 사용하며, 8GB RAM에서도 원활하게 작동합니다. Windows의 경우 ollama.com에서 설치 파일을 받으면 됩니다.

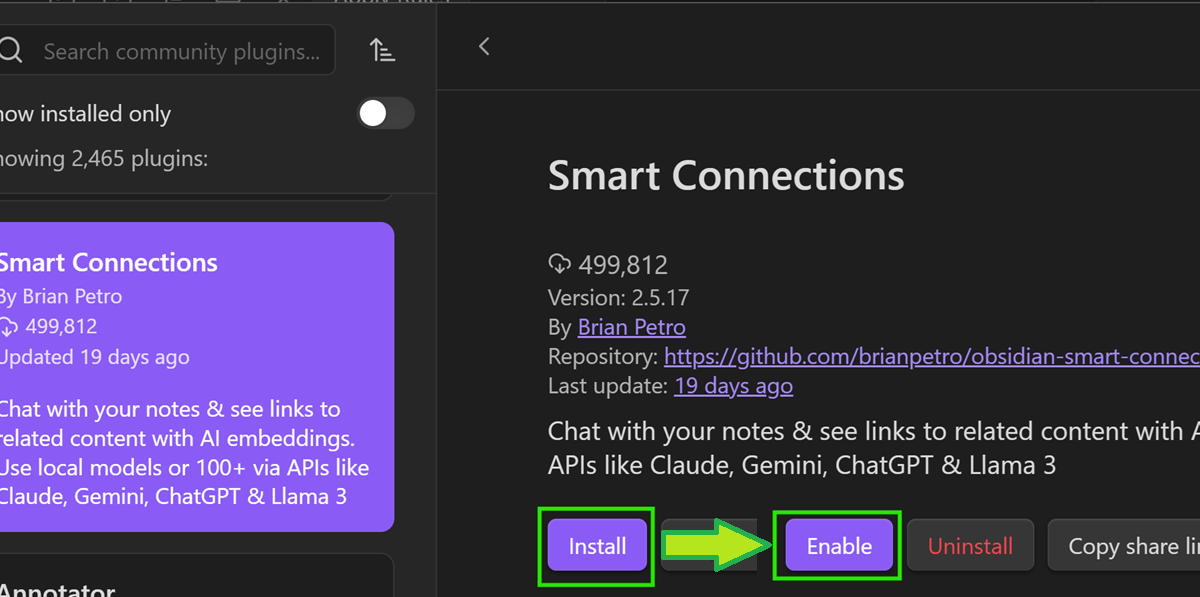

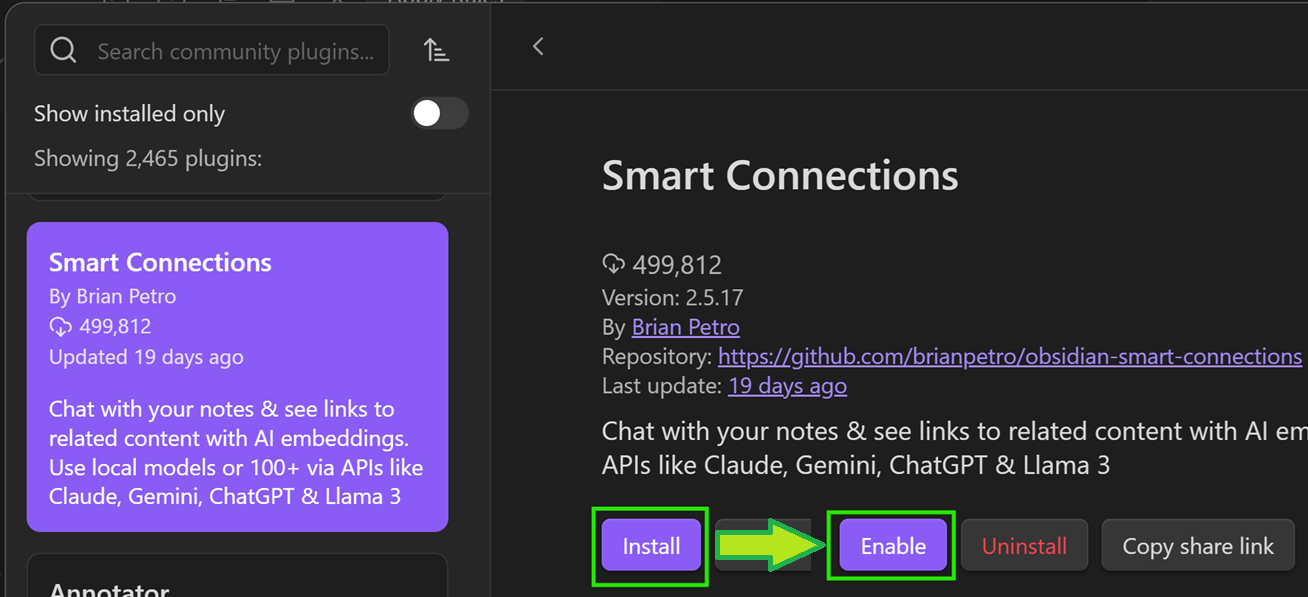

2단계: Obsidian 커뮤니티 플러그인 설치

설정 → Community Plugins → Browse

→ "Smart Connections" 검색 → Install → Enable

→ "AI Tagger Universe" 검색 → Install → Enable

→ "Smart Second Brain" 검색 → Install → Enable3단계: Smart Connections 설정

Smart Connections는 설치 즉시 로컬 임베딩을 시작합니다. 별도의 설정 없이도 기본 임베딩 모델이 볼트 전체를 인덱싱합니다. Chat 기능에서 Ollama를 사용하려면 Settings에서 Chat Model을 Ollama의 llama3:8b로 변경하면 됩니다.

4단계: AI Tagger Universe 설정

Settings → AI Tagger Universe에서 Provider를 Ollama로 설정합니다. Endpoint는 기본값 http://localhost:11434이며, Model에 llama3:8b를 입력합니다. Tag Format은 사용하는 방식에 맞게 YAML Frontmatter 또는 Inline 중 선택합니다.

5단계: Smart Second Brain 설정

Smart Second Brain은 Ollama 연동이 기본 설계입니다. Settings에서 LLM Provider를 Ollama로 설정하고 원하는 모델을 선택하면 끝입니다. 첫 실행 시 볼트 전체를 인덱싱하는데, 1,000개 노트 기준 약 5~10분 정도 소요됩니다.

WWDC 2025와 온디바이스 AI의 미래

Apple이 WWDC 2025에서 발표한 Foundation Models 프레임워크는 온디바이스 AI의 방향을 명확히 보여줍니다. 개발자가 Swift 코드 3줄이면 기기 내에서 무료로 AI 추론을 실행할 수 있습니다. 데이터가 기기를 떠나지 않는 프라이버시 보장은 기본입니다.

Obsidian의 로컬 LLM 플러그인들은 이 트렌드를 이미 실현하고 있습니다. Smart Connections의 온디바이스 임베딩, AI Tagger Universe의 Ollama 연동, Smart Second Brain의 완전 오프라인 RAG는 모두 같은 철학을 공유합니다. 여러분의 데이터는 여러분의 기기 안에 머물러야 한다는 것입니다. Apple의 행보는 이 접근 방식이 일시적 유행이 아니라 산업 전체의 방향이라는 것을 증명합니다.

실전 팁: 3개 플러그인 조합 워크플로우

세 플러그인을 함께 사용하면 시너지가 극대화됩니다. 제가 실제로 사용하는 워크플로우를 공유합니다.

- 노트 작성 직후: AI Tagger Universe로 자동 태깅 실행. 기존 태그 체계에 맞춰 3~5개 태그가 자동 생성됩니다.

- 리서치 중: Smart Connections 사이드바에서 현재 작성 중인 내용과 관련된 기존 노트를 실시간 확인. 드래그 투 링크로 바로 연결합니다.

- 주간 리뷰 시: Smart Second Brain에 “이번 주에 작성한 노트 중 프로젝트 X와 관련된 내용을 정리해 줘”라고 질문하면 자동으로 요약이 됩니다.

- 기존 볼트 정리: AI Tagger Universe의 배치 태깅으로 태그 없는 오래된 노트들을 한 번에 처리합니다.

이 조합의 가장 큰 장점은 Ollama 하나만 백그라운드에 돌리면 세 플러그인 모두 작동한다는 점입니다. 시스템 리소스도 Ollama가 유휴 시에는 거의 소비하지 않으므로, 일반적인 작업에 영향을 주지 않습니다.

MakeUseOf의 한 필자가 로컬 LLM으로 혼란스러운 Obsidian 볼트를 정리한 경험을 공유하기도 했는데, 핵심 결론은 동일합니다. 로컬 AI는 이미 실용 단계에 진입했으며, 프라이버시를 포기하지 않고도 강력한 지식 관리가 가능하다는 것입니다.

Obsidian AI 플러그인 생태계는 빠르게 성장하고 있고, Ollama 같은 로컬 추론 인프라의 발전과 함께 앞으로 더 강력해질 것입니다. 지금이 여러분의 지식 관리 시스템에 AI를 도입할 최적의 시점입니다. 세 플러그인 모두 무료로 시작할 수 있으니, 오늘 바로 설치해서 여러분의 볼트가 어떻게 변하는지 직접 확인해 보시기 바랍니다.

AI 기반 자동화 시스템 구축이나 기술 컨설팅이 필요하시다면, 편하게 연락 주십시오.

매주 AI, 음악, 테크 트렌드를 이메일로 받아보세요.