Mac Studio 2025 음악 프로덕션 실전 리뷰: M4 Max vs M3 Ultra, 11개월 DAW 벤치마크 결과

2월 23, 2026

무료 DAW 추천 2026: Cakewalk Sonar vs GarageBand vs Ardour 9 완벽 비교

2월 24, 2026오픈소스 AI 2026년 2월, 역사상 가장 많은 프론티어급 오픈 모델이 쏟아진 한 달이었습니다. GLM-5가 오픈소스 최초로 GPT-5.2급 성능을 기록하며 1위에 올랐고, Qwen 3.5는 비용 60% 절감이라는 효율 혁명을 선보였습니다. 이번 글에서는 2월 한 달간 등장한 핵심 모델 10개를 분석하고, 개발자와 기업이 알아야 할 트렌드를 정리합니다.

GLM-5: 오픈소스 AI 2026년 2월의 새로운 왕

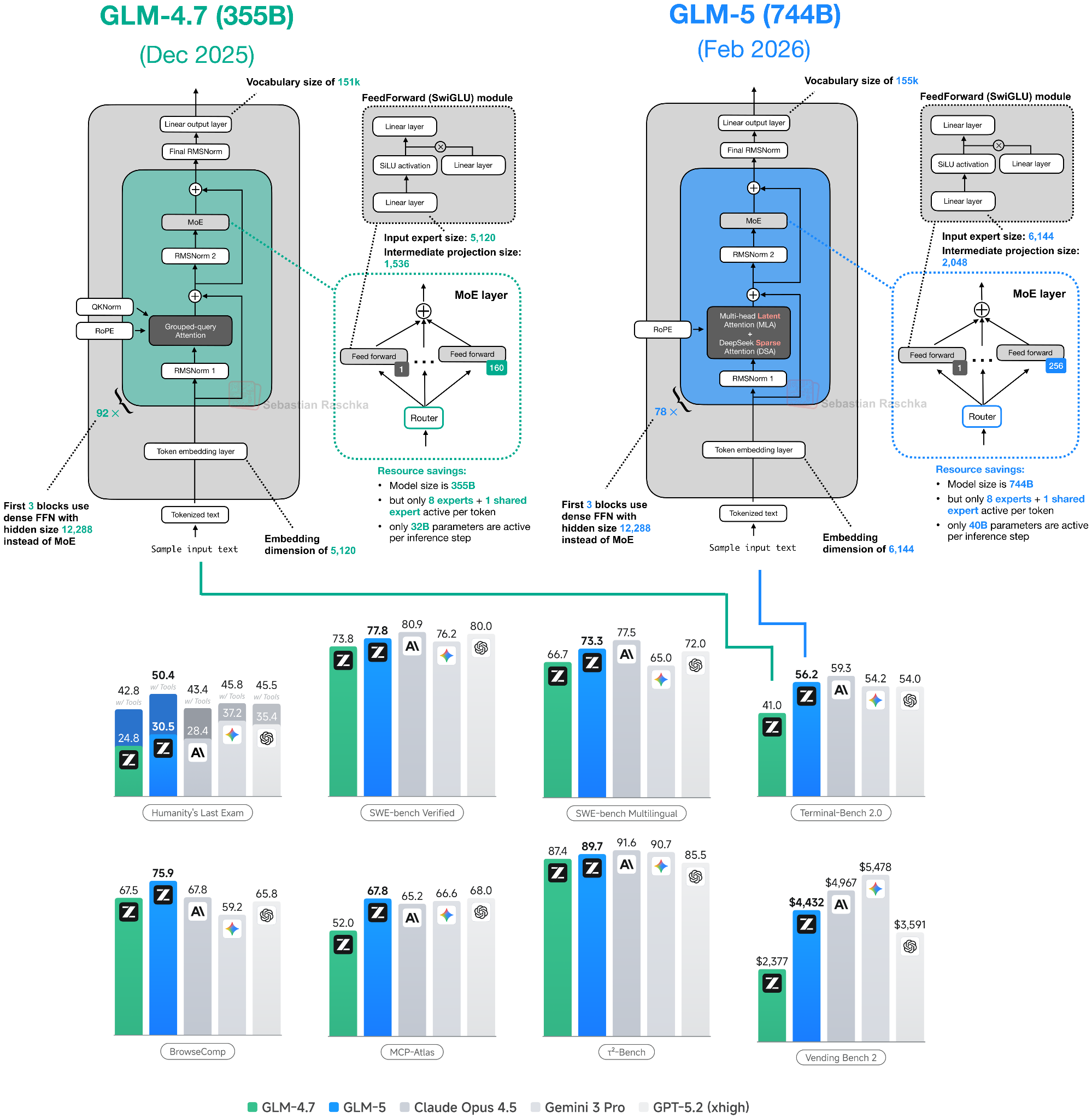

z.AI가 2월 12일 공개한 GLM-5는 Quality Index 49.64로 오픈소스 1위에 등극했습니다. 744B 파라미터(40B 활성) MoE 구조에 256개 전문가 모듈을 탑재했으며, Multi-Head Latent Attention과 DeepSeek Sparse Attention을 결합해 추론 효율을 극대화했습니다. GPT-5.2, Claude Opus 4.6과 비교해도 밀리지 않는 성능입니다.

Qwen 3.5: 효율의 교과서

알리바바의 Qwen 3.5(2월 15~17일)는 397B 총 파라미터 중 17B만 활성화하는 MoE 구조입니다. Gated DeltaNet 하이브리드 어텐션을 채택해 기존 대비 비용 60% 절감, 처리량 8배 향상을 달성했습니다. LiveCodeBench v6 83.6, AIME26 91.3, GPQA Diamond 88.4로 벤치마크도 최상위권입니다. 201개 언어 지원, 최대 2시간 영상까지 처리하는 네이티브 멀티모달, 에이전트 기능까지 갖췄습니다.

알리바바는 2월 5일 모든 AI 브랜드를 ‘Qwen’으로 통합하며 올인 전략을 공식화했습니다.

Kimi K2.5와 MiniMax M2.5: 2위·3위 경쟁

문샷AI의 Kimi K2.5(1월 27일)는 1조 파라미터의 초대형 모델로, DeepSeek V3 아키텍처를 스케일업했습니다. Quality Index 46.73으로 2위를 차지했고, LiveCodeBench 85%, AIME 2025 96%를 기록했습니다.

MiniMax M2.5(2월 12일)는 230B로 비교적 작지만, SWE-Bench 코딩 벤치마크에서 강세를 보이며 Quality Index 41.97로 3위에 올랐습니다.

속도 전쟁: Step 3.5 Flash와 Qwen3-Coder-Next

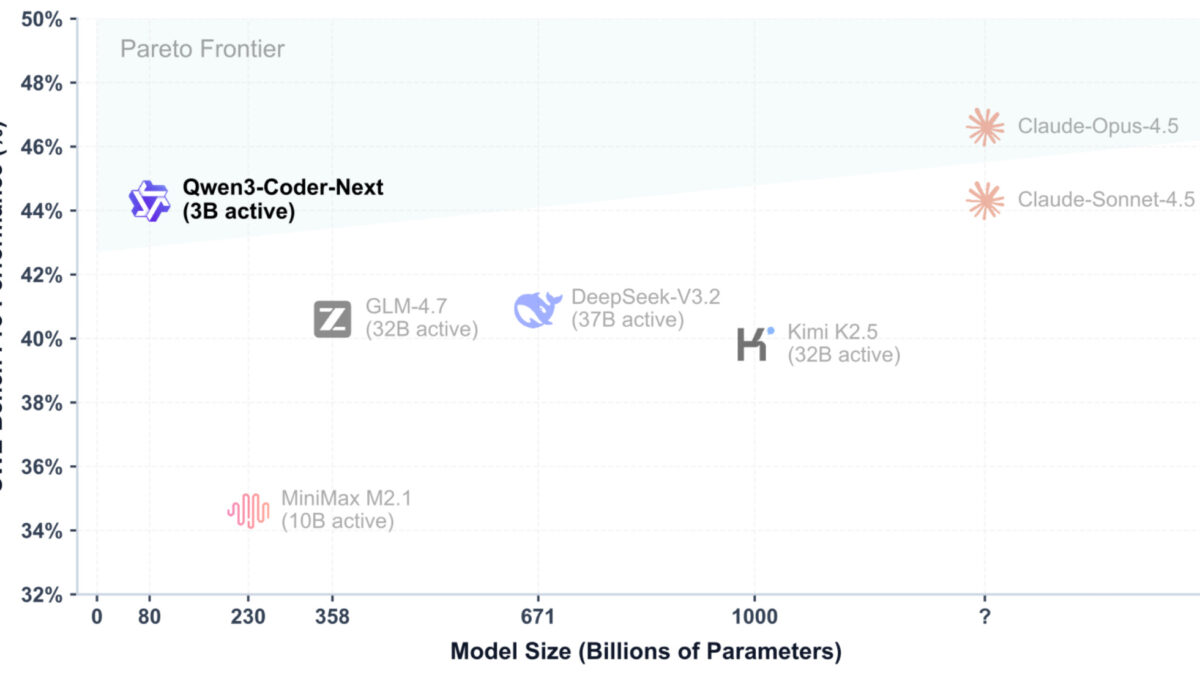

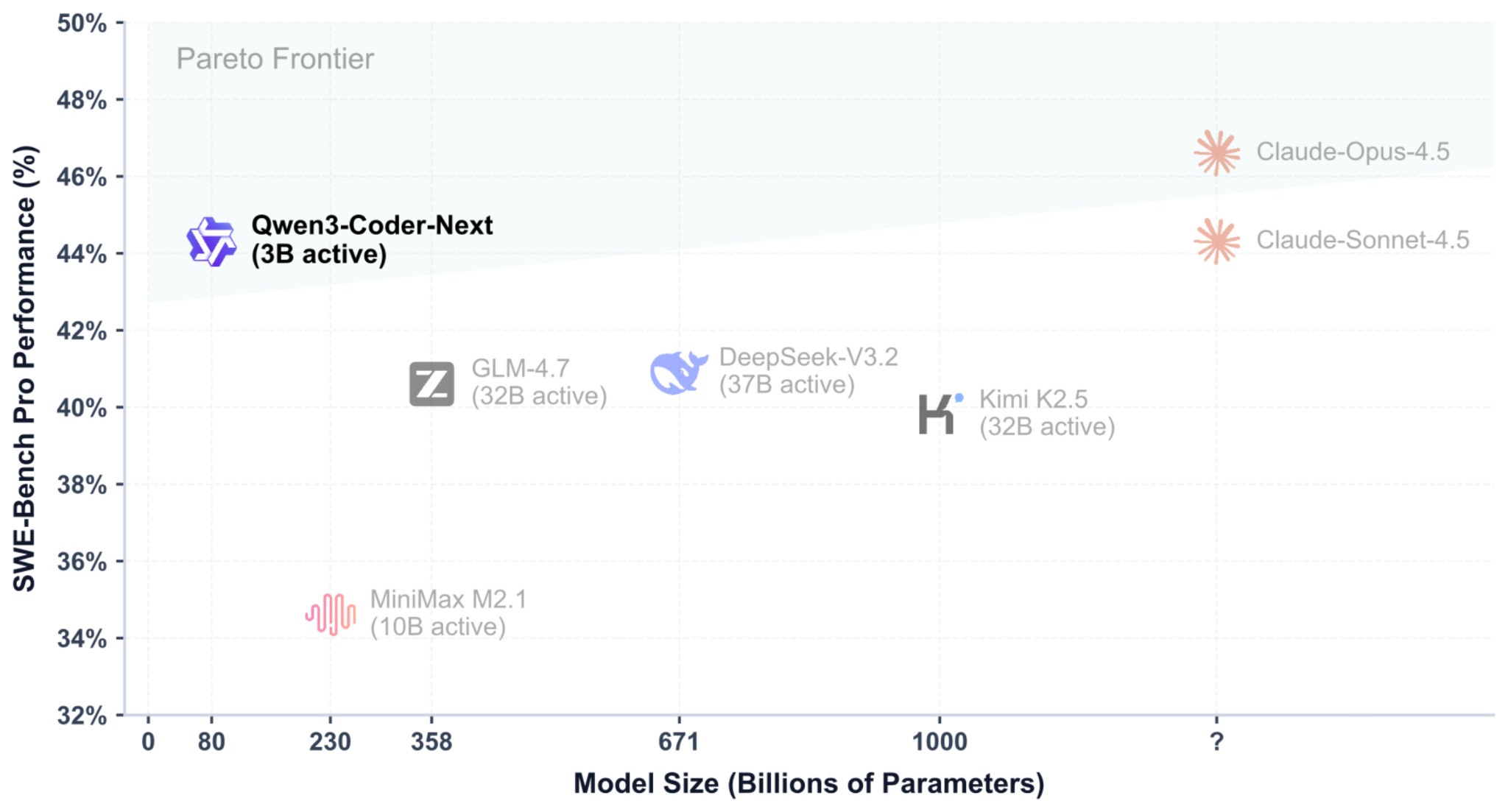

StepFun의 Step 3.5 Flash(2월 1일)는 196B MoE(11B 활성)에 Multi-Token Prediction을 적용해 Hopper GPU에서 초당 100토큰을 달성했습니다. Qwen3-Coder-Next(2월 3일)는 80B 중 3B만 활성화하는 코딩 특화 모델로, Claude Sonnet 4.5에 필적하는 SWE-Bench Pro 성능을 보여줬습니다.

주목할 만한 나머지 모델들

Ant Group Ling/Ring 2.5(2월 16일): 1조 파라미터에 Lightning Attention을 탑재, Kimi K2 대비 3.5배 높은 처리량을 달성했습니다.

Cohere Tiny Aya(2월 17일): 3.35B의 소형 다국어 모델이지만, Qwen3 4B와 Gemma 3 4B를 다국어 태스크에서 앞질렀습니다.

Nanbeige 4.1 3B(2월 13일): 3B 모델이 1년 전 4B급 모델을 능가하는 성능을 보여줬습니다.

Arcee AI Trinity Large(1월 27일): 400B(13B 활성) MoE에 로컬/글로벌 어텐션을 교차 배치한 독특한 구조입니다.

Mistral: Voxtral Mini Transcribe V2와 Voxtral Realtime으로 200ms 지연시간의 음성 인식을 공개했습니다. 4B 파라미터로 스마트폰에서도 구동 가능하며, 13개 언어를 지원합니다.

2월의 핵심 트렌드

2026년 2월 오픈소스 AI의 핵심 트렌드는 명확합니다. MoE 아키텍처가 사실상 표준이 되었고, 활성 파라미터 비율은 계속 줄어들고 있습니다. Gated DeltaNet, Multi-Head Latent Attention 등 새로운 어텐션 메커니즘이 효율을 극적으로 끌어올리고 있습니다. 이제 경쟁의 축은 ‘파라미터 수’가 아니라 ‘활성 파라미터당 성능’으로 완전히 이동했습니다.

프로덕션 배포를 고려하는 기업이라면, GLM-5(종합 성능), Qwen 3.5(비용 효율), Qwen3-Coder-Next(코딩 특화) 중 용도에 맞는 모델을 우선 검토하시기 바랍니다. 오픈소스 AI는 더 이상 프로프리터리 모델의 대안이 아니라, 그 자체로 최선의 선택이 되고 있습니다.

오픈소스 AI 도입, 모델 선정, 프로덕션 배포 전략이 필요하신가요? 최적의 AI 스택을 함께 설계해 드리겠습니다.