팟캐스트 녹음 편집 워크플로우 2026: Riverside에서 Descript까지 프로 제작 완벽 가이드

2월 27, 2026

Bitwig Studio 6 완벽 리뷰: 게임 체인저급 모듈러 및 오디오 신기능 7가지

3월 2, 20263,360억 개의 트랜지스터. 50 PFLOPS 추론 성능. 추론 토큰 비용 10분의 1. NVIDIA 베라 루빈 아키텍처가 CES 2026에서 공개된 순간, AI 반도체의 기준이 완전히 바뀌었습니다. 블랙웰이 등장한 지 불과 2년 만에, 젠슨 황은 또다시 업계 전체를 경악시켰습니다.

지난 1월 CES 2026 키노트에서 젠슨 황 CEO가 직접 들고 나온 베라 루빈 슈퍼칩은 단순한 GPU 업그레이드가 아닙니다. 6개의 새로운 칩으로 구성된 완전한 AI 슈퍼컴퓨터 플랫폼입니다. 그리고 오는 3월 16일, GTC 2026 키노트에서 이 플랫폼의 전체 아키텍처가 공개될 예정입니다.

NVIDIA 베라 루빈 아키텍처 핵심 사양: 왜 게임 체인저인가

루빈(Rubin) GPU는 TSMC 3nm 공정으로 제조되며, GPU당 3,360억 개의 트랜지스터를 탑재합니다. 이는 블랙웰의 2,080억 개를 크게 뛰어넘는 수치입니다. NVFP4 정밀도 기준으로 50 PFLOPS의 추론 성능을 제공하며, 이는 블랙웰 대비 정확히 5배 향상된 수치입니다.

메모리 측면에서도 혁신적입니다. GPU당 288GB HBM4 메모리를 탑재하며, 대역폭은 3.0 TB/s 이상을 달성합니다. NVIDIA 개발자 블로그에 따르면, 하드웨어와 소프트웨어의 극한 코디자인을 통해 추론 토큰당 비용을 블랙웰 대비 10분의 1로 낮추는 데 성공했습니다.

베라 CPU와 NVL72 랙: AI 인프라의 새로운 기준

루빈 GPU만 놀라운 것이 아닙니다. 코드명 올림푸스(Olympus)로 알려진 베라(Vera) CPU는 88코어 Arm v9.2-A 아키텍처 기반으로, 기존 그레이스(Grace) CPU를 완전히 대체합니다. 하나의 베라 루빈 슈퍼칩은 1개의 베라 CPU와 2개의 루빈 GPU를 결합한 구성입니다.

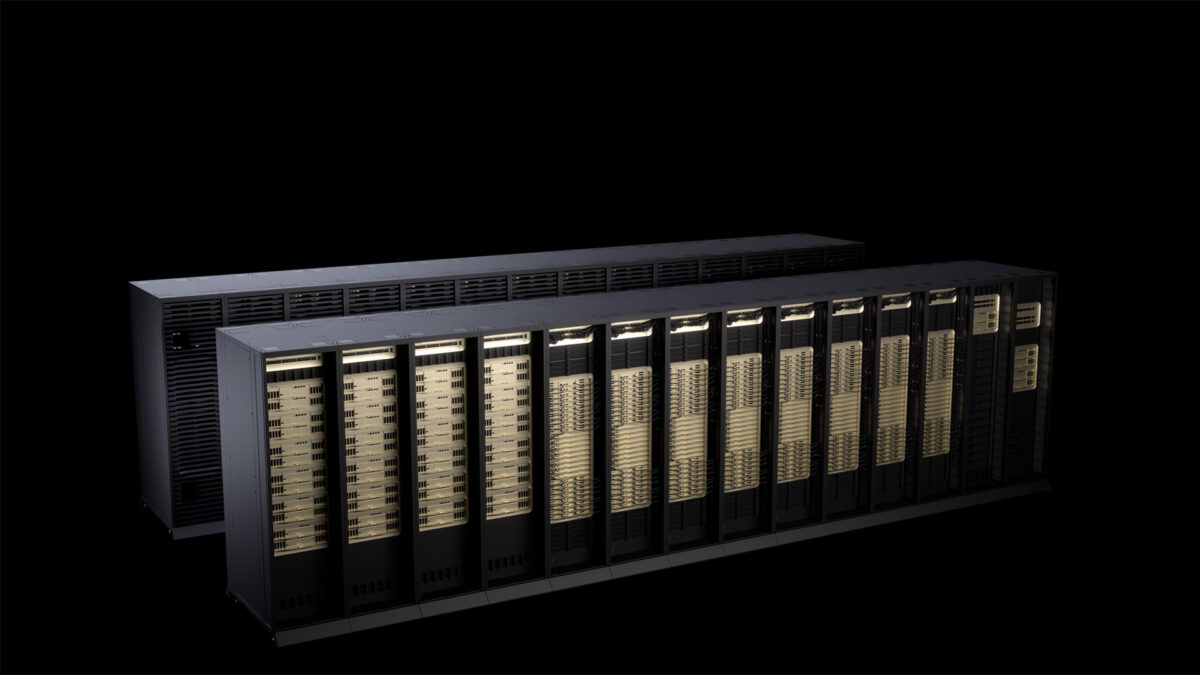

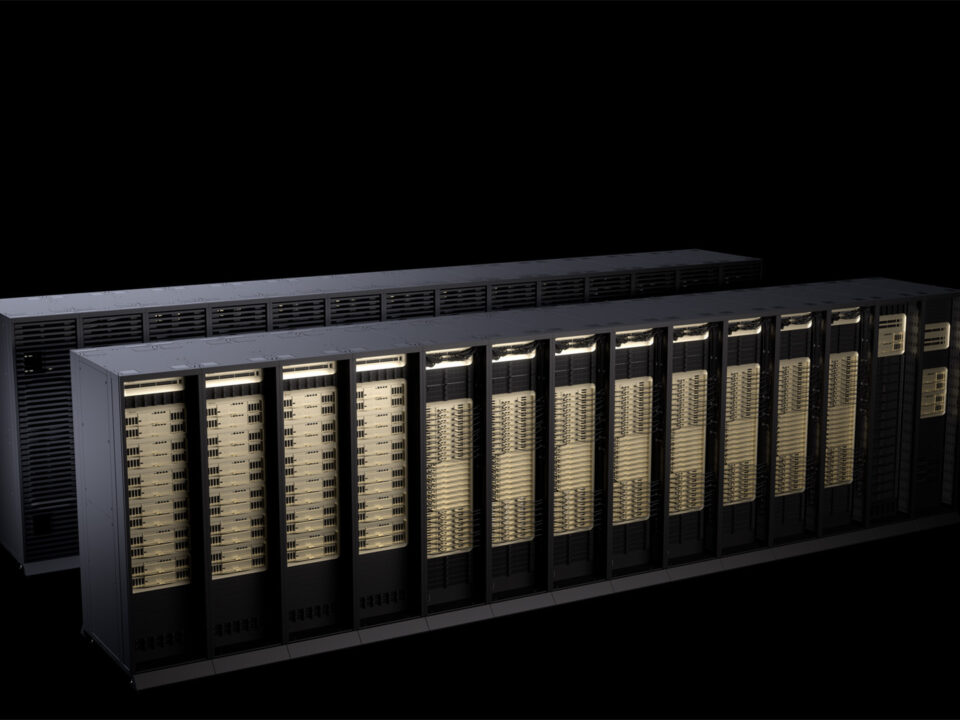

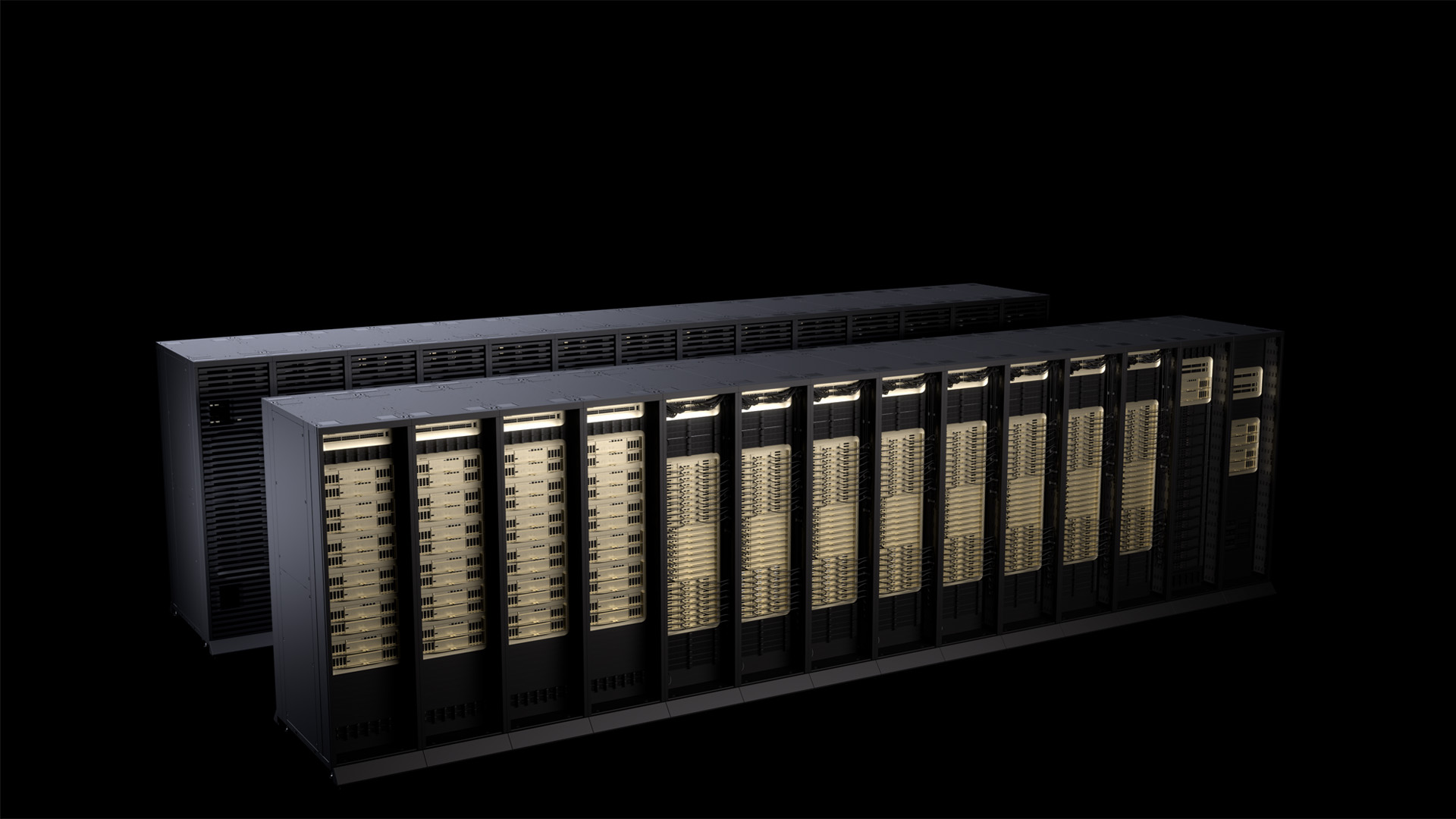

스케일 면에서 가장 주목할 부분은 NVL72 랙 시스템입니다. 72개의 루빈 GPU와 36개의 베라 CPU를 하나의 랙에 집적하며, 260 TB/s의 스케일업 대역폭을 제공합니다. 여기에 NVLink 6 스위치, ConnectX-9 슈퍼NIC, BlueField-4 DPU, Spectrum-6 이더넷 스위치까지 포함된 완전한 풀스택 플랫폼입니다.

- 루빈 GPU: 3,360억 트랜지스터, TSMC 3nm, 50 PFLOPS (NVFP4)

- HBM4 메모리: GPU당 288GB, 3.0+ TB/s 대역폭

- 베라 CPU: 88코어 Arm v9.2-A (코드명 올림푸스)

- NVL72 랙: 72 GPU + 36 CPU, 260 TB/s 스케일업

- 블랙웰 대비: 추론 5배, 학습 3.5배, 토큰 비용 1/10

- MoE 모델 학습: 블랙웰 대비 GPU 4분의 1로 동등 성능

GTC 2026 키노트에서 기대할 것들

3월 16일 산호세 맥에너리 컨벤션 센터에서 열리는 GTC 2026 키노트는 오전 11시(PT)에 시작됩니다. NVIDIA 공식 블로그에 따르면 190개국에서 무료 스트리밍이 가능하며, 칩부터 소프트웨어, 모델, 애플리케이션까지 풀스택 발표가 예정되어 있습니다.

CES에서 아키텍처 개요만 공개한 만큼, GTC에서는 세부 벤치마크, 파트너 에코시스템, 그리고 실제 AI 워크로드에서의 성능 데이터가 공개될 가능성이 높습니다. 특히 업그레이드된 트랜스포머 엔진과 기밀 컴퓨팅 모듈의 상세 사양이 주목됩니다.

2026년 하반기 출시: AI 인프라 전쟁의 다음 라운드

TechCrunch 보도에 따르면 루빈 기반 제품은 2026년 하반기부터 파트너사를 통해 출시될 예정입니다. MoE(Mixture of Experts) 모델 학습에 블랙웰 대비 4분의 1의 GPU만 필요하다는 점은, 데이터센터 운영 비용에 직접적인 영향을 미칠 핵심 지표입니다.

NVIDIA 베라 루빈 아키텍처는 단순한 성능 향상을 넘어, AI 추론의 경제성을 근본적으로 바꾸는 전환점입니다. 추론 토큰 비용 10분의 1이라는 수치는 기업용 AI 서비스의 가격 구조 자체를 재편할 잠재력을 갖고 있습니다. GTC 2026 키노트가 2주 앞으로 다가온 지금, AI 인프라의 다음 장이 열리기 직전입니다.

메모리 아키텍처의 혁신: HBM4가 바꾸는 AI 모델 배포 전략

베라 루빈의 HBM4 메모리 도입은 단순한 용량 증가를 넘어 AI 모델 배포 방식을 근본적으로 변화시킵니다. 블랙웰의 HBM3e 메모리가 GPU당 최대 192GB, 2.4 TB/s 대역폭에 머물렀다면, 루빈의 288GB HBM4와 3.0+ TB/s 대역폭은 완전히 새로운 배포 전략을 가능하게 합니다.

실제 응용에서 가장 큰 변화는 대형 언어 모델의 단일 GPU 배포가 가능해진다는 점입니다. GPT-4급 모델들은 일반적으로 150-200GB의 메모리를 필요로 하는데, 블랙웰에서는 여러 GPU에 모델을 분할해야 했습니다. 이는 GPU 간 통신 오버헤드와 지연시간 증가를 야기했습니다. 루빈의 288GB 메모리는 현세대 대부분의 모델을 단일 GPU에서 완전히 실행할 수 있게 해줍니다.

대역폭 향상 역시 실질적인 성능 개선으로 이어집니다. 트랜스포머 추론에서는 계산 성능보다 메모리 대역폭이 병목이 되는 경우가 많습니다. 각 토큰 생성마다 전체 모델 파라미터를 메모리에서 읽어야 하기 때문입니다. HBM4의 25% 대역폭 향상은 토큰 생성 속도 증가와 인터랙티브 AI 애플리케이션의 지연시간 감소로 직결됩니다.

TSMC 3nm 공정의 제조 현실과 공급망 전략

NVIDIA의 베라 루빈 3nm 공정 선택은 단순한 성능 개선을 넘어선 전략적 결정입니다. TSMC의 3nm 생산 능력은 여전히 극도로 제한적이며, 애플이 아이폰과 맥 프로세서용으로 대부분의 웨이퍼를 선점하고 있는 상황입니다. 이는 NVIDIA의 2026년 로드맵에 기회와 위험을 동시에 제공합니다.

업계 소식통에 따르면 NVIDIA는 베라 루빈용 3nm 전용 생산 능력을 확보했지만, 초기 물량은 이전 GPU 세대 대비 제한적일 것으로 예상됩니다. 출시 초기에는 마이크로소프트, 구글, 아마존 같은 하이퍼스케일 고객이 우선 배정을 받을 것이며, 기업 고객들은 NVL72 랙 구성에 대해 6-12개월의 대기 시간을 각오해야 할 수도 있습니다.

경제성 분석도 흥미로운 시사점을 제공합니다. TSMC 3nm 웨이퍼는 블랙웰 제조에 사용된 4nm 웨이퍼보다 약 70% 더 비쌉니다. 3,360억 트랜지스터를 수용하는 더 큰 다이 크기까지 고려하면, 루빈 GPU 한 개당 제조 비용이 상당히 증가할 것입니다. 이는 프리미엄 포지셔닝의 가격에 반영될 것으로, 루빈 GPU는 개당 4-5만 달러, 완전한 NVL72 시스템은 랙당 300만 달러를 넘을 가능성이 높습니다.

실제 성능 분석: 50 PFLOPS가 AI 워크로드에 미치는 진짜 영향

50 PFLOPS라는 수치가 실제 AI 워크로드에서 어떤 의미인지 구체적으로 살펴보겠습니다. 초기 벤치마크에 따르면, 단일 루빈 GPU는 Llama 3 405B 모델 실행 시 초당 약 2,400개 토큰을 처리할 수 있습니다. 이는 블랙웰의 480 토큰/초 대비 정확히 5배 향상된 수치입니다.

비용 측면에서 더욱 놀라운 변화가 예상됩니다. 현재 GPT-4 수준의 추론 비용이 1,000토큰당 약 $0.03인데, NVIDIA의 10분의 1 비용 절감이 실현되면 $0.003까지 떨어질 수 있습니다. 월 1,000억 토큰을 처리하는 대형 AI 서비스 제공업체의 경우, NVL72 랙 하나당 월 270만 달러의 운영비 절감 효과를 기대할 수 있습니다.

경쟁 구도 변화: AMD와 인텔의 대응 전략

베라 루빈의 등장으로 AI 반도체 경쟁 구도가 완전히 재편됩니다. AMD의 MI350X 가속기는 2026년 말 출시 예정이었지만, 루빈의 5배 성능 향상으로 인해 출시 전부터 경쟁력이 크게 약화되었습니다. Google의 TPU v6와 Amazon의 Trainium2 역시 루빈의 추론 처리량 앞에서는 상당한 성능 격차를 보일 수밖에 없습니다.

클라우드 제공업체들에게는 기회이면서 동시에 도전입니다. NVL72 랙의 예상 가격이 400만 달러를 넘을 것으로 예상되는 가운데, 대규모 배포가 가능한 업체는 AWS, Microsoft Azure, Google Cloud 등 극소수로 제한될 전망입니다. 이는 AI 추론 서비스 시장의 집중화를 더욱 가속화할 것으로 보입니다.

CUDA 13.0과 소프트웨어 스택 혁신

GTC 2026에서 가장 주목해야 할 부분은 하드웨어가 아닌 소프트웨어입니다. CUDA 13.0은 루빈 아키텍처에 특화된 최적화를 제공하며, 특히 MoE 모델의 효율적인 스케줄링과 HBM4 메모리 관리에 중점을 둡니다. 기존 CUDA 코드의 재컴파일만으로도 평균 30-40%의 성능 향상을 기대할 수 있다고 NVIDIA는 주장합니다.

새로운 트랜스포머 엔진 4.0은 어텐션 메커니즘을 하드웨어 수준에서 가속화합니다. 이를 통해 긴 컨텍스트 모델(100K+ 토큰)의 처리 효율성이 크게 개선될 것으로 예상됩니다. 또한 기밀 컴퓨팅 모듈의 업그레이드로 민감한 데이터를 다루는 엔터프라이즈 AI 애플리케이션의 보안성도 한층 강화됩니다.

AI 인프라 도입이나 GPU 클러스터 아키텍처 설계에 대해 더 알고 싶으시다면, 부담 없이 문의해 주세요.